منتشر شده: ۱۴ مه ۲۰۲۴، آخرین بهروزرسانی: ۲۰ مه ۲۰۲۴

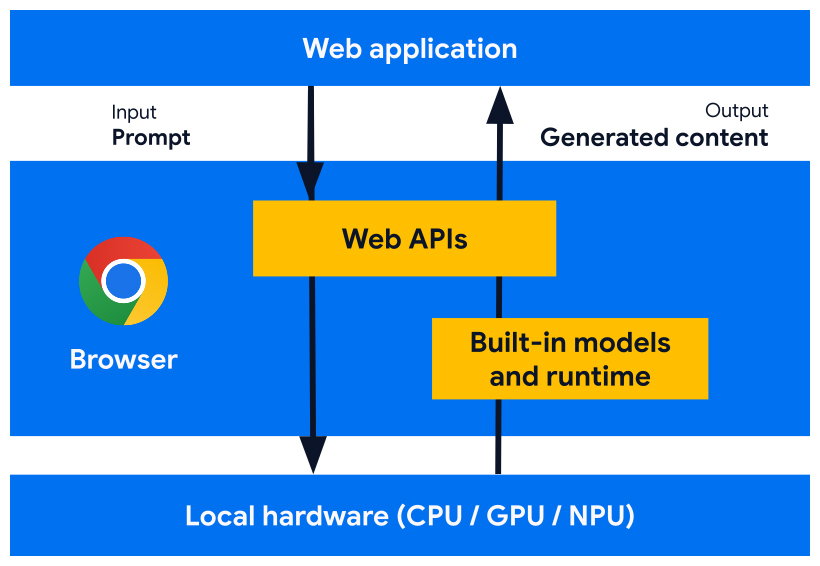

ما در حال توسعه APIهای پلتفرم وب و ویژگیهای مرورگر هستیم که برای کار با مدلهای هوش مصنوعی، مدلهای تخصصی و مدلهای زبان بزرگ (LLM) که در مرورگر تعبیه شدهاند، طراحی شدهاند. با هوش مصنوعی تعبیهشده، وبسایت یا برنامه وب شما میتواند وظایف مبتنی بر هوش مصنوعی را بدون نیاز به استقرار، مدیریت یا میزبانی مستقل مدلها انجام دهد.

مزایای هوش مصنوعی داخلی، برنامه پیادهسازی ما و نحوه شروع پیادهسازی این ابزارها را کشف کنید.

اگر در زمینه هوش مصنوعی در وب تازهکار هستید، واژهنامه و مفاهیم هوش مصنوعی وب ما را مطالعه کنید.

مزایای هوش مصنوعی داخلی برای توسعهدهندگان وب

با هوش مصنوعی داخلی، مرورگر شما مدلهای پایه و تخصصی را ارائه و مدیریت میکند.

هوش مصنوعی داخلی مزایای زیر را ارائه میدهد:

- سهولت استقرار : مرورگر، مدلها را توزیع میکند، قابلیتهای دستگاه را در نظر میگیرد و بهروزرسانیها را مدیریت میکند. این بدان معناست که شما مسئول دانلود یا بهروزرسانی مدلهای بزرگ از طریق شبکه نیستید. لازم نیست با مشکل کمبود فضای ذخیرهسازی، بودجه حافظه زمان اجرا، هزینههای سرویسدهی و سایر چالشها مواجه شوید.

- دسترسی به شتاب سختافزاری : زمان اجرای هوش مصنوعی مرورگر برای بهرهبرداری حداکثری از سختافزار موجود، چه با GPU، NPU یا CPU، بهینهسازی شده است. در نتیجه، برنامه شما میتواند بهترین عملکرد را در هر دستگاه داشته باشد.

مزایای اجرای سمت کلاینت

با هوش مصنوعی داخلی، میتوانید هوش مصنوعی را در سمت کلاینت اجرا کنید، به این معنی که از این مزایا بهرهمند میشوید:

- پردازش محلی دادههای حساس : هوش مصنوعی سمت کلاینت میتواند وضعیت حریم خصوصی شما را بهبود بخشد. به عنوان مثال، اگر با دادههای حساس کار میکنید، میتوانید ویژگیهای هوش مصنوعی را با رمزگذاری سرتاسری به کاربران ارائه دهید.

- تجربه کاربری سریع : در برخی موارد، حذف رفت و برگشت به سرور به این معنی است که میتوانید نتایج تقریباً فوری ارائه دهید. هوش مصنوعی سمت کلاینت میتواند تفاوت بین یک ویژگی مناسب و یک تجربه کاربری نامطلوب باشد.

- دسترسی بیشتر به هوش مصنوعی : دستگاههای کاربران شما میتوانند بخشی از بار پردازش را در ازای دسترسی بیشتر به ویژگیها بر عهده بگیرند. به عنوان مثال، اگر ویژگیهای هوش مصنوعی پریمیوم ارائه میدهید، میتوانید این ویژگیها را با هوش مصنوعی سمت کلاینت پیشنمایش کنید تا مشتریان بالقوه بتوانند مزایای محصول شما را بدون هزینه اضافی برای شما ببینند. این رویکرد ترکیبی همچنین میتواند به شما در مدیریت هزینههای استنتاج، به ویژه در جریانهای کاربری پرکاربرد، کمک کند.

- استفاده آفلاین از هوش مصنوعی : کاربران شما میتوانند حتی زمانی که اتصال اینترنت وجود ندارد، به ویژگیهای هوش مصنوعی دسترسی داشته باشند. این بدان معناست که سایتها و برنامههای وب شما میتوانند طبق انتظار به صورت آفلاین یا با اتصال متغیر کار کنند.

هوش مصنوعی ترکیبی: سمت کلاینت و سمت سرور

در حالی که هوش مصنوعی سمت کلاینت میتواند طیف وسیعی از موارد استفاده را مدیریت کند، برخی از موارد استفاده نیاز به پشتیبانی سمت سرور دارند. هوش مصنوعی سمت سرور گزینه بسیار خوبی برای مدلهای بزرگ است و میتواند طیف وسیعتری از پلتفرمها و دستگاهها را پشتیبانی کند.

اگر درخواست شما مستلزم موارد زیر است، میتوانید رویکرد ترکیبی را در نظر بگیرید:

- پیچیدگی: موارد استفاده خاص و قابل دسترس با هوش مصنوعی روی دستگاه، راحتتر پشتیبانی میشوند. برای موارد استفاده پیچیده، پیادهسازی سمت سرور را در نظر بگیرید.

- انعطافپذیری : به طور پیشفرض از سمت سرور استفاده کنید و وقتی دستگاه آفلاین است یا اتصال ضعیفی دارد، از روی دستگاه استفاده کنید.

- جایگزینی مناسب : پذیرش مرورگرهایی که هوش مصنوعی داخلی دارند زمان میبرد، برخی مدلها ممکن است در دسترس نباشند و دستگاههای قدیمیتر یا کمقدرتتر ممکن است الزامات سختافزاری برای اجرای بهینه همه مدلها را برآورده نکنند. برای این کاربران، هوش مصنوعی سمت سرور ارائه دهید.

برای مثال، اگر از Prompt API داخلی استفاده میکنید، این API فقط در افزونههای کروم، ویندوز، macOS و لینوکس در دسترس است. برای اطمینان از اینکه همه کاربران شما میتوانند از ویژگی هوش مصنوعی شما بهرهمند شوند، یک معماری ترکیبی با Firebase AI Logic راهاندازی کنید.

دسترسی به هوش مصنوعی داخلی

شما میتوانید به قابلیتهای داخلی هوش مصنوعی، عمدتاً با APIهای وظیفه ، مانند API مترجم یا API خلاصهکننده، دسترسی پیدا کنید. APIهای وظیفه برای اجرای استنتاج در برابر بهترین مدل برای تکلیف، چه یک زبان یا یک مدل متخصص، طراحی شدهاند.

چه زمانی از هوش مصنوعی داخلی استفاده کنیم

در اینجا چند روش وجود دارد که هوش مصنوعی داخلی میتواند به شما و کاربرانتان سود برساند:

- مصرف محتوای بهبود یافته با هوش مصنوعی : شامل خلاصهسازی، ترجمه، دستهبندی، توصیف و به عنوان ارائهدهنده دانش.

- تولید محتوای پشتیبانیشده توسط هوش مصنوعی : مانند کمک در نگارش، ویرایش، اصلاح دستور زبان و بازنویسی متن.

تعدادی از APIهای هوش مصنوعی داخلی در نسخههای آزمایشی پایدار و اصلی کروم موجود هستند. APIهای اکتشافی و APIهای مرحله اولیه برای شرکتکنندگان برنامه پیشنمایش اولیه (EPP) در دسترس هستند.

پیشنمایش ویژگیهای جدید

ما به نظرات شما برای شکلدهی به APIها جهت کمک به برآورده کردن موارد استفاده شما و همچنین اطلاعرسانی در مذاکراتمان با سایر فروشندگان مرورگر برای استانداردسازی نیاز داریم.

به EPP بپیوندید تا در مورد ایدههای هوش مصنوعی داخلی در مراحل اولیه بازخورد ارائه دهید و فرصتهایی را برای آزمایش APIهای در حال انجام از طریق نمونهسازی محلی کشف کنید.

تلاش برای استانداردسازی

ما در حال تلاش برای استانداردسازی همه این APIها برای سازگاری با مرورگرهای مختلف هستیم.

رابط برنامهنویسی کاربردی تشخیص زبان (Language Detector API) و رابط برنامهنویسی کاربردی مترجم (Translator API) توسط گروه کاری W3C WebML پذیرفته شدهاند. ما از موزیلا و وبکیت در مورد جایگاهشان در استانداردها سوال کردهایم.

APIهای Summarizer، Writer و Rewriter نیز توسط گروه کاری W3C WebML پذیرفته شدهاند. ما از Mozilla و WebKit در مورد جایگاهشان در استانداردها سوال کردهایم.