Publicado el 14 de abril de 2026

Antes de la IA generativa, probar la IA era similar a otras formas de pruebas de software. Cuando usas el mismo código, datos y configuración, deberías obtener el mismo resultado. Tus pruebas son reproducibles y los algoritmos son deterministas. Tu software es predecible, lo que genera confianza en los usuarios.

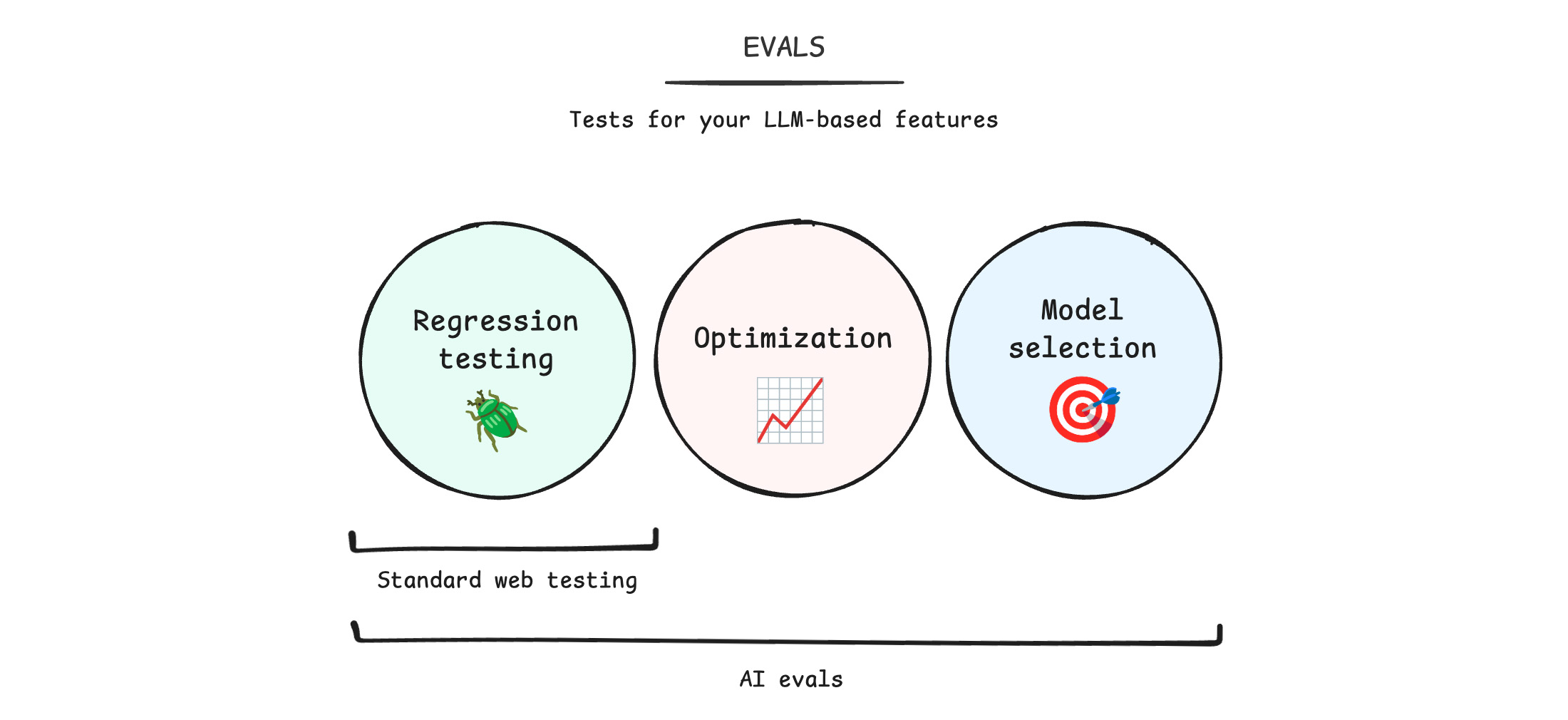

Con la IA generativa, la calidad se vuelve subjetiva en lugar de objetiva. Las pruebas son fundamentales. Cuando realizas pruebas, tu equipo puede enviar las funciones a los usuarios con confianza. Con las evaluaciones de IA (o evals, para abreviar), usas flujos de trabajo nuevos para probar tus aplicaciones.

En las próximas semanas, lanzaremos lecciones sobre las evaluaciones de IA. Comenzaremos con los conceptos básicos: todo lo que necesitas para configurar tu primera canalización de pruebas de IA. Luego, compartiremos técnicas más avanzadas para que puedas seguir iterando y mejorando tus evaluaciones.

Estas son técnicas novedosas en un panorama de IA que cambia rápidamente. Si bien puedes esperar que las herramientas exactas cambien, estas prácticas recomendadas están diseñadas para durar.

Los primeros cuatro módulos estarán disponibles el 16 de abril de 2026.

Participa y comparte comentarios

¿Te entusiasma este curso? ¿Tienes preguntas o temas que te gustaría ver? Nos gustaría conocer tu opinión. Programa una reunión con nosotros, envíanos un mensaje en las redes sociales: BlueSky, LinkedIn, o X.

Únete al Programa de vista previa anticipada para obtener una vista previa de las nuevas APIs de IA y acceder a nuestra lista de distribución.