Publié le 14 avril 2026

Avant l'IA générative, les tests d'IA étaient semblables à d'autres formes de tests logiciels. Lorsque vous utilisez le même code, les mêmes données et les mêmes paramètres, vous devez obtenir le même résultat. Vos tests sont reproductibles et les algorithmes sont déterministes. Votre logiciel est prévisible, ce qui renforce la confiance de vos utilisateurs.

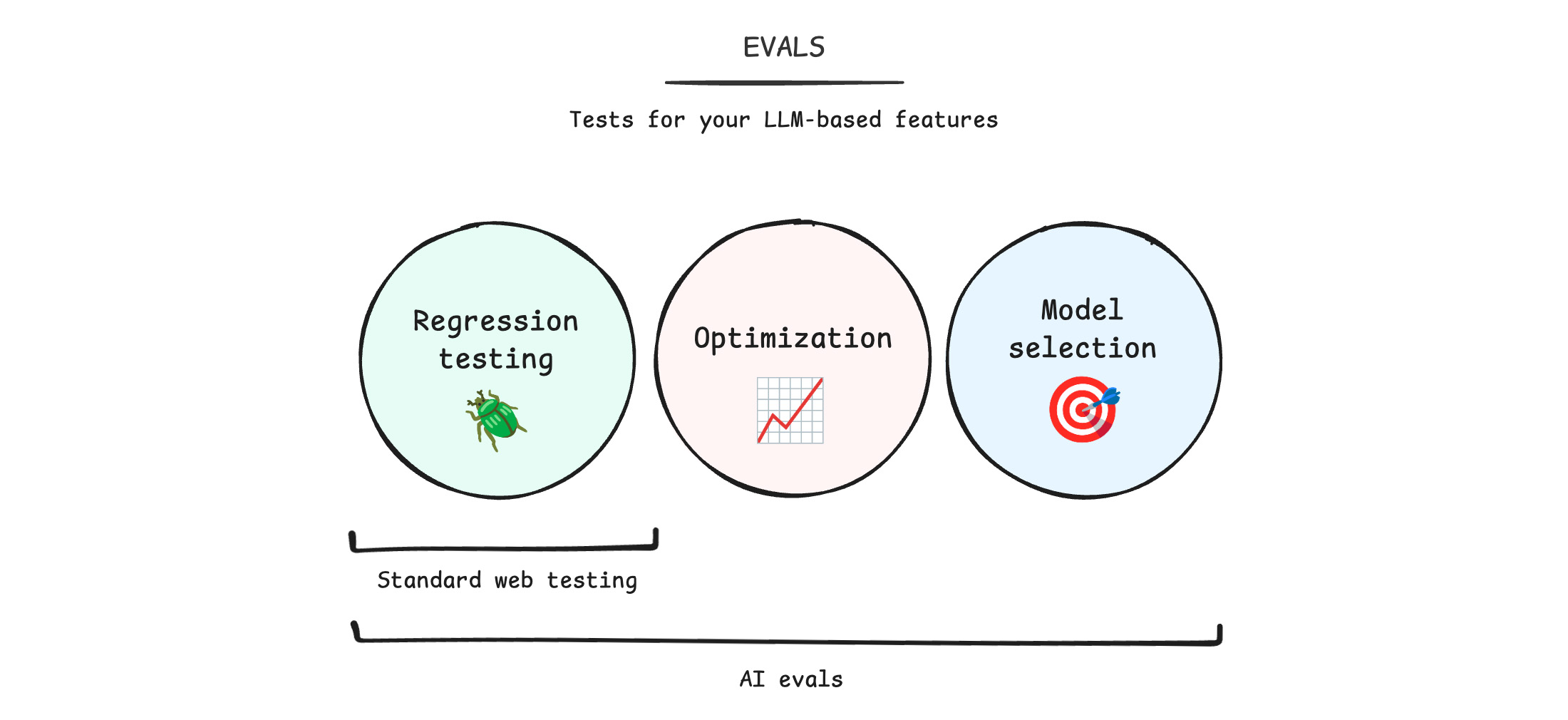

Avec l'IA générative, la qualité devient subjective plutôt qu'objective. Les tests sont essentiels. Lorsque vous effectuez des tests, votre équipe peut proposer vos fonctionnalités à vos utilisateurs en toute confiance. Avec les évaluations d'IA (ou "evals" en abrégé), vous utilisez de nouveaux workflows pour tester vos applications.

Au cours des prochaines semaines, nous publierons des leçons sur les évaluations d'IA. Nous commencerons par les bases : tout ce dont vous avez besoin pour configurer votre premier pipeline de test d'IA. Ensuite, nous partagerons des techniques plus avancées afin que vous puissiez continuer à itérer et à améliorer vos évaluations.

Il s'agit de nouvelles techniques dans un paysage de l'IA en évolution rapide. Bien que les outils exacts puissent changer, ces bonnes pratiques sont conçues pour durer.

Les quatre premiers modules seront disponibles le 16 avril 2026.

Participez et envoyez des commentaires

Ce cours vous intéresse ? Vous avez des questions ou des sujets que vous aimeriez voir abordés ? Nous serions ravis de connaître votre avis. Planifiez une réunion avec nous, envoyez-nous un message sur les réseaux sociaux : BlueSky, LinkedIn, ou X.

Rejoignez le programme d'aperçu anticipé pour découvrir en avant-première les nouvelles API d'IA et accéder à notre liste de diffusion.