Data di pubblicazione: 14 aprile 2026

Prima dell'AI generativa, il test dell'AI era simile ad altre forme di test del software. Quando utilizzi lo stesso codice, gli stessi dati e le stesse impostazioni, dovresti ottenere lo stesso risultato. I test sono riproducibili e gli algoritmi sono deterministici. Il software è prevedibile, il che influenza la fiducia degli utenti.

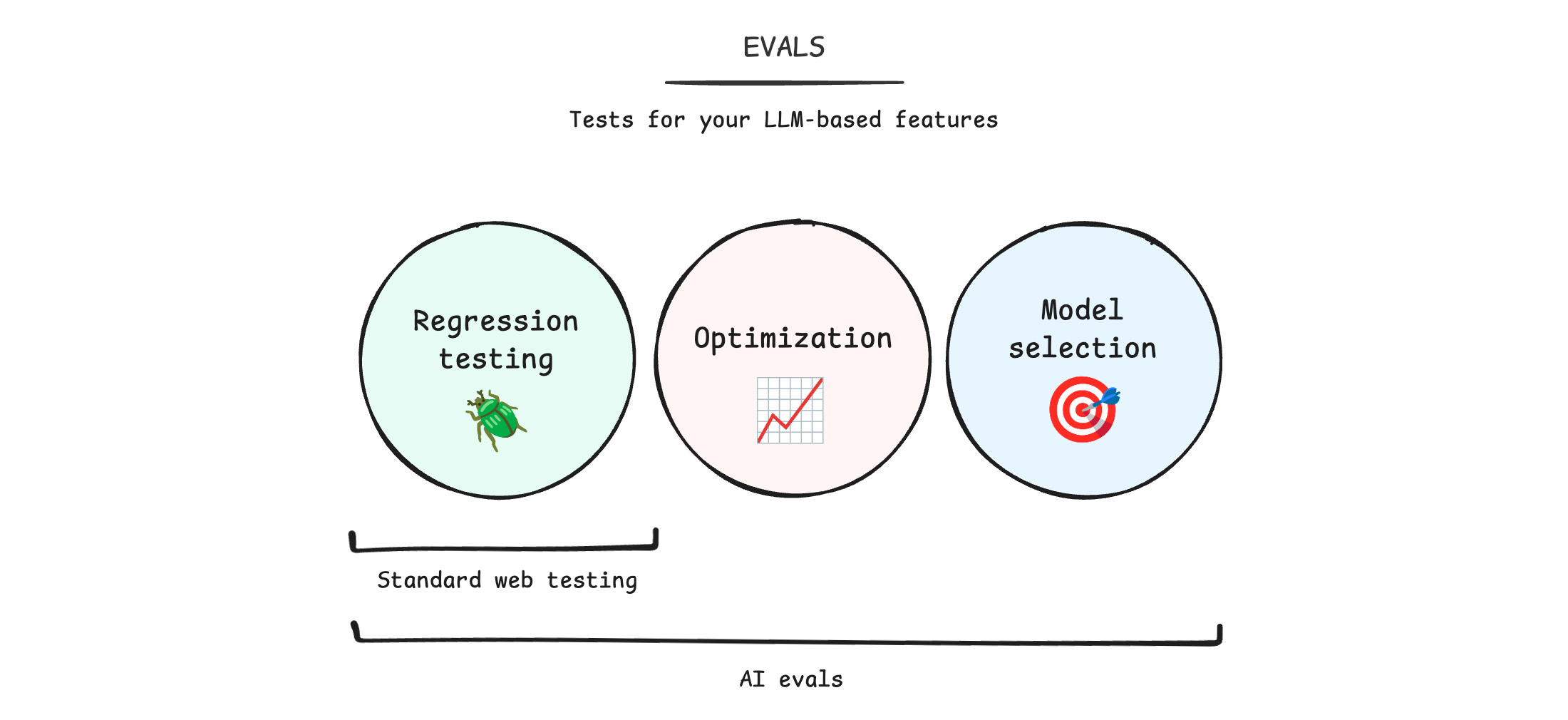

Con l'AI generativa, la qualità diventa soggettiva anziché oggettiva. Il test è fondamentale. Quando esegui i test, il tuo team può distribuire le funzionalità agli utenti con sicurezza. Con le valutazioni dell'AI (o evals, in breve), utilizzi nuovi flussi di lavoro per testare le applicazioni.

Nelle prossime settimane pubblicheremo lezioni sulle valutazioni dell'AI. Iniziamo dalle basi: tutto ciò che ti serve per configurare la prima pipeline di test dell'AI. Poi condivideremo tecniche più avanzate, in modo che tu possa continuare a eseguire iterazioni e migliorare le valutazioni.

Si tratta di nuove tecniche in un panorama dell'AI in rapida evoluzione. Sebbene gli strumenti esatti possano cambiare, queste best practice sono progettate per durare nel tempo.

I primi quattro moduli saranno disponibili il 16 aprile 2026.

Interagisci e condividi il tuo feedback

Ti entusiasma questo corso? Hai domande o argomenti che vorresti vedere? Ci piacerebbe conoscere la tua opinione. Pianifica una riunione con noi, inviaci un messaggio sui social: BlueSky, LinkedIn, o X.

Partecipa al Programma Anteprima per dare un'occhiata in anteprima alle nuove API AI e accedere alla nostra mailing list.