Google uses AI technology to translate content into your preferred language. AI translations can contain errors.

Google uses AI technology to translate content into your preferred language. AI translations can contain errors.

学习我们的 AI 评估课程

使用集合让一切井井有条

根据您的偏好保存内容并对其进行分类。

发布时间:2026 年 4 月 14 日

在生成式 AI 出现之前,测试 AI 与其他形式的软件测试类似。

当您使用相同的代码、数据和设置时,应该会得到相同的结果。

您的测试是可重现的,并且

算法是确定性的。

您的软件是可预测的,这会影响用户的信任度。

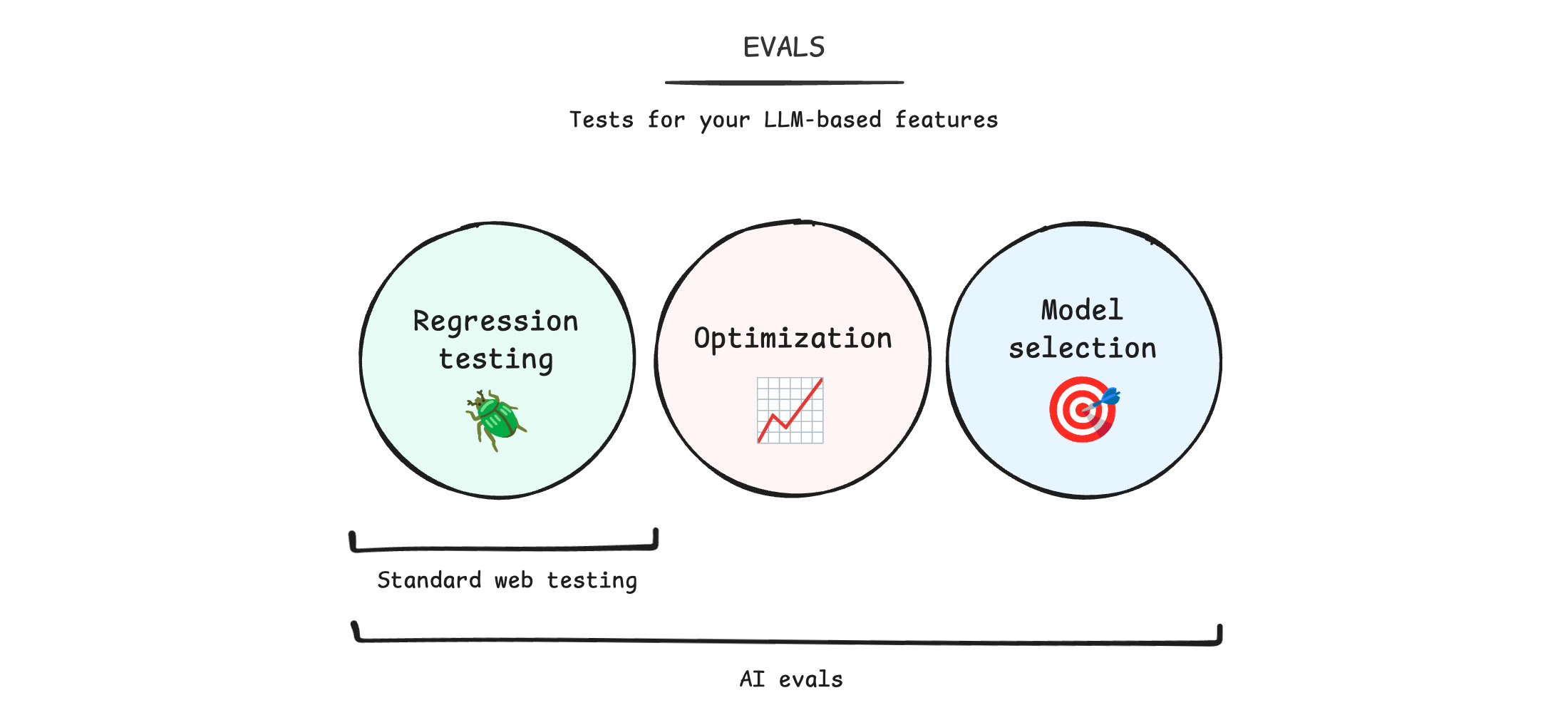

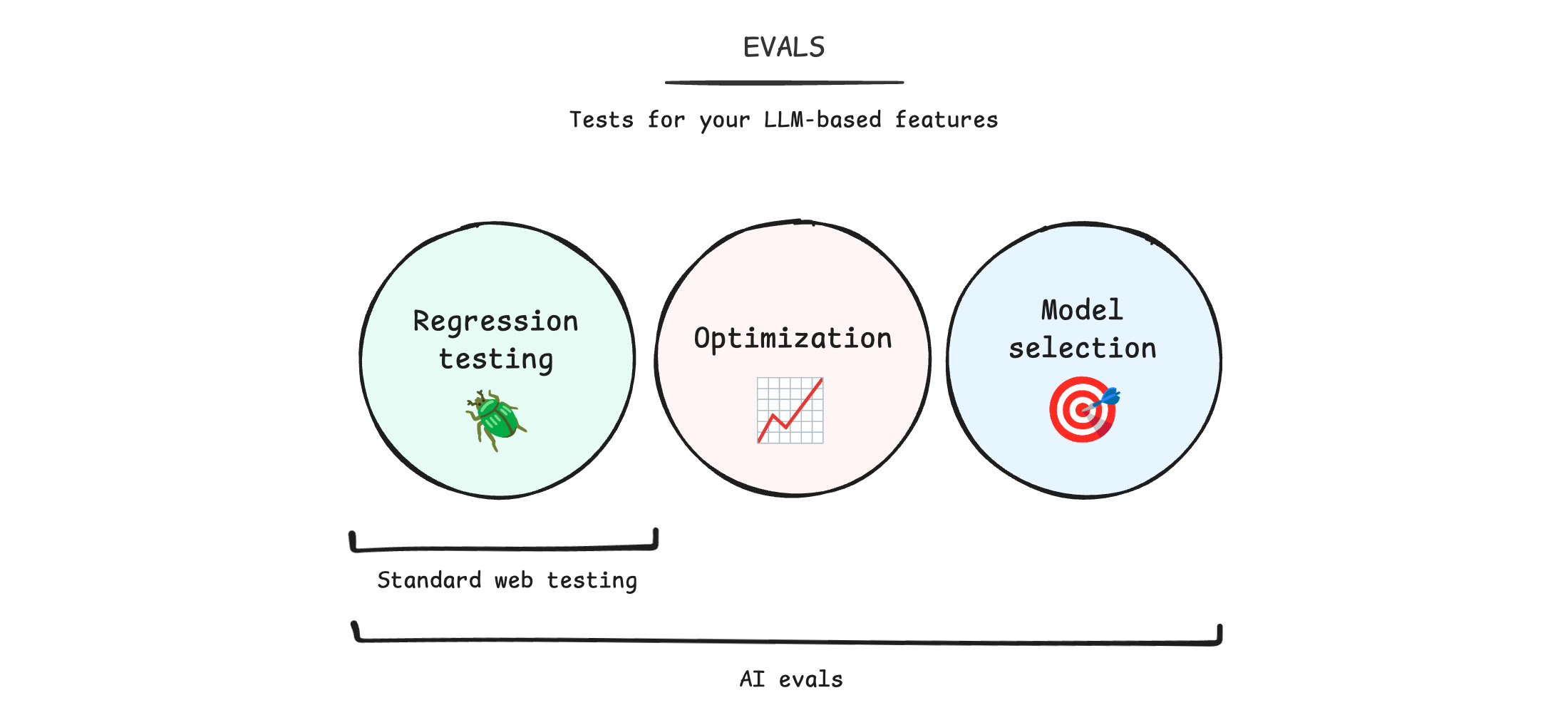

有了生成式 AI,质量就变成了主观的,而不是客观的。测试至关重要。通过测试,您的团队可以放心地向用户发布功能。借助 AI 评估(简称 evals),您可以使用新的工作流来测试应用。

在接下来的几周内,我们将发布有关 AI 评估的课程。我们首先介绍基础知识:设置第一个 AI 测试流水线所需的一切。然后,我们将分享更高级的技术,以便您继续迭代和改进评估。

这些是在快速变化的 AI 领域中的新颖技术。

虽然您可以预期确切的工具会发生变化,但这些最佳实践是持久的。

前四个模块将于 2026 年 4 月 16 日上线。

参与互动并分享反馈

您对本课程感到兴奋吗?您是否有想要了解的问题或主题?

我们很想听听您的想法。

请与我们安排会议,

或在社交媒体上向我们发送消息:BlueSky、

LinkedIn或

X。

加入 Early Preview Program,抢先了解新的 AI API 并访问我们的邮件列表。

如未另行说明,那么本页面中的内容已根据知识共享署名 4.0 许可获得了许可,并且代码示例已根据 Apache 2.0 许可获得了许可。有关详情,请参阅 Google 开发者网站政策。Java 是 Oracle 和/或其关联公司的注册商标。

最后更新时间 (UTC):2026-04-14。

[[["易于理解","easyToUnderstand","thumb-up"],["解决了我的问题","solvedMyProblem","thumb-up"],["其他","otherUp","thumb-up"]],[["没有我需要的信息","missingTheInformationINeed","thumb-down"],["太复杂/步骤太多","tooComplicatedTooManySteps","thumb-down"],["内容需要更新","outOfDate","thumb-down"],["翻译问题","translationIssue","thumb-down"],["示例/代码问题","samplesCodeIssue","thumb-down"],["其他","otherDown","thumb-down"]],["最后更新时间 (UTC):2026-04-14。"],[],[]]