क्या काम करता है और क्या नहीं: एलएलएम की नई दुनिया में वेब टेस्टिंग से जुड़ी अपनी जानकारी को मैप करना.

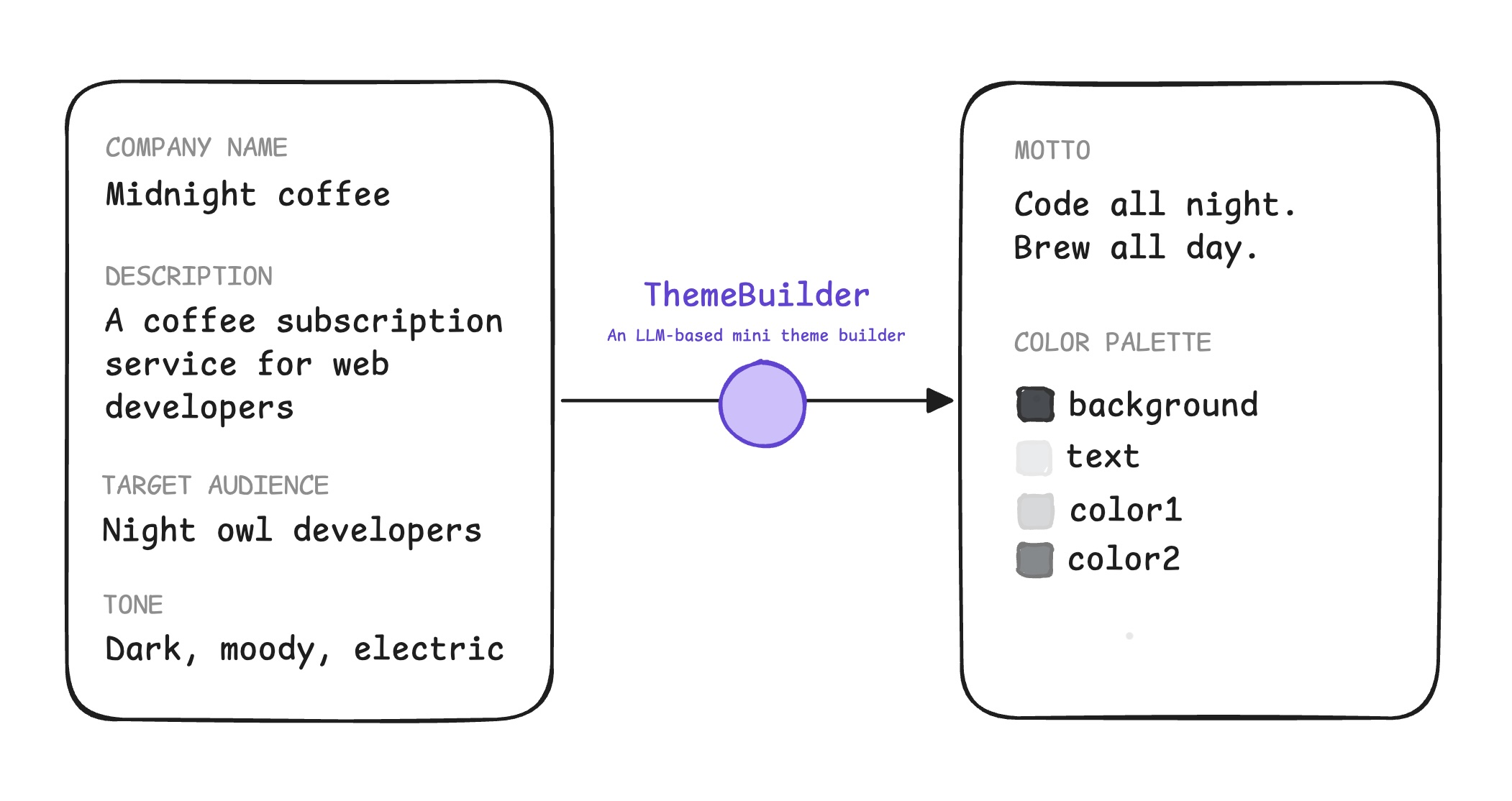

ऐप्लिकेशन का उदाहरण

इस सीरीज़ में, ThemeBuilder को उदाहरण के तौर पर इस्तेमाल किया गया है. ThemeBuilder, एक JSON ऑब्जेक्ट आउटपुट करता है. इसमें एलएलएम से जनरेट किया गया मोटो और कलर पैलेट होता है.

- मोटो और पैलेट, ब्रैंड के नाम, ब्यौरे, ऑडियंस, और टोन से मेल खाने चाहिए.

- मोटो आपत्तिजनक नहीं होना चाहिए. साथ ही, यह छोटा होना चाहिए. इसमें छह से ज़्यादा शब्द नहीं होने चाहिए.

- कलर पैलेट का कंट्रास्ट, WCAG की बुनियादी गाइडलाइन के मुताबिक ऐक्सेस किया जा सकने वाला होना चाहिए. साथ ही, इसका कंट्रास्ट अनुपात 4.5:1 होना चाहिए.

ऑब्जेक्टिव और सब्जेक्टिव आकलन

यह कैसे पता चलेगा कि ThemeBuilder सही तरीके से काम कर रहा है?

नियमों के आधार पर आकलन करने की सुविधा (कभी-कभी इसे सटीक आकलन भी कहा जाता है) एक ऑब्जेक्टिव टेस्ट है. इसमें जवाब सही या गलत के तौर पर दिया जाता है. ये जवाब, डेटा फ़ॉर्मैट, कंट्रास्ट रेशियो या अन्य ऐसे सवालों के लिए सबसे सही होते हैं जिनके जवाब तय होते हैं. इन टेस्ट को रेगुलर और प्रोग्राम के हिसाब से तैयार किए गए कोड की मदद से लागू किया जा सकता है.

कुछ जांचों में, सही या गलत के तौर पर जवाब दिया जाता है. ये सवाल, डेटा फ़ॉर्मैट, कंट्रास्ट रेशियो या अन्य ऐसे सवालों के लिए सबसे सही होते हैं जिनका जवाब तय होता है. इन जांचों को सामान्य, प्रोग्राम के हिसाब से बनाए गए कोड की मदद से लागू किया जा सकता है. इन्हें नियमों पर आधारित आकलन या सटीक आकलन कहा जाता है.

उदाहरण के लिए:

// Example rule-based eval: data format

function evaluateFormat(appOutput) {

// Check if JSON is valid, colors are hex, no empty strings, motto is 6 words or fewer

// Use deterministic tools like zod for schema validation

return "PASS"; // or "FAIL"

}

अन्य जांचें व्यक्तिपरक होती हैं. जैसे, मोटो और कलर पैलेट के लिए ब्रैंड और ऑडियंस का अलाइनमेंट. बुरे बर्ताव का पता लगाना, कैटगरी में बांटने का काम है. हालांकि, यह व्यक्तिपरक भी है, क्योंकि इसमें फ़ैसला लेना शामिल होता है.

हालांकि, सब्जेक्टिव टेस्ट में भी क्लासिफ़िकेशन शामिल होता है, लेकिन सही और गलत की रेंज में काफ़ी अंतर हो सकता है. उदाहरण के लिए, ब्रैंड और ऑडियंस के हिसाब से, मोटो और कलर पैलेट का आकलन करना. बुरे बर्ताव का पता लगाना भी व्यक्तिपरक होता है.

ऐसा लग सकता है कि किसी विषय के बारे में जानकारी देने वाले कॉन्टेंट की क्वालिटी का आकलन सिर्फ़ कोई विशेषज्ञ ही कर सकता है. हालांकि, LLM-as-a-judge तकनीक का इस्तेमाल करके, इन टेस्ट को बड़े पैमाने पर ऑटोमेट किया जा सकता है.

[एलएलएम जजों] का इस्तेमाल करना आसान है और ये तेज़ी से काम करते हैं. साथ ही, ये काफ़ी सस्ते भी हैं [...] यह प्रोडक्शन में एआई मॉडल का आकलन करने के सबसे सामान्य तरीकों में से एक बन गया है.

—एआई इंजीनियरिंग, चिप ह्यून

उदाहरण के लिए:

// Example LLM-as-a-judge eval for a subjective quality like brand fit

async function evalBrandFit(userInput, appOutput) {

const brandPrompt = `You are an expert brand strategist. Evaluate the

following generated motto for the company whose target audience is

${userInput.audience}, and who describes itself as

${userInput.companyDescription}: ${appOutput.motto}`

// Call the LLM judge

const evalResult = evalWithLLM(brandPrompt);

// Return the consolidated results

return {

mottoBrandFit: evalResult,

};

}

// Helper that communicates with the LLM API

async function evalWithLLM(prompt) {

// ... Call LLM with the prompt ...

// ... Parse the resulting judgement ("PASS" or "FAIL") + rationale

return {

status: "PASS",

rationale: "This motto perfectly captures the brand and tone, because..."

};

}

यह मॉडल, इंसानों के फ़ैसलों की नकल करता है. इसलिए, आपको जज को यह बताना होगा कि आपको किस तरह का जवाब चाहिए. इसके लिए, जज को रूब्रिक दिया जा सकता है.

रूब्रिक, स्कोरिंग के दिशा-निर्देशों या शर्तों का एक स्ट्रक्चर्ड सेट होता है. इसका इस्तेमाल, जज (इंसान या एआई) किसी आउटपुट का आकलन करने के लिए करता है. यह हर आकलन में, व्यक्तिपरक क्वालिटी का आकलन करने के लिए एक जैसा फ़्रेमवर्क उपलब्ध कराता है.

अन्य तरह के आकलन

आपको रेफ़रंस-आधारित या जोड़े के हिसाब से आकलन का इस्तेमाल करना पड़ सकता है.

रेफ़रंस के आधार पर

ये मेट्रिक, जवाब के सही जवाब से मिलते-जुलते होने का आकलन करती हैं. इनका इस्तेमाल अनुवाद या तकनीकी तथ्यों जैसे कामों के लिए करें, जहाँ पहले से ही कोई अच्छा जवाब मौजूद हो.

पेयरवाइज़

ऐसा हो सकता है कि जज दो अलग-अलग वर्शन को PASS स्कोर दे, भले ही एक वर्शन दूसरे से बेहतर हो. पेयरवाइज़ मूल्यांकन में, जज को एक ही इनपुट के लिए दो आउटपुट (A और B) दिए जाते हैं. साथ ही, जज को यह निर्देश दिया जाता है कि वह इनमें से किसी एक को विजेता के तौर पर चुने. इससे इस समस्या को हल किया जा सकता है.

उदाहरण के लिए, मान लें कि आपको एक कैफ़े के लिए आदर्श वाक्य का आकलन करना है:

Input: "Friendly cafe"

Pointwise evaluation:

Output A: "Come get coffee." // PASS

Output B: "Your morning smile in a cup." // PASS

2 PASS. Unconclusive!

Pairwise evaluation:

Output B wins. It captures the "friendly" tone more effectively than the generic Output A.

पेयरवाइज़ मूल्यांकन का इस्तेमाल करके, यह चुना जा सकता है कि आपको अपने मॉडल का कौनसा वर्शन डिप्लॉय करना है. इसके अलावा, इसका इस्तेमाल दो अलग-अलग प्रॉम्प्ट की तुलना करने के लिए भी किया जा सकता है.

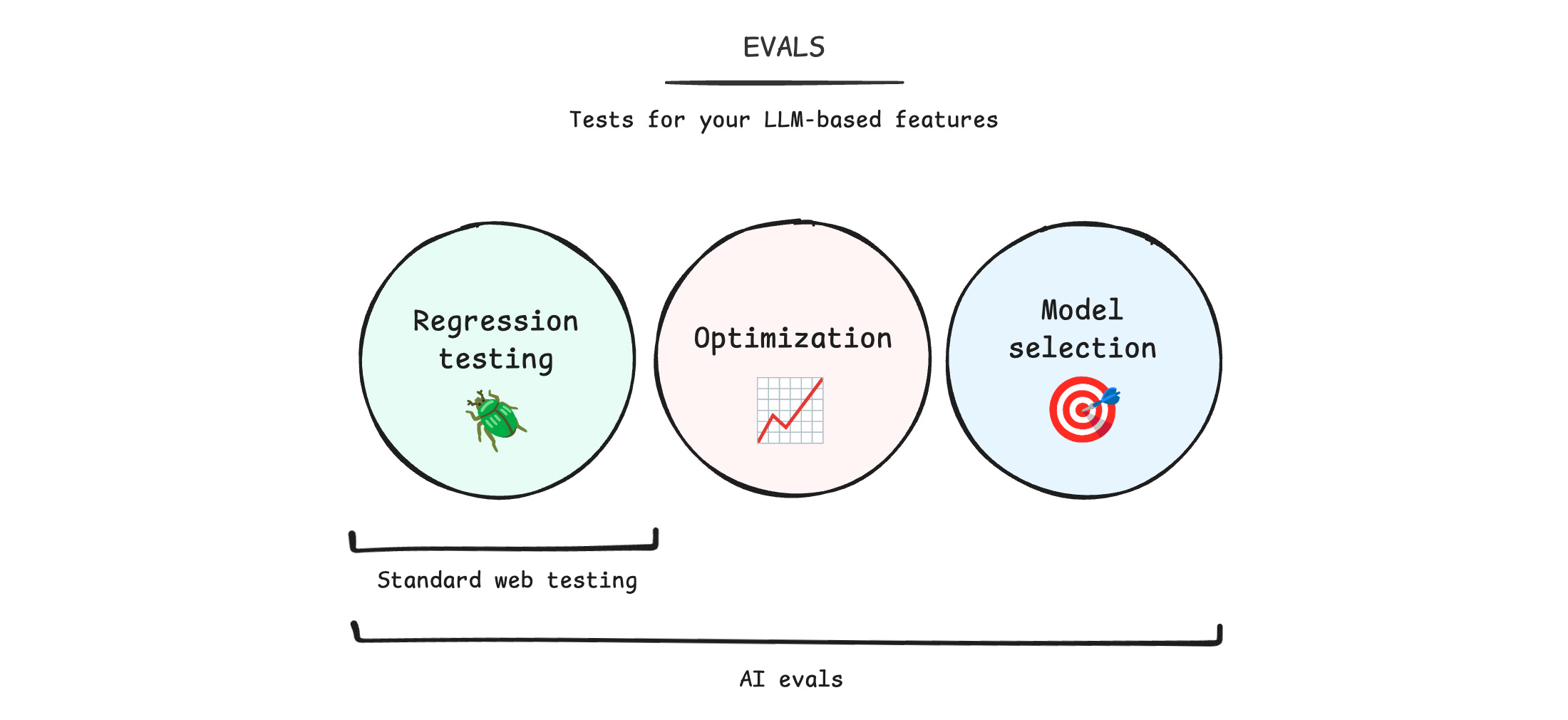

स्टैंडर्ड वेब टेस्टिंग बनाम एआई की मदद से आकलन करना

हम मानते हैं कि इस कोर्स को पढ़ने वाले व्यक्ति को, वेबसाइट और वेब ऐप्लिकेशन की जांच करने का तरीका पहले से पता है. एआई को शामिल करते समय, आपको अपने मौजूदा मेंटल मॉडल को बदलना होगा. एआई की मदद से आकलन करने की सुविधा का इस्तेमाल करके, ये कार्रवाइयां की जा सकती हैं:

- रिग्रेशन टेस्टिंग करें: क्या प्रॉम्प्ट या मॉडल बदलने पर, ऐप्लिकेशन काम करना बंद कर देता है? क्या आपको खराब कलर पैलेट या आपत्तिजनक नारे मिल रहे हैं? वेब ऐप्लिकेशन में, ब्रेक एक सॉफ़्टवेयर फ़ंक्शन होता है. हालांकि, यहां आपको यह देखना है कि एलएलएम का आउटपुट अच्छी क्वालिटी का है या नहीं और सुरक्षित है या नहीं. इसमें व्यक्तिपरक राय शामिल होती है.

- अपने आवेदन को ऑप्टिमाइज़ करें: क्या आपका आवेदन बेहतर हो रहा है? क्या आपको अपनी पसंद की मेट्रिक में सुधार दिख रहा है? उदाहरण के लिए, क्या आपको टॉक्सिसिटी बढ़ाए बिना, ब्रैंड के ज़्यादा नारे मिल रहे हैं?

- सही मॉडल चुनें: क्या आपके इस्तेमाल के हिसाब से कोई बेहतर मॉडल उपलब्ध है? एआई के बिना, आपको वेब स्टैक को एक बार चुनना होता है. एआई की मदद से, आपको नियमित तौर पर मॉडल की तुलना करनी चाहिए. इससे आपको बेहतर (और संभावित रूप से सस्ता) मॉडल पर स्विच करने के अवसरों की पहचान करने में मदद मिलती है.

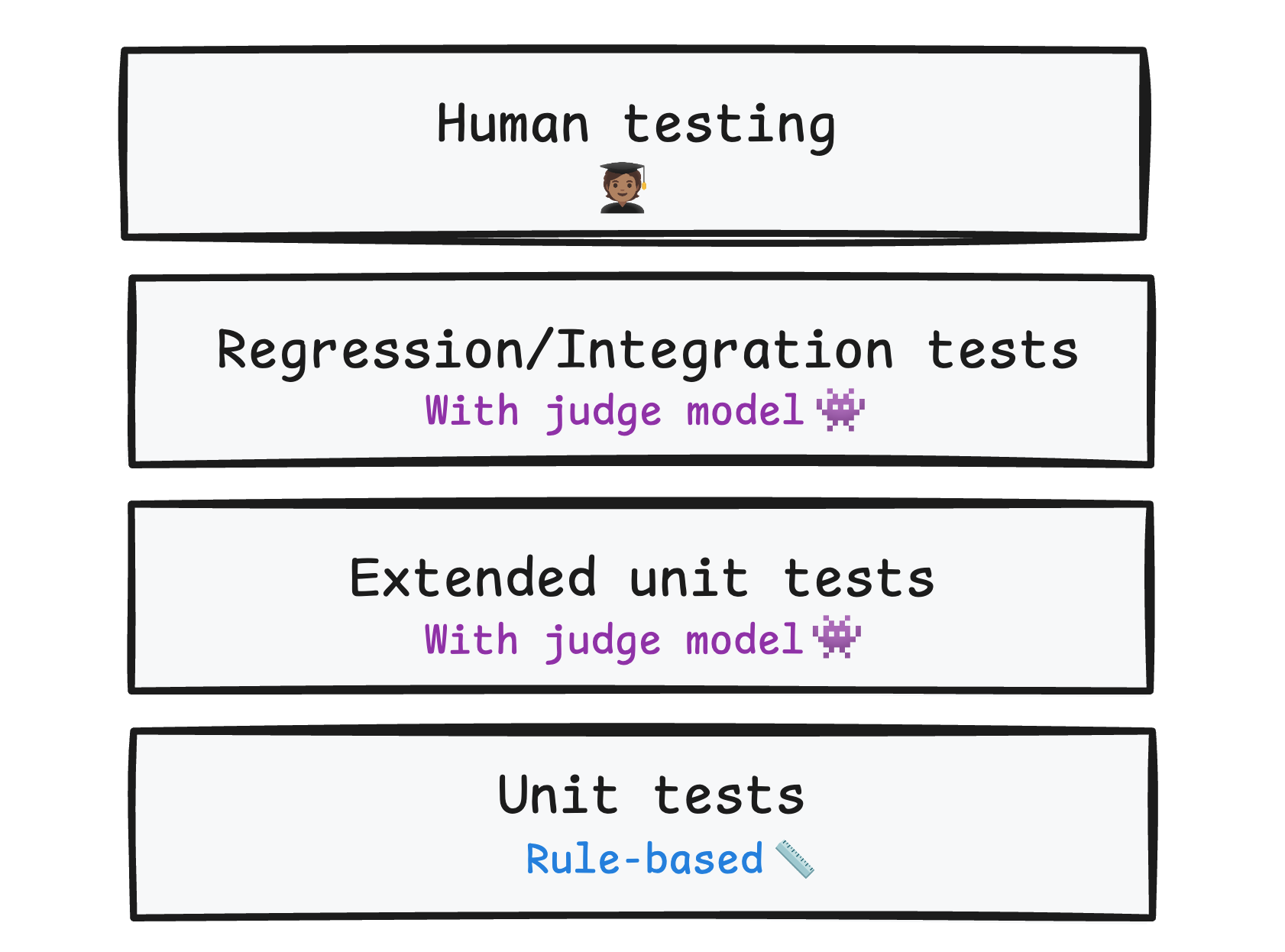

टेस्ट को लेयर करना

एक अच्छे कोडबेस में कई तरह के टेस्ट होने चाहिए: यूनिट टेस्ट, रिग्रेशन और इंटिग्रेशन टेस्ट, और एंड-टू-एंड टेस्ट. आपके आकलन भी लेयर वाले होने चाहिए.

- अपने एआई ऐप्लिकेशन के लिए टेस्ट को पूरी तरह से अपने-आप होने की सुविधा के साथ चलाने के लिए, नियम-आधारित आकलन और एलएलएम-एज़-ए-जज आकलन का एक साथ इस्तेमाल करें. इस तरह, रोज़ाना के डेवलपमेंट और सीआई/सीडी में आने वाली समस्याओं का पता लगाया जा सकता है. साथ ही, यह भी जांच की जा सकती है कि रिलीज़ कैंडिडेट, क्वालिटी बार की ज़रूरी शर्तें पूरी करते हैं या नहीं.

- बड़े पैमाने पर क्वालिटी की पुष्टि करने के लिए, इंटिग्रेशन और रिग्रेशन टेस्ट चलाएं.

- स्वीकार्यता की जांच के तौर पर, मैन्युअल तरीके से लोगों से आकलन करवाएं.

बिल्ड टाइम पर किए जाने वाले इन आकलन के अलावा, रनटाइम आकलन की मदद से प्रोडक्शन ट्रैफ़िक की निगरानी करें. इनसे आपको असल दुनिया से मिले इनपुट में क्वालिटी या सुरक्षा से जुड़ी समस्याओं का पता लगाने में मदद मिल सकती है.

अपने आकलन को बेहतर बनाते रहना

आपके ऐप्लिकेशन के साथ-साथ, Evals की संख्या भी बढ़नी चाहिए. आपके मॉडल बेहतर होते जाते हैं, इसलिए अपने पुराने आकलन अपडेट करें.

अपने टेस्ट डेटासेट में मुश्किल उदाहरण नियमित रूप से जोड़ें. जैसे, नए एज केस या प्रोडक्शन में मिले हैरान करने वाले उपयोगकर्ता इनपुट.

आपके आकलन से किस चीज़ का पता चलता है?

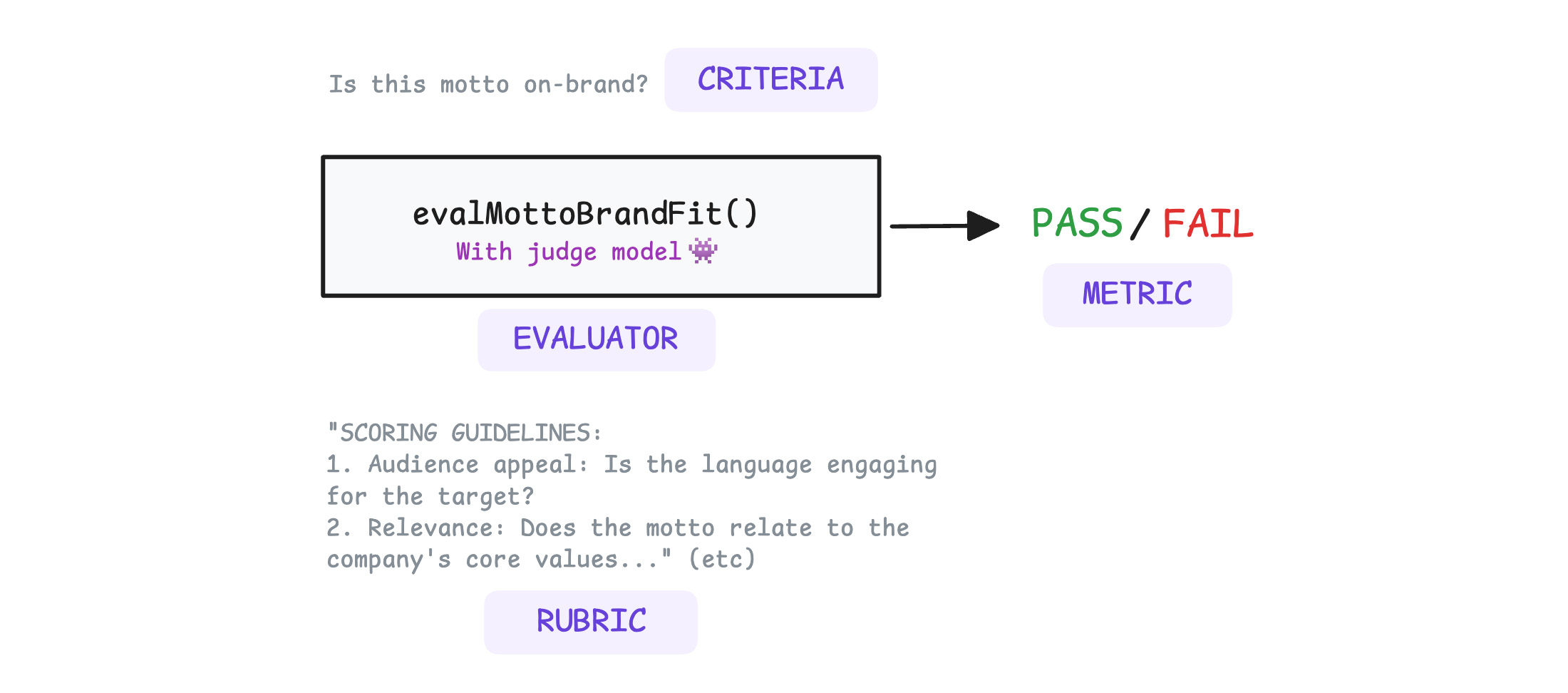

इवैल तैयार करने से पहले, आपको यह समझना चाहिए कि आउटपुट का आकलन कैसे किया जाता है. यहां कुछ ऐसे शब्द दिए गए हैं जिनके बारे में आपको जानना होगा.

शर्तें वे नियम और डाइमेंशन होते हैं जिनकी जांच करनी होती है. उदाहरण के लिए, ब्रैंड के हिसाब से सही होना, आपत्तिजनक कॉन्टेंट, और सुलभता.

हर आकलन के मानदंड को एक मेट्रिक से मापा जाता है. मेट्रिक एक ऐसा स्कोर होता है जो मॉडल के आउटपुट को मानदंड के हिसाब से मेज़र करता है. यह स्कोर, बाइनरी या किसी रेंज में मौजूद वैल्यू हो सकती है. इससे यह पता चलता है कि आउटपुट, आकलन करने वाले व्यक्ति की उम्मीद के मुताबिक कितना सही या गलत है.

अलग-अलग तरह की मेट्रिक का इस्तेमाल करके, एक ही मानदंड को मेज़र किया जा सकता है. उदाहरण के लिए, ब्रैंड के हिसाब से विज्ञापन दिखाने के लिए:

- "क्या यह नारा ब्रैंड के हिसाब से सही है?" मेट्रिक

PASSयाFAILहै. - "ब्रैंड के हिसाब से, यह आदर्श वाक्य कितना सही है? इसे 1 से 5 के बीच रेटिंग दें." यह मेट्रिक, एक से पांच के बीच का पूर्णांक होती है.

आकलन करने वाला, कोड या मॉडल होता है. यह कोड या मॉडल, मानदंड के हिसाब से स्कोर देता है. इवैल्यूएटर, मेट्रिक तय करते हैं.