La magia de los LLM puede tentarnos a omitir las pruebas, pero las evaluaciones son la clave para lanzar productos con confianza.

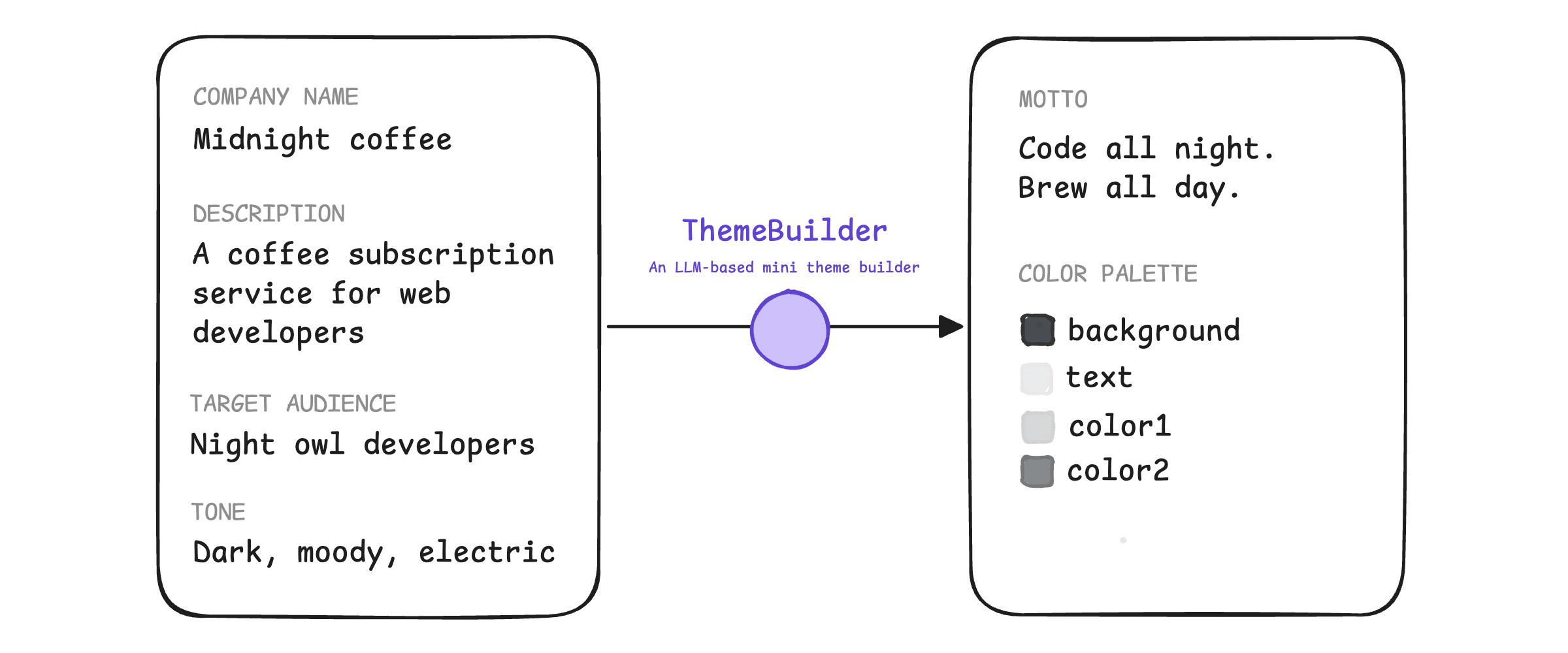

Imagina que estás creando un prototipo de un creador de temas basado en la Web. Es una herramienta divertida: en una aplicación web, un usuario ingresa el nombre y la descripción de una empresa, un público objetivo, y un tono y un estado de ánimo. El frontend envía esta información a tu servidor. Tu servidor usa un modelo de lenguaje grande (LLM) para generar un lema creativo que coincida con el tono y el estado de ánimo esperados, y una paleta de colores accesible alineada con la marca. Muestra estos datos como un pequeño objeto JSON.

Llamaremos a esta aplicación ThemeBuilder.

Eliges un LLM de base y realizas iteraciones en la instrucción. A tu diseñador interno le gustan las paletas de colores y los lemas suenan pegadizos.

Ahora, tienes las siguientes preguntas:

- ¿Está todo listo para la producción? No sabes si la calidad del resultado de tu aplicación es lo suficientemente coherente. Algunos evaluadores internos informan que las paletas están rotas o que los lemas no son de la marca. Cuando corriges un caso, aparecen dos errores más.

- ¿Puedo cambiar de modelo? Es posible que quieras actualizar a la versión más reciente del mismo LLM para ahorrar latencia o cambiar de un servicio administrado a un modelo autoalojado para reducir los costos. No sabes si eso mejorará o empeorará la salida de tu aplicación, no tienes forma de probar las regresiones.

- ¿Es seguro lanzar el producto? Alguien informó una vez una salida tóxica, pero no puedes reproducirla. ¿Es una casualidad o deberías bloquear el lanzamiento?

Tu equipo detiene el lanzamiento porque la calidad de la salida del LLM varía demasiado. Es difícil generar la confianza para lanzar sin pruebas.

¿Por qué adivinar en lugar de probar?

Cuando se compila por primera vez con IA, es tentador observar algunas salidas, decidir que se ven bien y seguir adelante. ¿Por qué podrías confiar en la intuición en lugar de las mediciones y los datos?

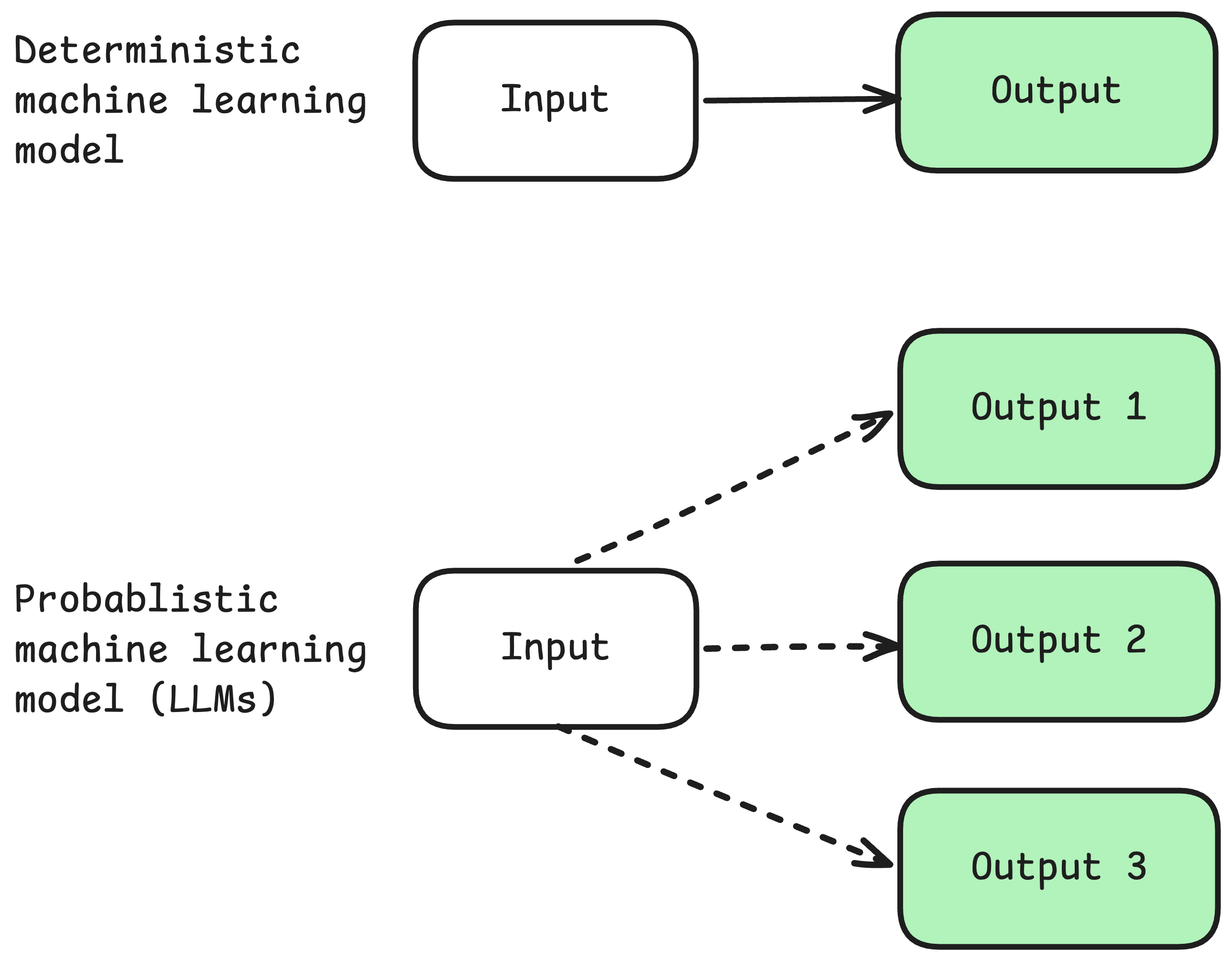

Es probable que lo hagas porque los LLM son probabilísticos en lugar de deterministas. Esto significa que, incluso cuando proporcionas el mismo nombre, descripción, público y tono de la empresa, ThemeBuilder puede generar un lema y una paleta de colores diferentes.

No hay una única respuesta correcta para lo que es un lema pegadizo o una paleta de colores de la marca.

La creatividad de los LLM es excelente. Sin embargo, el no determinismo se siente en desacuerdo con la idea de la ingeniería. Por lo tanto, puedes concluir que las aplicaciones basadas en LLM probablemente no se puedan probar.

Evaluaciones al rescate

En el mundo de los LLM, las prácticas recomendadas de desarrollo siguen siendo válidas. Podemos y debemos probar nuestras aplicaciones basadas en LLM. Solo necesitamos técnicas diferentes. Estas técnicas se denominan evaluaciones o, de forma abreviada, evals. Las evaluaciones implican flujos de trabajo nuevos, pero tu experiencia de prueba existente se transfiere directamente a la creación de excelentes evaluaciones.

Las evaluaciones son pruebas para tus funciones de IA. Estas pruebas te ayudan a crear un circuito de retroalimentación clave: si compilas una canalización de evaluaciones sólida, las funciones basadas en LLM funcionarán bien para tus usuarios. Luego, tu equipo puede lanzar tus funciones con confianza.

Si compilas con LLM, aprender a implementar evaluaciones sólidas es uno de los mejores usos de tu tiempo.

Ahora, obtén información sobre las evaluaciones.