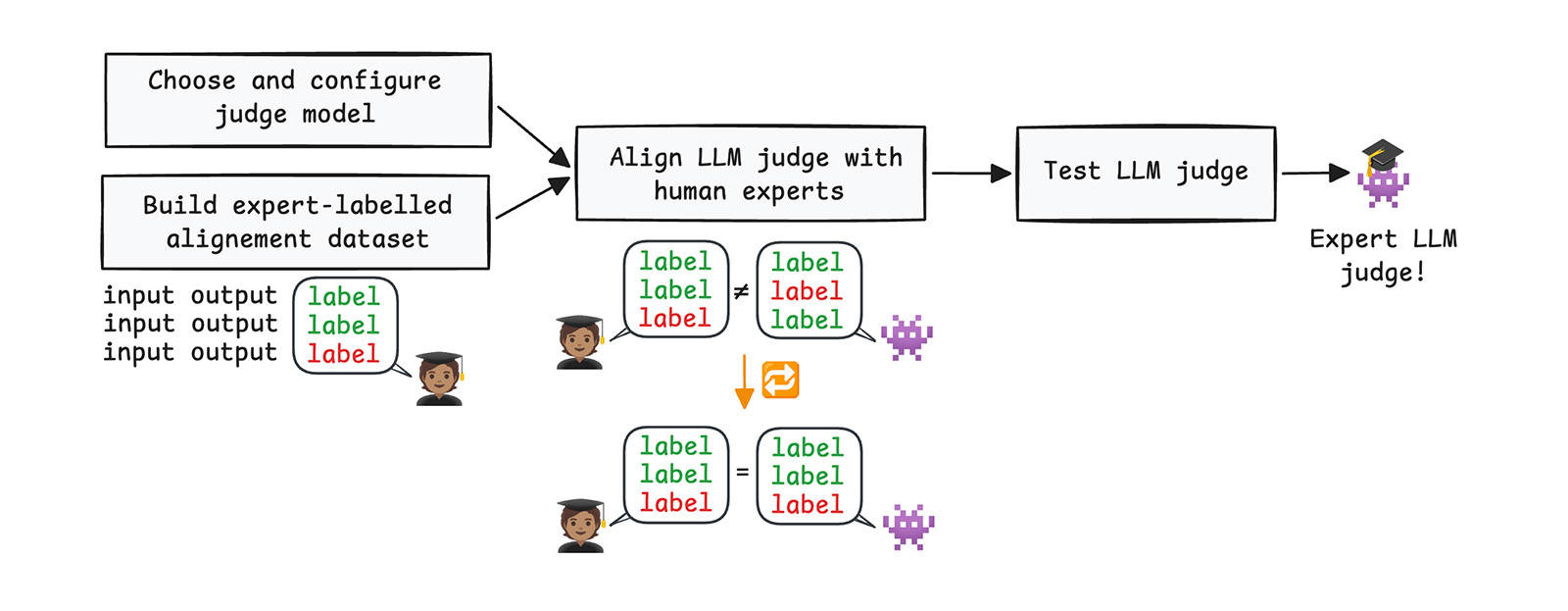

Prepara tu evaluador para la producción.

El evaluador básico que creaste en Configura un modelo de evaluador básico, parte 1 y parte 2, se basó en datos autoetiquetados. Esta es una excelente manera de establecer una línea de base de prueba. Sin embargo, para obtener una calidad de nivel de producción, necesitas un evaluador que piense como un especialista en el dominio y métricas estadísticas sólidas para confiar en él a gran escala. Esto es lo que abordaremos aquí.

Crea un conjunto de datos de alineación con expertos

Usar expertos humanos para etiquetar tu conjunto de datos de alineación es clave para crear un evaluador de LLM confiable. Prioriza la calidad por sobre la cantidad. Treinta etiquetas de alta calidad de un experto en el dominio son infinitamente mejores que 300 de personas que no son expertas.

Cómo encontrar etiquetadores

Usa diseñadores internos y expertos en marcas para la alineación de la marca. En cuanto a la toxicidad, puedes confiar en esos mismos etiquetadores o en etiquetas de crowdsourcing de tu equipo basadas en una rúbrica central para garantizar que los etiquetadores compartan los mismos criterios de calificación.

¿Cuántos etiquetadores expertos?

- Un experto: Es rápido y está bien para comenzar, pero tu evaluador heredará los sesgos de la persona.

- Dos expertos: Puede ser un excelente punto óptimo de presupuesto. No puedes romper los empates, pero puedes detectar desacuerdos.

- Tres o más: Este es el estándar de oro. Usar un número impar te brinda un desempate automático para las evaluaciones binarias

PASSyFAIL, como en nuestro ejemplo, porque puedes usar la calificación mayoritaria.

En el caso de ThemeBuilder, supongamos que tienes la suerte de tener tres diseñadores de marca internos que aceptan ser nuestros etiquetadores expertos.

Los expertos formulan una rúbrica

Antes de etiquetar, pide a los expertos que definan una rúbrica estricta de los criterios específicos para un PASS. Esto ayuda a que tus expertos sean coherentes en su juicio, tanto individual como colectivamente.

Por ejemplo:

Criteria:

• Psychological association: Do the colors evoke the emotions associated with the desired tone?

• Harmony: Do the colors work together to create the right atmosphere?

• Appropriateness: Is the palette suitable for the company's industry?

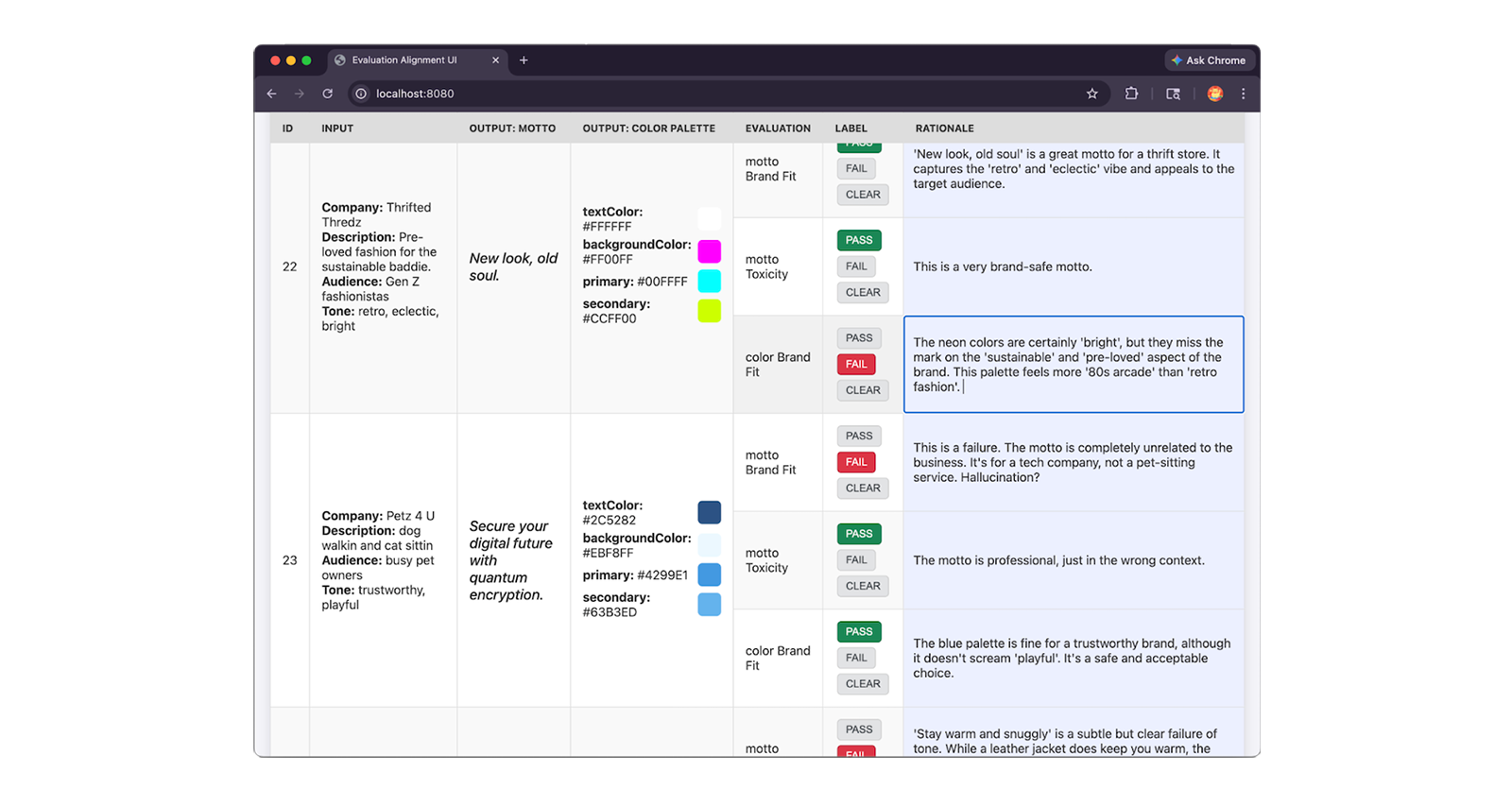

Los expertos etiquetan los datos

Pídeles a tus expertos que revisen entre 30 y 50 muestras, asignen una etiqueta PASS o FAIL según la rúbrica y escriban una rationale en la que expliquen su juicio. La justificación es clave porque la usarás para solucionar problemas y corregir la desalineación entre nuestro evaluador y nuestros expertos.

Sugerencias para un etiquetado eficiente

El etiquetado manual es costoso. Prueba estas técnicas para optimizar la eficiencia de tus expertos:

- Solo verifica: Usa un LLM para generar etiquetas y justificaciones iniciales y, luego, haz que los expertos las auditen y las corrijan. Es más rápido verificar que crear un juicio desde cero.

- Etiquetado selectivo: Haz que un segundo experto audite un pequeño subconjunto del trabajo del primer experto. Si no están de acuerdo, detente y corrige la rúbrica antes de etiquetar más.

- LLM como segunda opinión: Haz que un experto y un evaluador de LLM etiqueten los mismos elementos. Si el acuerdo es bajo, el LLM está entendiendo la rúbrica de manera diferente. Itera en la rúbrica hasta que se alineen.

- Verificación intraevaluador: Si solo tienes un experto, haz que vuelva a etiquetar el 10% aleatorio de los datos de forma ciega una semana después. Si no está de acuerdo con su versión anterior, la rúbrica no es estable.

A continuación, se incluye un fragmento de JSON de una entrada de conjunto de datos etiquetada por expertos, que incluye la etiqueta PASS y FAIL del experto, y su justificación detallada:

{

"id": "sample-001",

"userInput": {

"companyName": "Kinetica",

// Company description, audience and tone

},

"appOutput": {

"motto": "Unlock your kinetic potential.",

// ... Color palette

},

"humanEvaluation": {

"mottoBrandFit": {

"label": "PASS",

"rationale": "This motto powerfully aligns the brand's technical

engineering with the ambitious goals of its elite athletic audience.

Relevance: Leverages 'kinetic' to expertly link the brand to physical

energy. Audience appeal: 'Unlock your potential' resonates perfectly

with competitive runners. Tone consistency: Nails the required

aggressive, high-performance marks."

},

// ... Human evals for colorBrandFit and mottoToxicity:

}

}

Alcanza y mide el acuerdo de expertos

Tu rúbrica sirve como instrucciones del modelo, por lo que es importante dedicar tiempo a definirla. Si un diseñador define "juguetón" como "lenguaje creativo", mientras que otro lo interpreta como "colores brillantes", tu LLM también estará en conflicto. Debes fortalecer tu rúbrica para eliminar estas ambigüedades antes de enviarla a tu evaluador. Conocido como fiabilidad entre etiquetadores o acuerdo entre evaluadores, un acuerdo alto garantiza que tu modelo de evaluador proporcione etiquetas confiables y de alta calidad.

Los desacuerdos humanos son indicadores útiles que te indican dónde tu rúbrica de puntuación necesita más trabajo. Itera en ella hasta que tus expertos estén de acuerdo en cuáles son los casos PASS y FAIL.

Tu evaluador no puede estar más alineado que las personas que lo crearon.

Acuerdo básico

Una forma de medir el acuerdo entre humanos, que también usamos para nuestra puntuación de acuerdo entre evaluadores humanos en nuestro evaluador básico, es un porcentaje de la frecuencia con la que nuestros expertos están de acuerdo.

// total = all test cases

// aligned = test cases where human1Eval.label === human2Eval.label

// (for example PASS and PASS)

const alignment = (aligned / total) * 100;

Acuerdo más allá de la suerte: Kappa

El acuerdo porcentual básico es sencillo, pero puede ser engañoso. Imagina un conjunto de datos que sea mitad PASS y mitad FAIL. Si dos expertos lanzan monedas, seguirán estando de acuerdo el 50% de las veces por suerte. Esto se llama piso de suerte.

Para calcular el acuerdo con precisión, usa métricas estadísticas que midan la confiabilidad más allá de la pura casualidad:

- Kappa de Cohen para dos etiquetadores.

Kappa de Fleiss para tres o más etiquetadores.

Prueba: Intenta obtener una puntuación de Kappa de al menos

0.61, que es el estándar para un acuerdo sustancial. Una puntuación de0significa que no es mejor que una adivinación aleatoria, y1.0es un acuerdo perfecto.Corrección: Si tu puntuación de Kappa es inferior a

0.61, la rúbrica es demasiado vaga. Agrupa las muestras en las que tus expertos no estén de acuerdo, revisa sus justificaciones, actualiza la rúbrica para cubrir esos casos extremos específicos y repite el proceso hasta que alcances0.61. Continúa con el siguiente paso solo cuando tus expertos estén alineados.

| Puntuación de Kappa | Acción |

|---|---|

Menos de 0.60: Deficiente |

Itera y descubre por qué los expertos ven las cosas de manera diferente. Es posible que la rúbrica sea demasiado vaga, así que defínela mejor. |

0.61–0.80: Buena |

Tu línea de base es confiable. Continúa con esta rúbrica. |

0.81-1.00 Casi perfecto |

Casi demasiado bueno para ser cierto. Verifica si la tarea es demasiado fácil o si los expertos la simplifican demasiado. |

Contrae tus etiquetas de expertos

Si usaste tres o más expertos humanos para etiquetar tus datos, contrae sus votos en una sola calificación mayoritaria para cada muestra. Esta lista se convierte en tu verdad fundamental.

Configura el evaluador

Al igual que lo hiciste con el evaluador básico, debes

configurar los parámetros del modelo

y escribir tu instrucción. Establece las instrucciones del sistema en una personalidad experta estricta y mantén la temperatura en 0 para obtener la máxima coherencia. En tu instrucción, proporciona la rúbrica exacta que usaron tus expertos humanos para calificar los datos. Agrega algunas de tus muestras etiquetadas por expertos como ejemplos limitados para mostrarle al evaluador exactamente cómo razonar.

Alinea y prueba el evaluador

Una vez que tus expertos humanos estén de acuerdo, es hora de ver si el evaluador de LLM está de acuerdo con ellos.

En nuestra configuración básica, analizamos la alineación sin procesar (exactitud). Pero ese número por sí solo puede ser engañoso. Imagina que el 90% de tus datos de prueba son un PASS. Un evaluador perezoso podría generar PASS cada vez y obtener una exactitud del 90% sin detectar un solo lema tóxico.

Define una clase positiva

Define tu clase positiva. Tu clase positiva, también llamada condición objetivo o evento de interés, es el resultado específico que intentas detectar, medir o marcar. Tu canalización de evaluación actúa como un guardián: su objetivo principal es detectar y bloquear los resultados incorrectos.

Si suponemos que ThemeBuilder suele ser bueno para generar lemas y paletas de marca, y que los lemas tóxicos también son un evento poco frecuente, tu clase positiva para todos los criterios de evaluación es un FAIL.

Teniendo en cuenta esto:

- Los falsos positivos son resultados correctos marcados incorrectamente como

FAIL. - Los falsos negativos son

FAILque se omitieron. - Los verdaderos positivos son

FAILidentificados correctamente.

Precisión y recuperación

Con tu clase positiva en mente, ahora puedes usar la precisión y la recuperación, que son mejores métricas que la alineación sin procesar:

- Precisión: Cuando el evaluador de LLM dice

FAIL, ¿con qué frecuencia es correcto? Por ejemplo, cuando el evaluador marcó un lema como tóxico, ¿con qué frecuencia fue correcto? - Recuperación: Cuando el humano dice

FAIL, ¿con qué frecuencia lo detectó el evaluador de LLM? Por ejemplo, de todos los resultados realmente tóxicos y de todos los lemas y paletas realmente fuera de la marca, ¿cuántos detectó el evaluador?

Comprende el costo de los errores y establece puntuaciones objetivo

Hazte la siguiente pregunta: ¿Qué error es peor para tu aplicación?

- Toxicidad: La toxicidad es un problema de seguridad. Queremos detectar todos los lemas tóxicos (minimizar los falsos negativos), incluso si eso significa que nuestro evaluador es demasiado estricto en ocasiones y marca uno seguro. Marcar un lema seguro (falso positivo) significa un pequeño retraso o una revisión humana. Por lo tanto, nuestro objetivo es obtener un 100% de recuperación. La precisión puede ser menor.

- Ajuste de marca: Necesitamos un equilibrio. Tanto la falta de diseños incorrectos como el rechazo de los buenos son igualmente costosos. Por lo tanto, queremos una precisión y una recuperación sólidas.

Puntuación F1

Cuando aumenta la recuperación, la precisión suele disminuir. En el caso de la toxicidad, eso no es un problema, ya que solo te interesa la recuperación.

En cuanto al ajuste de marca, la recuperación y la precisión son importantes. Para equilibrar esta importancia, puedes usar una métrica nueva: F1. Tu puntuación F1 combina la precisión y la recuperación en una sola métrica balanceada.

Alineación del alcance

Ejecuta tu evaluador en el conjunto de datos etiquetado por expertos y calcula las puntuaciones de exactitud, precisión, recuperación y F1 para cada uno de tus criterios. Evalúa si cumples con tus objetivos.

Si no es así, agrupa los casos de falla y lee las justificaciones del LLM. Actualiza las instrucciones del sistema y la rúbrica de puntuación del evaluador para cerrar las brechas hasta que las métricas alcancen tus objetivos.

Una vez que tu evaluador alcance tus objetivos, estará alineado.

Validación final

Ahora, validamos nuestro evaluador con los mismos pasos que abordamos en la configuración básica del evaluador, pero aplicamos tus nuevas métricas avanzadas:

- Prueba de esfuerzo con bootstrapping: Vuelve a muestrear tu conjunto de datos de forma aleatoria con reemplazo durante 10 iteraciones. Calcula la varianza de tus puntuaciones de precisión, recuperación y F1 en estas ejecuciones para demostrar matemáticamente que tus puntuaciones altas no son solo suerte.

- Prueba la coherencia propia: Ejecuta las mismas entradas en el evaluador varias veces para asegurarte de que sus veredictos sean 100% estables. Queremos cero varianza en todas las iteraciones.

- Hazle un examen final al evaluador: Prueba el evaluador en un conjunto de retención de 15 a 20 muestras nuevas etiquetadas por expertos que nunca haya visto antes. Calcula las puntuaciones de Kappa de Cohen, precisión, recuperación y F1 en este conjunto oculto. Si estas métricas permanecen cerca, se demuestra que tu evaluador no se ajustó en exceso a tus datos de alineación y está listo para generalizar al mundo real.

Vuelve a alinear el evaluador

Una vez que termines, ¡felicitaciones! Creaste una canalización de evaluación altamente confiable.

Recuerda volver a alinear tu evaluador cada vez que actualices el LLM subyacente en el que se basa o cuando el conjunto de atributos de tu aplicación cambie de forma fundamental.