Die Magie von LLMs verleitet uns vielleicht dazu, Tests zu überspringen. Evals sind aber der Schlüssel zu einer sicheren Bereitstellung.

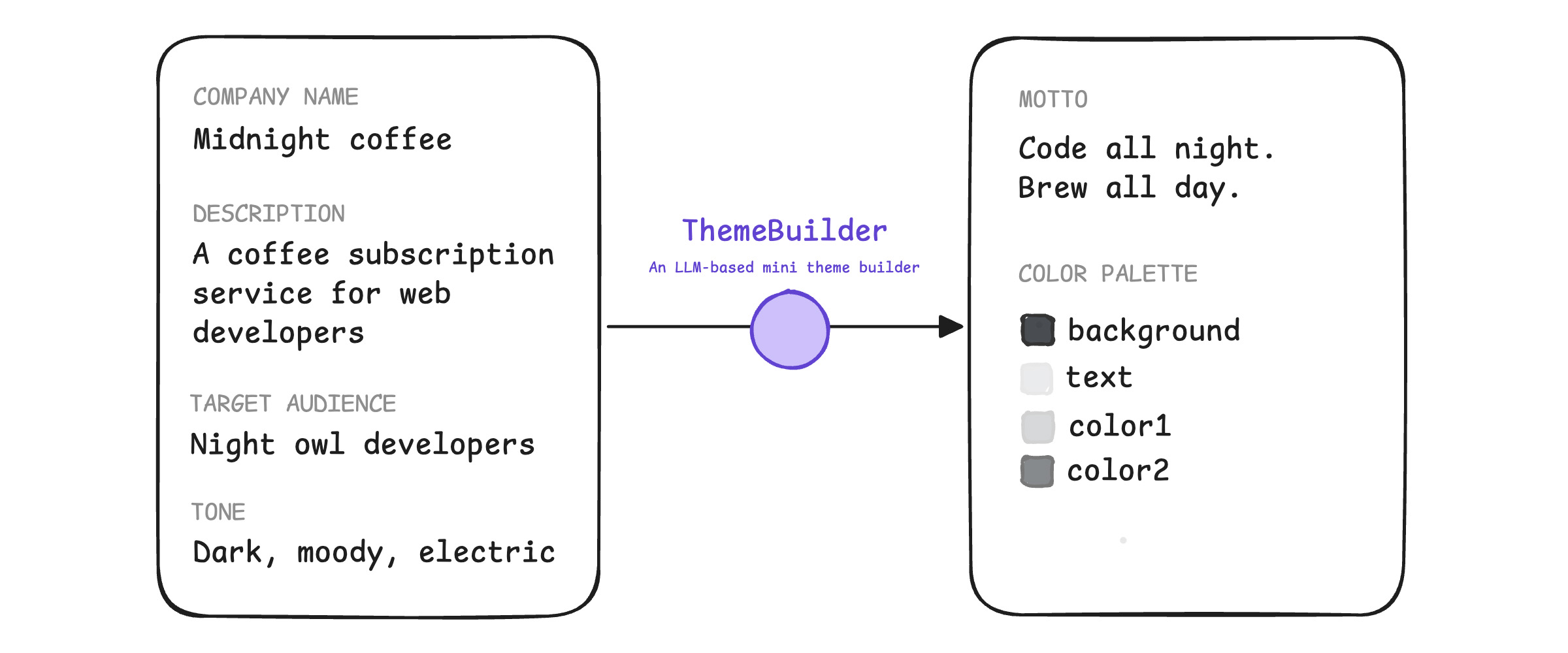

Stellen Sie sich vor, Sie entwickeln einen webbasierten Theme-Builder. Es ist ein unterhaltsames Tool: In einer Webanwendung gibt ein Nutzer einen Namen des Unternehmens und eine Beschreibung, eine Zielgruppe sowie einen Ton und eine Stimmung ein. Das Frontend sendet diese Informationen an Ihren Server. Ihr Server verwendet ein Large Language Model (LLM), um ein kreatives Motto zu generieren, das dem erwarteten Ton und der Stimmung entspricht, sowie eine barrierefreie Farbpalette, die auf die Marke abgestimmt ist. Diese Daten werden als kleines JSON-Objekt zurückgegeben.

Wir nennen diese Anwendung ThemeBuilder.

Sie wählen ein Foundation-LLM aus und iterieren den Prompt. Ihr interner Designer mag die Farbpaletten und die Mottos klingen eingängig.

Jetzt haben Sie folgende Fragen:

- Ist die Anwendung bereit für die Produktion? Sie wissen nicht, ob die Ausgabequalität Ihrer Anwendung konsistent genug ist. Einige interne Tester melden fehlerhafte Paletten oder Mottos, die nicht zur Marke passen. Wenn Sie einen Fall beheben, treten zwei weitere Fehler auf.

- Kann ich Modelle ändern? Möglicherweise möchten Sie auf die neueste Version desselben LLM aktualisieren, um die Latenz zu verringern, oder von einem verwalteten Dienst zu einem selbst gehosteten Modell wechseln, um Kosten zu senken. Sie wissen nicht, ob sich dadurch die Ausgabe Ihrer Anwendung verbessert oder verschlechtert. Außerdem haben Sie keine Möglichkeit, auf Regressionen zu testen.

- Ist die Bereitstellung sicher? Jemand hat einmal eine toxische Ausgabe gemeldet, aber Sie können sie nicht reproduzieren. Ist es ein Zufall oder sollten Sie die Bereitstellung blockieren?

Ihr Team stoppt die Bereitstellung, weil die Ausgabequalität des LLM zu stark variiert. Ohne Tests ist es schwierig, das Vertrauen aufzubauen, das für die Bereitstellung erforderlich ist.

Warum raten statt testen?

Wenn Sie zum ersten Mal mit KI arbeiten, ist es verlockend, sich einige Ausgaben anzusehen, zu entscheiden, dass sie in Ordnung sind, und weiterzumachen. Warum sollten Sie sich auf Intuition statt auf Messungen und Daten verlassen?

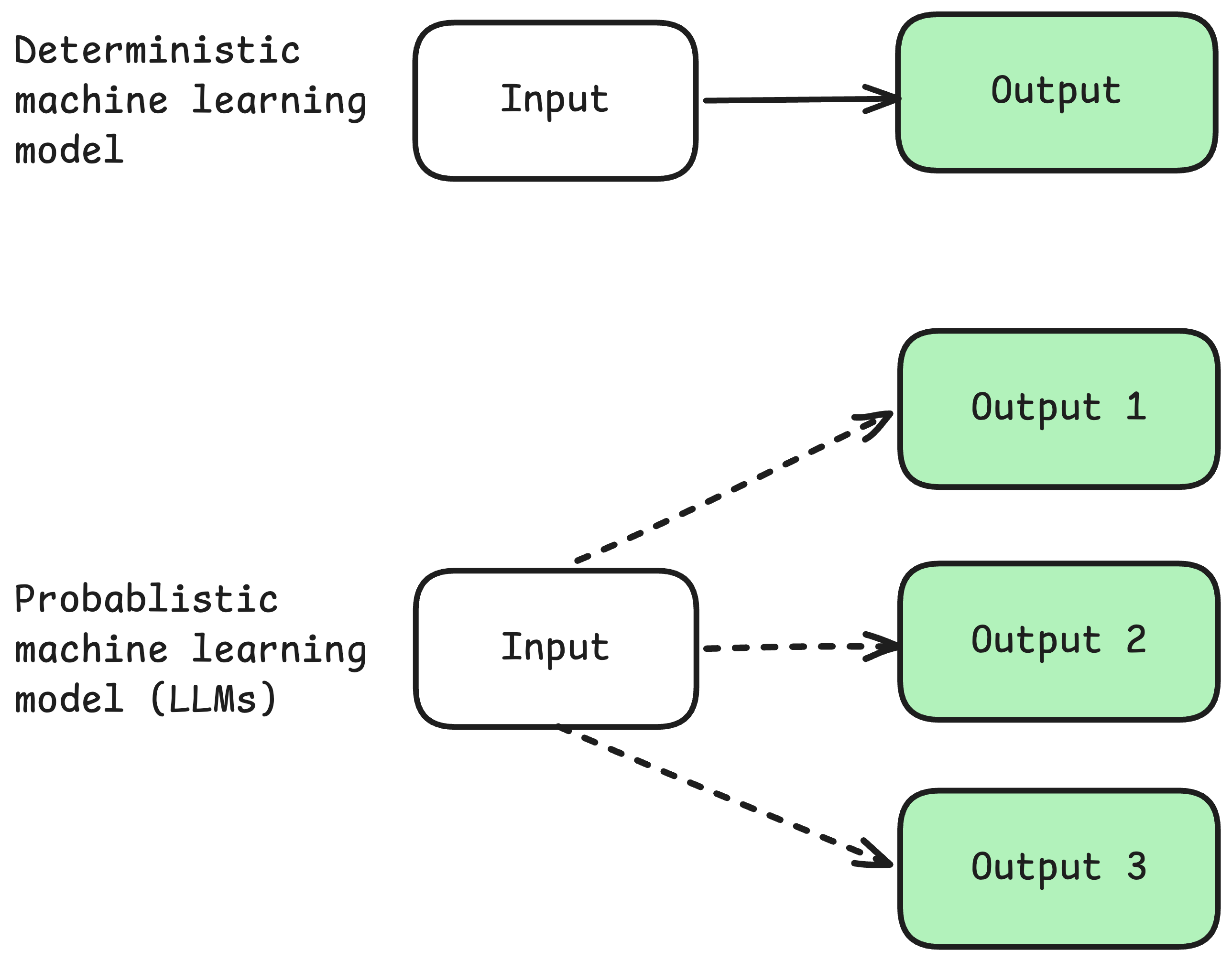

Das liegt wahrscheinlich daran, dass LLMs probabilistisch statt deterministischsind. Das bedeutet, dass ThemeBuilder auch dann ein anderes Motto und eine andere Farbpalette ausgeben kann, wenn Sie denselben Firmennamen, dieselbe Beschreibung, Zielgruppe und denselben Ton angeben.

Es gibt keine einzige richtige Antwort darauf, was ein eingängiges Motto oder eine zur Marke passende Farbpalette ist.

Die Kreativität von LLMs ist großartig. Der Nichtdeterminismus widerspricht jedoch der Idee des Engineerings. Daher kommen Sie möglicherweise zu dem Schluss, dass LLM-basierte Anwendungen wahrscheinlich nicht testbar sind.

Evals zur Rettung

In der LLM-Welt gelten weiterhin die Best Practices für die Entwicklung. Wir können und sollten unsere LLM-basierten Anwendungen testen. Wir brauchen nur andere Techniken. Diese Techniken werden als Evaluierungen oder kurz Evals bezeichnet. Evals umfassen neue Workflows, aber Ihre vorhandenen Testkenntnisse lassen sich direkt auf die Erstellung großartiger Evals übertragen.

Evals sind Tests für Ihre KI-Funktionen. Diese Tests helfen Ihnen, einen wichtigen Feedback-Loop zu erstellen: Wenn Sie eine robuste Evals-Pipeline erstellen, funktionieren Ihre LLM-basierten Funktionen gut für Ihre Nutzer. Dann kann Ihr Team Ihre Funktionen mit Zuversicht bereitstellen.

Wenn Sie mit LLMs arbeiten, ist das Implementieren robuster Evals eine der besten Möglichkeiten, Ihre Zeit zu nutzen.

Weitere Informationen zu Evals