جادوی LLM ممکن است ما را وسوسه کند که از آزمایش صرف نظر کنیم، اما ارزیابیها کلید شما برای ارسال با اطمینان هستند.

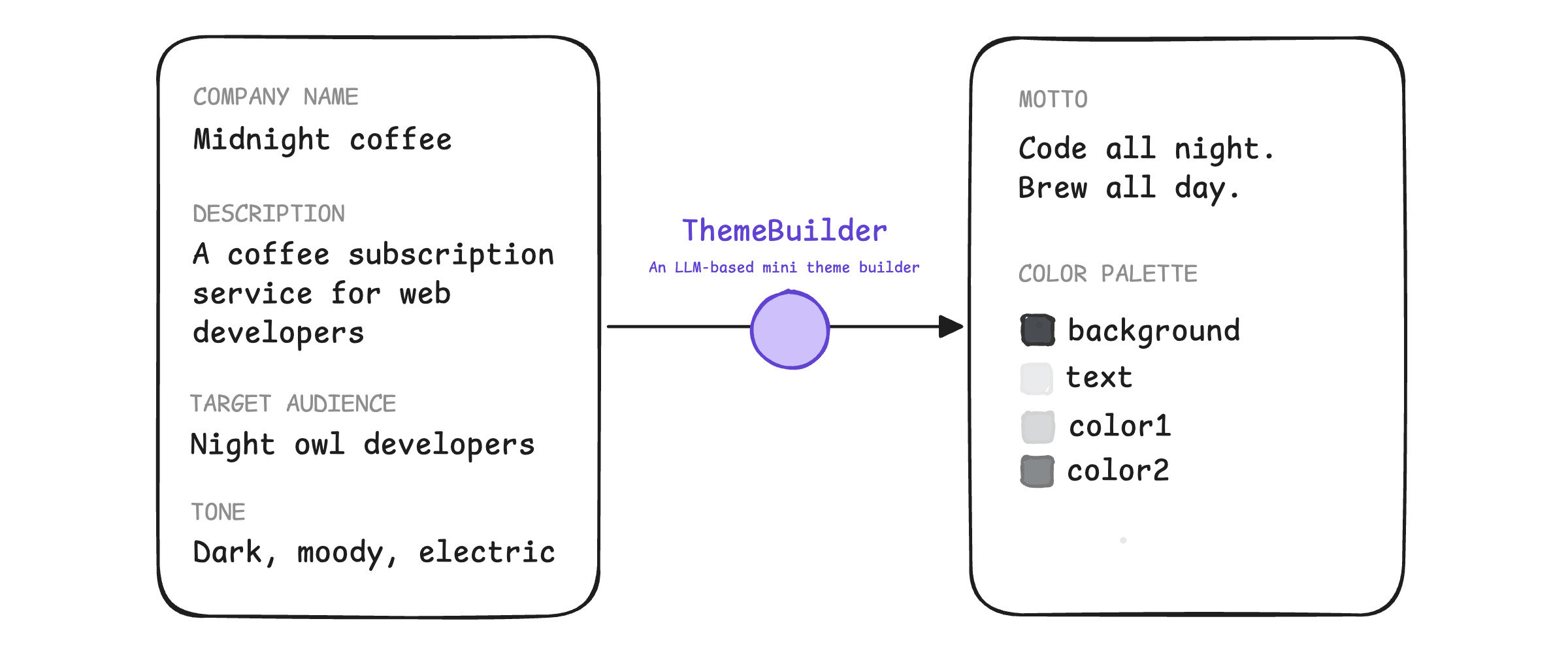

تصور کنید که در حال نمونهسازی اولیه یک سازنده تم مبتنی بر وب هستید. این یک ابزار سرگرمکننده است: در یک برنامه وب، کاربر نام و توضیحات شرکت، مخاطب هدف و لحن و حال و هوای آن را وارد میکند. بخش فرانتاند این موارد را به سرور شما ارسال میکند. سرور شما از یک مدل زبان بزرگ (LLM) برای تولید یک شعار خلاقانه که با لحن و حال و هوای مورد انتظار مطابقت دارد و یک پالت رنگی قابل دسترس و همسو با برند، استفاده میکند. سرور این دادهها را به عنوان یک شیء کوچک JSON برمیگرداند.

ما این برنامه را ThemeBuilder مینامیم.

شما یک LLM پایه انتخاب میکنید و روی آن کار میکنید. طراح داخلی شما پالتهای رنگی را دوست دارد و شعارها جذاب به نظر میرسند.

حالا، سوالات زیر برای شما پیش میآید:

- آیا برای تولید آماده است؟ شما نمیدانید که آیا کیفیت خروجی برنامهتان به اندازه کافی ثابت است یا خیر. برخی از آزمایشکنندگان داخلی، پالتهای معیوب یا شعارهای نامتعارف را گزارش میدهند. وقتی یک مورد را برطرف میکنید، دو اشکال دیگر ظاهر میشوند.

- آیا میتوانم مدلها را تغییر دهم؟ شاید بخواهید برای صرفهجویی در تأخیر، مدل LLM خود را به آخرین نسخه ارتقا دهید، یا برای کاهش هزینهها، از یک سرویس مدیریتشده به یک مدل خود-میزبان تغییر دهید. شما نمیدانید که آیا این کار خروجی برنامه شما را بهبود میبخشد یا بدتر میکند، شما هیچ راهی برای آزمایش رگرسیون ندارید.

- آیا ارسال آن ایمن است؟ یک نفر یک بار خروجی سمی را گزارش کرد، اما شما نمیتوانید آن را تکرار کنید. آیا این یک اتفاق تصادفی است یا باید جلوی پرتاب را بگیرید؟

تیم شما به دلیل تغییرات زیاد کیفیت خروجی LLM، عرضه را متوقف میکند. ایجاد اعتماد برای عرضه بدون آزمایش دشوار است.

چرا به جای آزمایش، حدس بزنیم؟

وقتی برای اولین بار با هوش مصنوعی چیزی میسازید، وسوسه میشوید که به چند خروجی نگاه کنید، تصمیم بگیرید که خوب به نظر میرسند و ادامه دهید. چرا باید به جای اندازهگیریها و دادهها، به شهود تکیه کنید؟

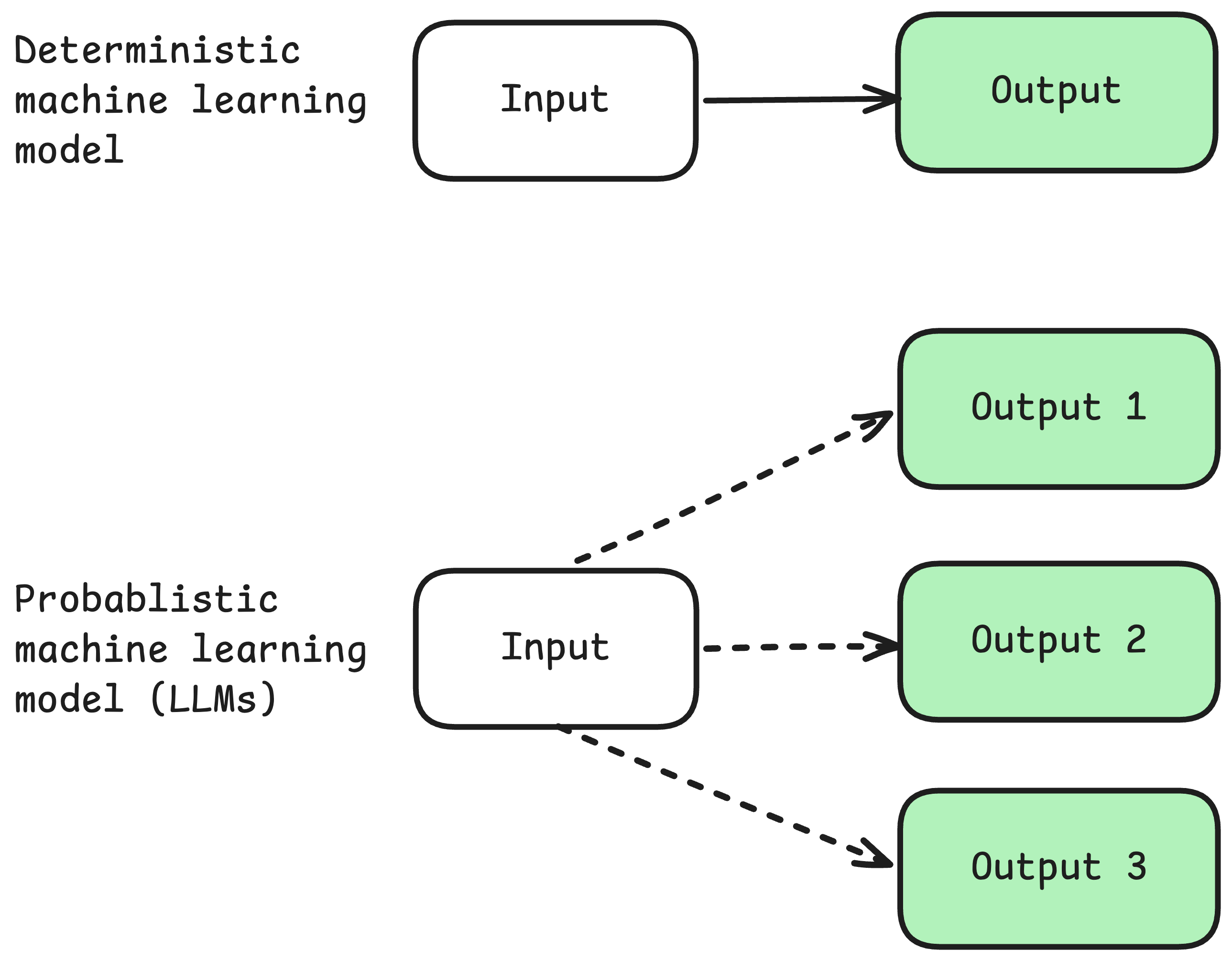

احتمالاً این کار را انجام میدهید زیرا LLM ها به جای قطعی ، احتمالی هستند. این بدان معناست که حتی وقتی نام، توضیحات، مخاطبان و لحن شرکت یکسانی را ارائه میدهید، ThemeBuilder ممکن است شعار و پالت رنگی متفاوتی را ارائه دهد.

هیچ پاسخ صحیح و واحدی برای اینکه یک شعار جذاب یا یک پالت رنگی متناسب با برند چیست، وجود ندارد.

خلاقیت در LLM عالی است. اما عدم قطعیت با ایده مهندسی در تضاد است. بنابراین ممکن است نتیجه بگیرید که برنامههای مبتنی بر LLM احتمالاً غیرقابل آزمایش هستند.

ارزیابیها برای نجات

در دنیای LLM، بهترین شیوههای توسعه همچنان معتبر هستند. ما میتوانیم و باید برنامههای مبتنی بر LLM خود را آزمایش کنیم. ما فقط به تکنیکهای متفاوتی نیاز داریم. این تکنیکها ارزیابی یا به اختصار eval نامیده میشوند. evalها شامل گردشهای کاری جدید هستند، اما تخصص تست فعلی شما مستقیماً به ساخت evalهای عالی منتقل میشود.

ارزیابیها، آزمایشهایی برای ویژگیهای هوش مصنوعی شما هستند. این آزمایشها به شما کمک میکنند تا یک حلقه بازخورد کلیدی ایجاد کنید: اگر یک خط لوله ارزیابی قوی ایجاد کنید، ویژگیهای مبتنی بر LLM شما برای کاربرانتان به خوبی کار خواهند کرد. سپس، تیم شما میتواند ویژگیهای شما را با اطمینان ارائه دهد.

اگر با LLM ها در حال ساخت هستید، یادگیری پیادهسازی ارزیابیهای قوی یکی از بهترین کاربردهای وقت شماست.

حالا، در مورد ارزیابیها یاد بگیرید!