Magia LLM może kusić, aby pominąć testowanie, ale oceny są kluczem do pewnego wdrażania.

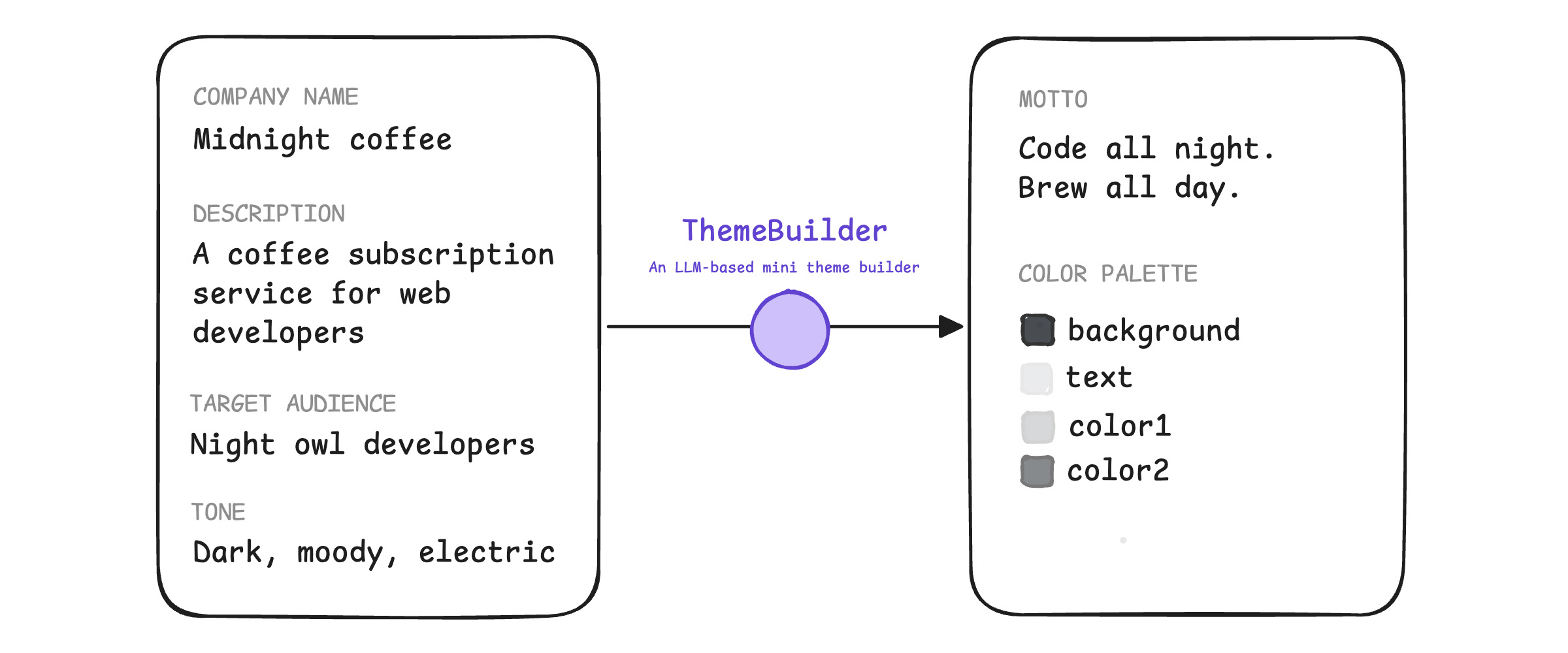

Wyobraź sobie, że tworzysz prototyp narzędzia do tworzenia motywów internetowych. To ciekawe narzędzie: w aplikacji internetowej użytkownik wpisuje nazwę i opis firmy, grupę docelową oraz ton i nastrój. Frontend wysyła te informacje na Twój serwer. Twój serwer używa dużego modelu językowego (LLM) do generowania kreatywnego motta, które pasuje do oczekiwanego tonu i nastroju, oraz dostępnej palety kolorów dopasowanej do marki. Zwraca te dane w postaci małego obiektu JSON.

Nazwiemy tę aplikację ThemeBuilder.

Wybierasz podstawowy LLM i iteracyjnie dopracowujesz prompt. Twojemu projektantowi wewnętrznemu podobają się palety kolorów, a motto brzmi chwytliwie.

Teraz masz te pytania:

- Czy jest gotowa do wdrożenia w środowisku produkcyjnym? Nie wiesz, czy jakość danych wyjściowych aplikacji jest wystarczająco spójna. Niektórzy testerzy wewnętrzni zgłaszają nieprawidłowe palety kolorów lub hasła niezgodne z marką. Gdy rozwiążesz jedną sprawę, pojawią się 2 kolejne błędy.

- Czy mogę zmienić modele? Aby zmniejszyć opóźnienie, możesz przejść na najnowszą wersję tego samego LLM-a lub zmienić usługę zarządzaną na model hostowany samodzielnie, aby obniżyć koszty. Nie wiesz, czy to poprawi, czy pogorszy wyniki aplikacji, i nie masz możliwości przetestowania regresji.

- Czy wysyłka jest bezpieczna? Ktoś zgłosił toksyczne dane wyjściowe, ale nie możesz ich odtworzyć. Czy to przypadek, czy należy zablokować wprowadzenie produktu na rynek?

Twój zespół wstrzymuje wprowadzenie na rynek, ponieważ jakość danych wyjściowych LLM jest zbyt zróżnicowana. Bez testów trudno jest zyskać pewność, że można wprowadzić zmiany.

Dlaczego zgadywać, zamiast testować?

Gdy po raz pierwszy tworzysz coś z użyciem AI, możesz mieć pokusę, aby przejrzeć kilka wyników, uznać je za zadowalające i przejść dalej. Dlaczego możesz polegać na intuicji zamiast na pomiarach i danych?

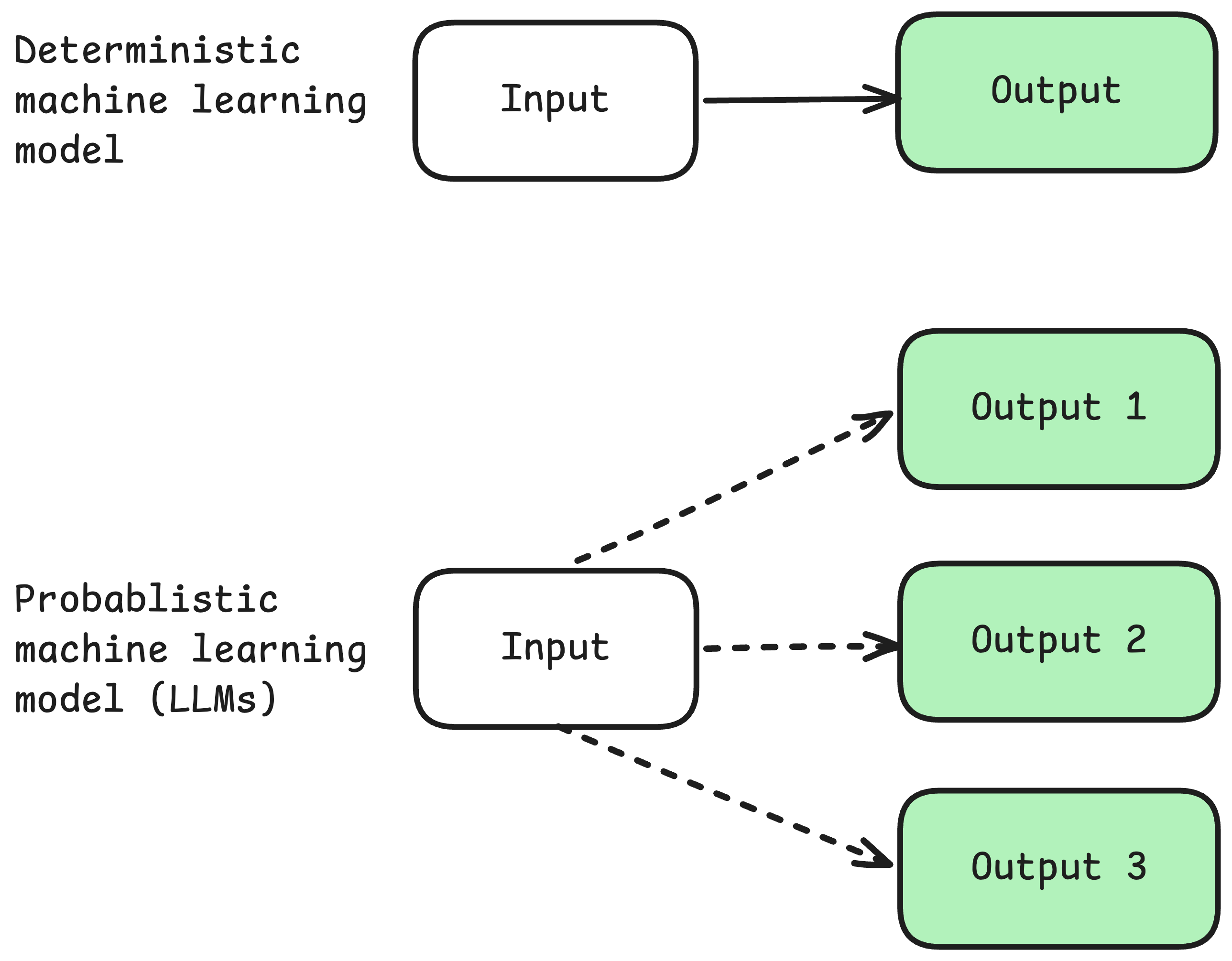

Prawdopodobnie robisz to dlatego, że duże modele językowe są probabilistyczne, a nie deterministyczne. Oznacza to, że nawet jeśli podasz tę samą nazwę firmy, opis, odbiorców i ton, narzędzie ThemeBuilder może wygenerować inne motto i paletę kolorów.

Nie ma jednej prawidłowej odpowiedzi na pytanie, co to jest chwytliwe motto lub paleta kolorów zgodna z marką.

Kreatywność LLM jest świetna. Jednak niedeterminizm wydaje się sprzeczny z ideą inżynierii. Możesz więc dojść do wniosku, że aplikacje oparte na LLM są prawdopodobnie nietestowalne.

Evals na ratunek

W świecie LLM sprawdzone metody programowania pozostają aktualne. Możemy i powinniśmy testować nasze aplikacje oparte na LLM. Potrzebujemy tylko innych technik. Te techniki nazywane są ocenami. Ewaluacje obejmują nowe procesy, ale Twoje dotychczasowe doświadczenie w testowaniu bezpośrednio przekłada się na tworzenie świetnych ewaluacji.

Testy to testy funkcji AI. Te testy pomagają stworzyć kluczową pętlę informacji zwrotnej: jeśli zbudujesz solidny potok ocen, funkcje oparte na LLM będą dobrze działać dla użytkowników. Dzięki temu Twój zespół będzie mógł z pewnością wdrażać funkcje.

Jeśli tworzysz aplikacje z użyciem dużych modeli językowych, nauka wdrażania solidnych ocen jest jednym z najlepszych sposobów wykorzystania czasu.

Teraz dowiedz się więcej o ocenach.