ความมหัศจรรย์ของ LLM อาจทำให้เราอยากข้ามการทดสอบ แต่การประเมินคือกุญแจสำคัญที่จะช่วยให้คุณมั่นใจในการเผยแพร่

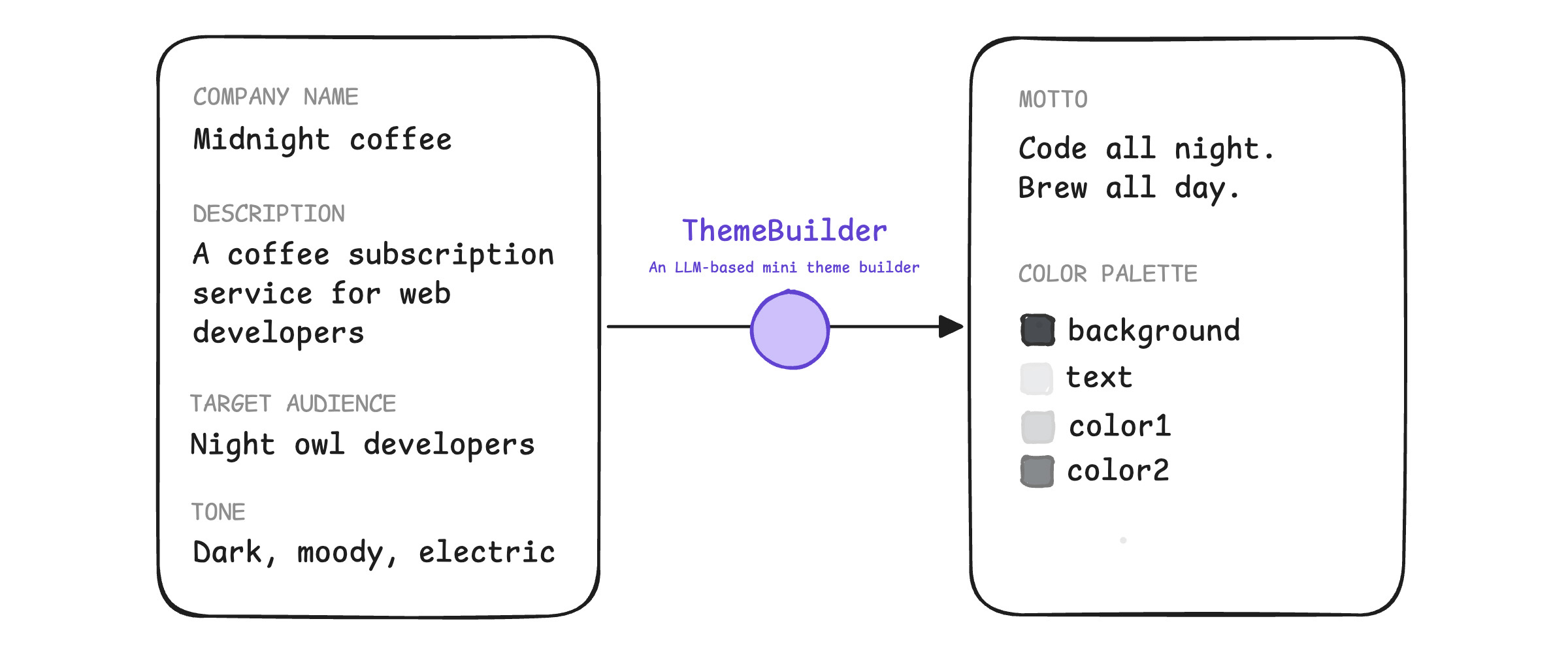

ลองจินตนาการว่าคุณกำลังสร้างต้นแบบเครื่องมือสร้างธีมบนเว็บ เครื่องมือนี้ใช้งานสนุก โดยในเว็บแอปพลิเคชัน ผู้ใช้จะป้อนชื่อและคำอธิบายบริษัท กลุ่มเป้าหมาย รวมถึงน้ำเสียงและอารมณ์ ส่วนหน้าจะส่งข้อมูลนี้ไปยังเซิร์ฟเวอร์ของคุณ เซิร์ฟเวอร์ของคุณใช้โมเดลภาษาขนาดใหญ่ (LLM) เพื่อสร้างคำขวัญครีเอทีฟโฆษณาที่ ตรงกับโทนและอารมณ์ที่คาดไว้ รวมถึงชุดสีที่เข้าถึงได้ซึ่งสอดคล้อง กับแบรนด์ โดยจะแสดงข้อมูลนี้เป็นออบเจ็กต์ JSON ขนาดเล็ก

เราจะเรียกแอปพลิเคชันนี้ว่า ThemeBuilder

คุณเลือก LLM พื้นฐานและทำซ้ำในพรอมต์ นักออกแบบภายในของคุณ ชอบชุดสีและคำขวัญที่ฟังดูติดหู

ตอนนี้คุณมีคำถามต่อไปนี้

- พร้อมใช้งานจริงแล้วหรือยัง คุณไม่ทราบว่าคุณภาพเอาต์พุตของแอปพลิเคชัน มีความสม่ำเสมอเพียงพอหรือไม่ ผู้ทดสอบภายในบางรายรายงานว่าจานสี ไม่ถูกต้องหรือคำขวัญไม่ตรงกับแบรนด์ เมื่อแก้ไขเคสหนึ่งแล้ว ข้อบกพร่องอีก 2 รายการจะปรากฏขึ้น

- ฉันเปลี่ยนโมเดลได้ไหม คุณอาจต้องการอัปเกรดเป็น LLM เวอร์ชันล่าสุดของ LLM เดียวกันเพื่อลดเวลาในการตอบสนอง หรือเปลี่ยนจากบริการที่มีการจัดการเป็นโมเดลที่โฮสต์ด้วยตนเองเพื่อลดต้นทุน คุณไม่ทราบว่าการดำเนินการดังกล่าวจะปรับปรุงหรือทำให้เอาต์พุตของแอปพลิเคชันแย่ลง และไม่มีวิธีทดสอบการถดถอย

- การจัดส่งปลอดภัยไหม มีผู้รายงานว่าได้รับเอาต์พุตที่เป็นพิษ 1 ครั้ง แต่คุณไม่สามารถ สร้างเอาต์พุตดังกล่าวซ้ำได้ เป็นความผิดพลาดหรือคุณควรบล็อกการเปิดตัว

ทีมของคุณหยุดการเปิดตัวเนื่องจากคุณภาพเอาต์พุตของ LLM แตกต่างกันมากเกินไป การสร้างความมั่นใจในการจัดส่งโดยไม่มีการทดสอบเป็นเรื่องยาก

ทำไมต้องคาดเดาแทนที่จะทดสอบ

เมื่อสร้างด้วย AI เป็นครั้งแรก คุณอาจอยากดูผลลัพธ์เพียงไม่กี่รายการ แล้วตัดสินใจว่าผลลัพธ์เหล่านั้น ดูใช้ได้และดำเนินการต่อ เหตุใดคุณจึงอาจพึ่งสัญชาตญาณแทนการวัดผลและข้อมูล

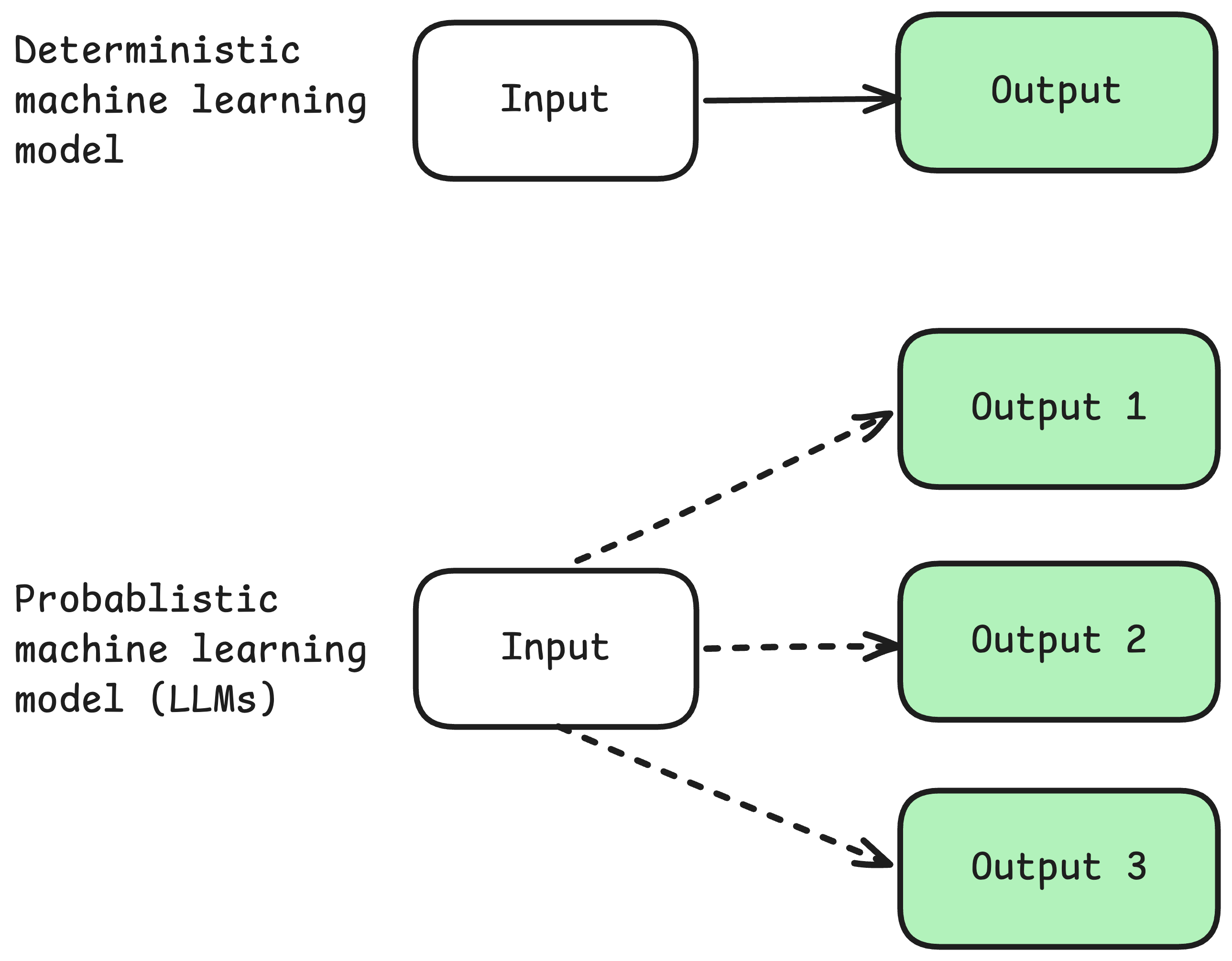

คุณอาจทำเช่นนี้เนื่องจาก LLM เป็นแบบ ดีเทอร์มินิสติกแทนที่จะเป็นแบบสุ่ม ซึ่งหมายความว่า แม้ว่าคุณจะระบุชื่อบริษัท คำอธิบาย กลุ่มเป้าหมาย และ โทนเดียวกัน ThemeBuilder ก็อาจแสดงสโลแกนและชุดสีที่แตกต่างกัน

ไม่มีคำตอบที่ถูกต้องเพียงหนึ่งเดียวสำหรับคำขวัญที่โดนใจหรือ ชุดสีที่สอดคล้องกับแบรนด์

ความคิดสร้างสรรค์ของ LLM นั้นยอดเยี่ยม แต่ความไม่แน่นอนนั้นดูขัดแย้งกับแนวคิดเรื่อง วิศวกรรม คุณจึงอาจสรุปได้ว่าแอปพลิเคชันที่อิงตาม LLM อาจ ทดสอบไม่ได้

การประเมินช่วยคุณได้

ในโลกของ LLM แนวทางปฏิบัติแนะนำในการพัฒนาจะยังคงใช้ได้ เราสามารถและ ควรทดสอบแอปพลิเคชันที่ใช้ LLM เราแค่ต้องใช้เทคนิคที่แตกต่างกัน เราเรียกเทคนิคเหล่านี้ว่าการประเมิน หรือเรียกสั้นๆ ว่า Eval Evals เกี่ยวข้องกับเวิร์กโฟลว์ใหม่ แต่ความเชี่ยวชาญด้านการทดสอบที่มีอยู่จะนำไปใช้ในการสร้าง Evals ที่ยอดเยี่ยมได้โดยตรง

Evals คือการทดสอบฟีเจอร์ AI การทดสอบเหล่านี้ช่วยให้คุณสร้างการเก็บฟีดแบ็กมาแก้ไขที่สำคัญได้ กล่าวคือ หากสร้างไปป์ไลน์การประเมินที่แข็งแกร่ง ฟีเจอร์ที่ใช้ LLM จะทำงานได้ดีสำหรับผู้ใช้ จากนั้นทีมของคุณจะสามารถเปิดตัวฟีเจอร์ได้อย่างมั่นใจ

หากคุณกำลังสร้างด้วย LLM การเรียนรู้วิธีใช้การประเมินที่มีประสิทธิภาพคือหนึ่งในวิธีใช้เวลาของคุณให้เกิดประโยชน์สูงสุด

ตอนนี้มาดูเรื่องการประเมินกัน