Phép màu của LLM (mô hình ngôn ngữ lớn) có thể khiến chúng ta bỏ qua việc kiểm thử, nhưng quy trình đánh giá là chìa khoá để bạn tự tin phát hành.

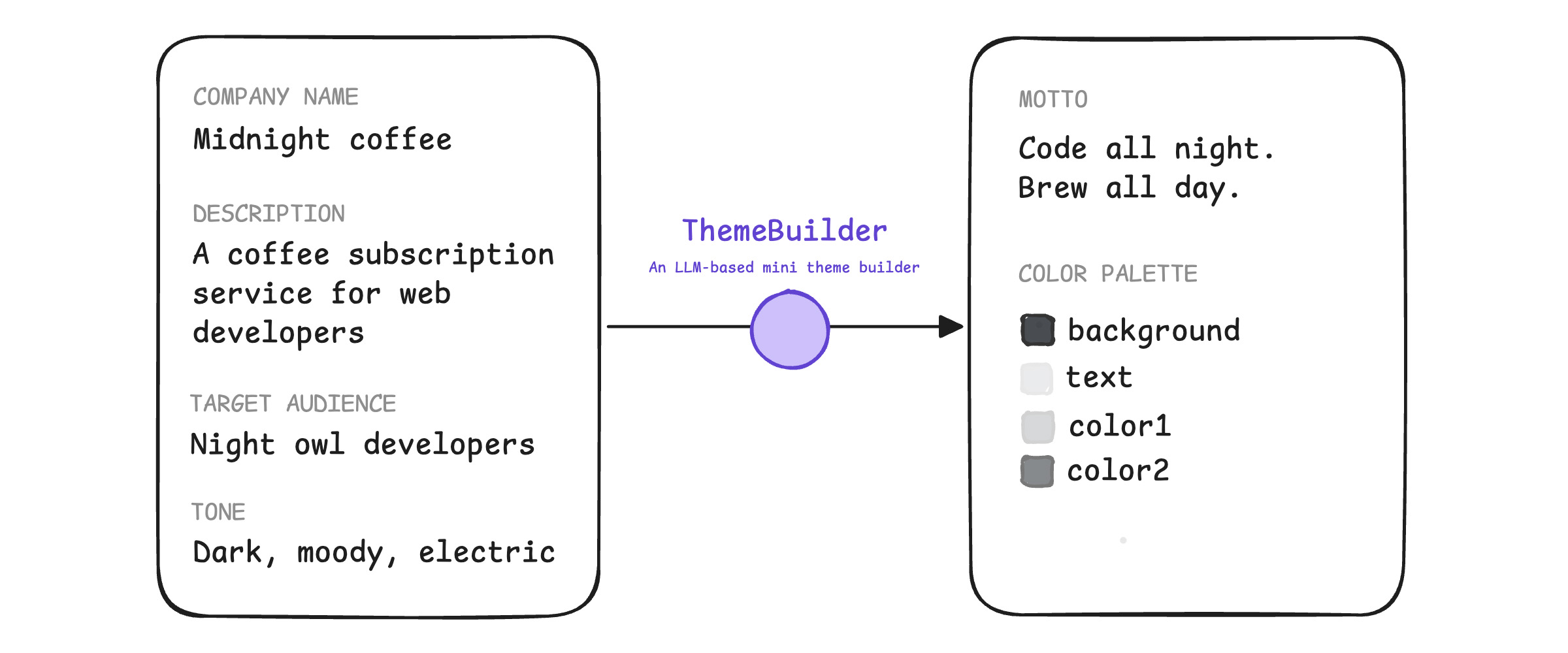

Hãy tưởng tượng bạn đang tạo nguyên mẫu cho một trình tạo giao diện dựa trên web. Đây là một công cụ thú vị: trong một ứng dụng web, người dùng nhập tên và nội dung mô tả công ty, đối tượng mục tiêu, cũng như giọng điệu và tâm trạng. Giao diện người dùng gửi thông tin này đến máy chủ của bạn. Máy chủ của bạn sử dụng một mô hình ngôn ngữ lớn (LLM) để tạo ra một phương châm sáng tạo phù hợp với giọng điệu và tâm trạng dự kiến, cũng như một bảng màu dễ tiếp cận phù hợp với thương hiệu. Công cụ này trả về dữ liệu này dưới dạng một đối tượng JSON nhỏ.

Chúng ta sẽ gọi ứng dụng này là ThemeBuilder.

Bạn chọn một LLM nền tảng và lặp lại lời nhắc. Nhà thiết kế nội bộ của bạn thích bảng màu và các phương châm nghe có vẻ hấp dẫn.

Bây giờ, bạn có những câu hỏi sau:

- Ứng dụng đã sẵn sàng cho quá trình sản xuất chưa? Bạn không biết liệu chất lượng đầu ra của ứng dụng có đủ nhất quán hay không. Một số người kiểm thử nội bộ báo cáo rằng bảng màu bị hỏng hoặc phương châm không phù hợp với thương hiệu. Khi bạn khắc phục một trường hợp, hai lỗi khác sẽ xuất hiện.

- Tôi có thể thay đổi mô hình không? Bạn có thể muốn nâng cấp lên phiên bản mới nhất của cùng một LLM để tiết kiệm độ trễ hoặc chuyển từ dịch vụ được quản lý sang mô hình tự lưu trữ để giảm chi phí. Bạn không biết liệu việc đó sẽ cải thiện hay làm giảm chất lượng đầu ra của ứng dụng, bạn không có cách nào để kiểm thử hồi quy.

- Có an toàn để phát hành không? Ai đó đã báo cáo một đầu ra độc hại một lần, nhưng bạn không thể tái tạo đầu ra đó. Đây là một sự cố bất ngờ hay bạn nên chặn việc phát hành?

Nhóm của bạn dừng việc phát hành vì chất lượng đầu ra của LLM thay đổi quá nhiều. Thật khó để tự tin phát hành mà không có quy trình kiểm thử.

Tại sao lại đoán thay vì kiểm thử?

Khi mới xây dựng bằng AI, bạn sẽ dễ bị cám dỗ khi nhìn vào một vài đầu ra, quyết định rằng chúng trông ổn và tiếp tục. Tại sao bạn có thể dựa vào trực giác thay vì các phép đo và dữ liệu?

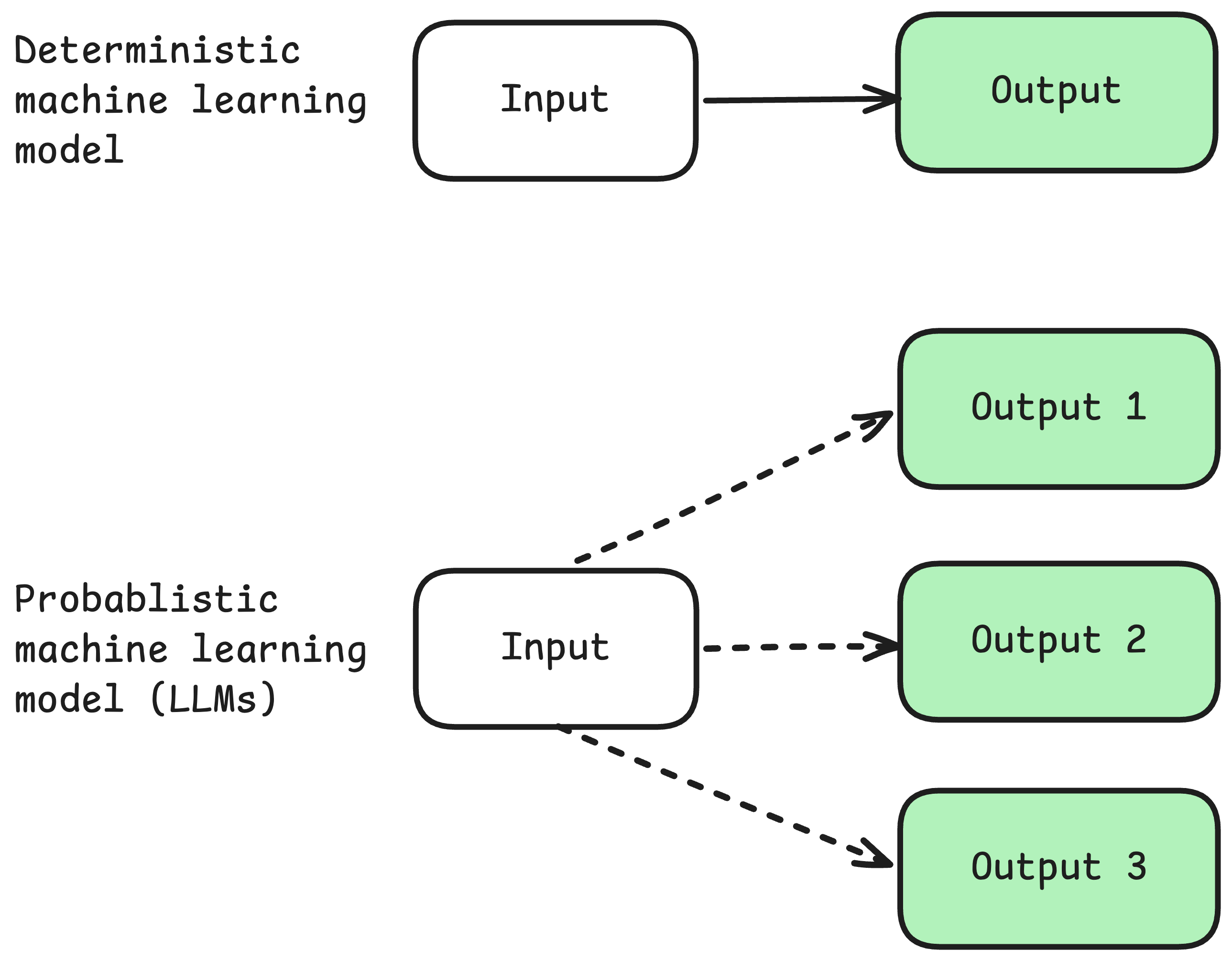

Bạn có thể làm điều này vì LLM là xác suất thay vì xác định. Điều này có nghĩa là ngay cả khi bạn cung cấp cùng một tên công ty, nội dung mô tả, đối tượng và giọng điệu, ThemeBuilder có thể đưa ra một phương châm và bảng màu khác.

Không có câu trả lời đúng duy nhất cho phương châm hấp dẫn hoặc bảng màu phù hợp với thương hiệu.

Tính sáng tạo của LLM rất tuyệt vời. Nhưng tính không xác định lại mâu thuẫn với ý tưởng về kỹ thuật. Vì vậy, bạn có thể kết luận rằng các ứng dụng dựa trên LLM có lẽ không thể kiểm thử được.

Quy trình đánh giá góp sức

Trong thế giới LLM, các phương pháp hay nhất về phát triển vẫn có giá trị. Chúng ta có thể và nên kiểm thử các ứng dụng dựa trên LLM. Chúng ta chỉ cần các kỹ thuật khác. Các kỹ thuật này được gọi là quy trình đánh giá hay viết tắt là quy trình đánh giá. Quy trình đánh giá bao gồm các quy trình làm việc mới, nhưng kinh nghiệm kiểm thử hiện có của bạn sẽ được chuyển trực tiếp sang việc xây dựng các quy trình đánh giá tuyệt vời.

Quy trình đánh giá là các quy trình kiểm thử cho các tính năng AI. Các quy trình kiểm thử này giúp bạn tạo vòng hồi tiếp chính: nếu bạn xây dựng một quy trình đánh giá mạnh mẽ, các tính năng dựa trên LLM (mô hình ngôn ngữ lớn) sẽ hoạt động tốt cho người dùng. Sau đó, nhóm của bạn có thể tự tin phát hành các tính năng.

Nếu bạn đang xây dựng bằng LLM (mô hình ngôn ngữ lớn), thì việc học cách triển khai các quy trình đánh giá mạnh mẽ là một trong những cách sử dụng thời gian hiệu quả nhất.

Bây giờ, hãy tìm hiểu về quy trình đánh giá!