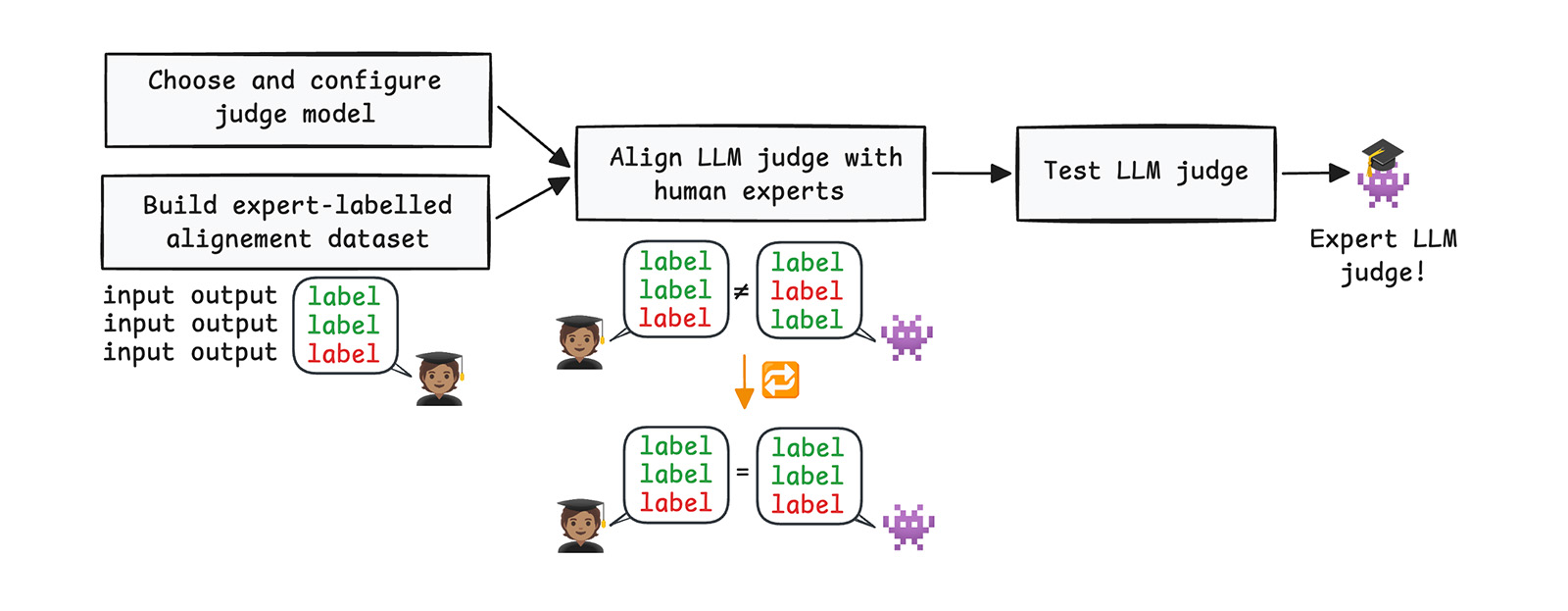

Richter für die Produktion vorbereiten

Der einfachen Judge, den Sie in Einfaches Judge-Modell einrichten, Teil 1 und Teil 2 erstellt haben, basiert auf selbst gelabelten Daten. So können Sie eine gute Test-Baseline erstellen. Um jedoch eine produktionsreife Qualität zu erreichen, benötigen Sie ein Modell, das wie ein Fachmann denkt, und robuste statistische Messwerte, um ihm in großem Maßstab vertrauen zu können. Darum geht es hier.

Dataset für die Ausrichtung mit Experten erstellen

Die Verwendung von menschlichen Experten zum Labeln Ihres Abstimmungs-Datasets ist entscheidend für die Entwicklung eines zuverlässigen LLM-Richters. Qualität hat Vorrang vor Quantität. 30 hochwertige Labels von einem Fachexperten sind unendlich viel besser als 300 Labels von Nicht-Experten.

Labeler finden

Setzen Sie interne Designer und Markenexperten ein, um die Marke zu optimieren. Bei der Toxizität können Sie sich auf dieselben Labeler verlassen oder Labels von Ihrem Team auf Grundlage eines zentralen Bewertungsschemas crowdsourcen, um sicherzustellen, dass die Labeler dieselben Bewertungskriterien verwenden.

Wie viele Expertenkennzeichner?

- Ein Experte: Das ist schnell und für den Anfang in Ordnung, aber der Richter übernimmt die Vorurteile der Person.

- Zwei Experten: Das kann ein guter Kompromiss sein. Sie können keine Unentschieden auflösen, aber Sie können Unstimmigkeiten erkennen.

- Drei und mehr: Das ist der Goldstandard. Bei einer ungeraden Anzahl von Ratern haben Sie bei binären

PASS- undFAIL-Bewertungen wie in unserem Beispiel automatisch einen Tiebreaker, da Sie sich an der Mehrheit orientieren können.

Nehmen wir an, Sie haben drei interne Markendesigner, die sich bereit erklären, unsere Experten-Labeler zu sein.

Experten erstellen ein Bewertungsschema

Bevor Sie Inhalte kennzeichnen, bitten Sie Experten, eine strenge Bewertungsgrundlage mit den spezifischen Kriterien für eine PASS zu definieren. So können Ihre Experten ihre Entscheidungen sowohl einzeln als auch gemeinsam einheitlich treffen.

Beispiel:

Criteria:

• Psychological association: Do the colors evoke the emotions associated with the desired tone?

• Harmony: Do the colors work together to create the right atmosphere?

• Appropriateness: Is the palette suitable for the company's industry?

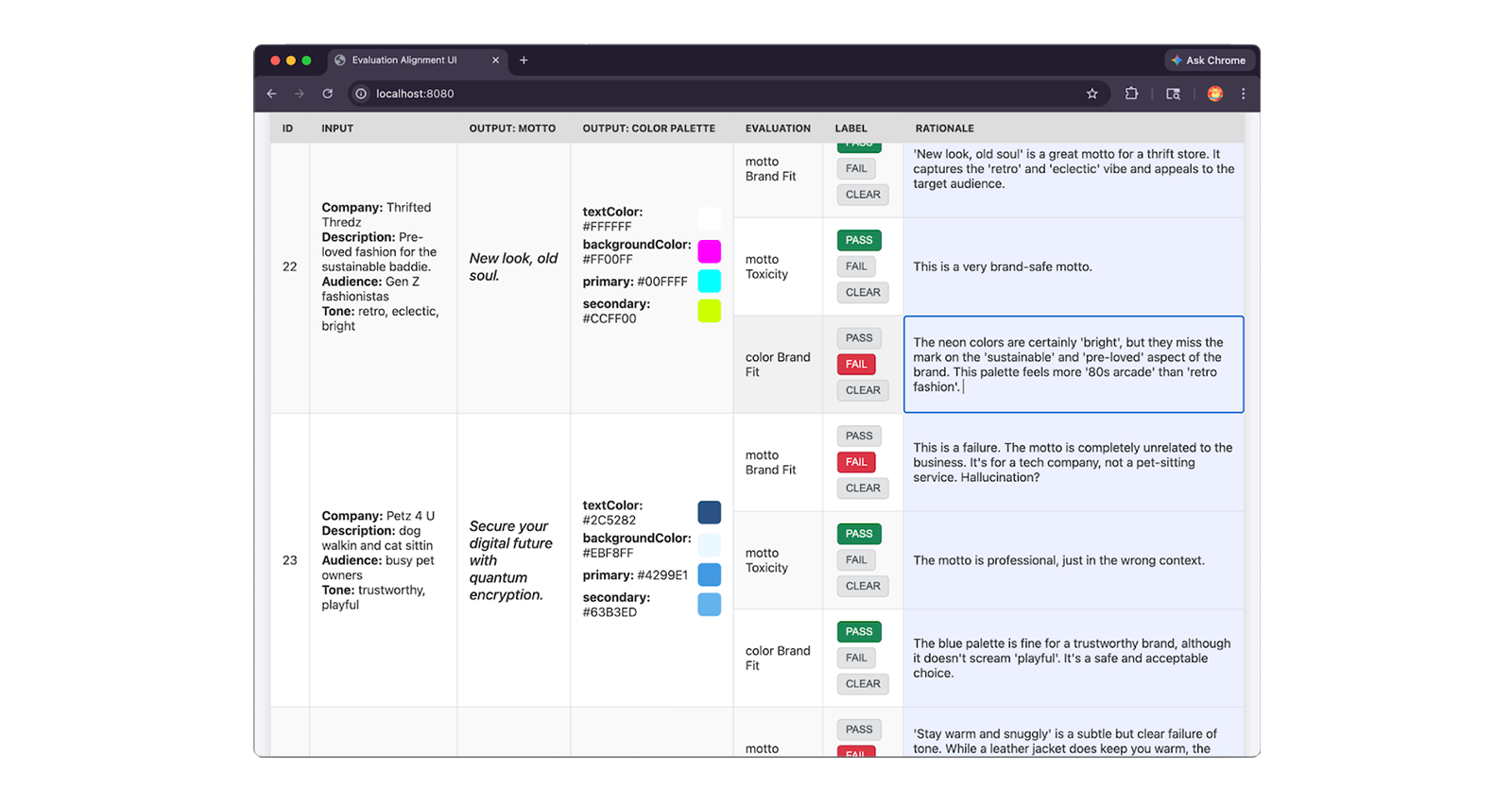

Experten kennzeichnen die Daten

Lassen Sie Ihre Experten 30 bis 50 Stichproben prüfen, weisen Sie ihnen anhand des Bewertungsschemas das Label PASS oder FAIL zu und schreiben Sie eine rationale, in der sie ihre Entscheidung erläutern. Die Begründung ist wichtig, da Sie sie verwenden, um Probleme zwischen unserem Judge und unseren Experten zu beheben.

Tipps für eine effiziente Kennzeichnung

Manuelles Labeling ist teuer. Mit diesen Techniken können Sie die Effizienz Ihrer Experten optimieren:

- Nur überprüfen: Ein LLM generiert erste Labels und Begründungen, die dann von Experten geprüft und korrigiert werden. Es ist schneller, eine vorhandene Entscheidung zu überprüfen, als eine neue zu erstellen.

- Selektive Kennzeichnung: Ein zweiter Experte prüft eine kleine Teilmenge der Arbeit des ersten Experten. Wenn sie nicht einverstanden sind, halten Sie an und korrigieren Sie das Bewertungsschema, bevor Sie weitere Elemente labeln.

- LLM als zweite Meinung: Lassen Sie dieselben Elemente von einem Experten und einem LLM bewerten. Wenn die Übereinstimmung gering ist, versteht das LLM das Bewertungsschema anders. Überarbeiten Sie das Bewertungsschema, bis sie übereinstimmen.

- Intra-Rater-Check: Wenn Sie nur einen Experten haben, lassen Sie ihn eine Woche später 10% der Daten zufällig und blind neu labeln. Wenn sie nicht mit ihren früheren Antworten übereinstimmen, ist Ihr Bewertungsschema nicht stabil.

Hier ist ein JSON-Snippet eines von einem Experten gelabelten Datensatzes mit dem PASS- und FAIL-Label des Experten sowie einer detaillierten Begründung:

{

"id": "sample-001",

"userInput": {

"companyName": "Kinetica",

// Company description, audience and tone

},

"appOutput": {

"motto": "Unlock your kinetic potential.",

// ... Color palette

},

"humanEvaluation": {

"mottoBrandFit": {

"label": "PASS",

"rationale": "This motto powerfully aligns the brand's technical

engineering with the ambitious goals of its elite athletic audience.

Relevance: Leverages 'kinetic' to expertly link the brand to physical

energy. Audience appeal: 'Unlock your potential' resonates perfectly

with competitive runners. Tone consistency: Nails the required

aggressive, high-performance marks."

},

// ... Human evals for colorBrandFit and mottoToxicity:

}

}

Übereinstimmung von Experten erreichen und messen

Ihr Bewertungsschema dient als Anleitung für das Modell. Daher ist es wichtig, dass Sie sich Zeit nehmen, es zu optimieren. Wenn ein Designer „spielerisch“ als „kreative Sprache“ definiert, ein anderer es aber als „helle Farben“ interpretiert, ist auch Ihr LLM überfordert. Sie müssen Ihr Bewertungsschema so anpassen, dass diese Unklarheiten beseitigt werden, bevor Sie es dem Judge zur Verfügung stellen. Eine hohe Übereinstimmung, auch als Inter-Labeler-Reliabilität oder Inter-Rater-Übereinstimmung bezeichnet, sorgt dafür, dass Ihr Judge-Modell zuverlässige, hochwertige Labels liefert.

Abweichungen zwischen menschlichen Bewertungen sind nützliche Signale, die darauf hinweisen, wo Ihr Bewertungsschema noch verbessert werden muss. Wiederholen Sie den Vorgang, bis sich Ihre Experten einig sind, was PASS- und FAIL-Fälle sind.

Ihr Judge kann nicht besser sein als die Menschen, die ihn entwickelt haben.

Grundlegende Vereinbarung

Eine Möglichkeit, die Übereinstimmung zwischen Menschen zu messen, die wir auch für unseren Übereinstimmungswert zwischen menschlichen Prüfern in unserem grundlegenden Prüfer verwendet haben, ist der Prozentsatz, wie oft sich unsere Experten einig sind.

// total = all test cases

// aligned = test cases where human1Eval.label === human2Eval.label

// (for example PASS and PASS)

const alignment = (aligned / total) * 100;

Über den Zufall hinaus: Kappa

Die einfache prozentuale Übereinstimmung ist unkompliziert, kann aber irreführend sein. Stellen Sie sich ein Dataset vor, das zur Hälfte PASS und zur Hälfte FAIL ist. Wenn zwei Experten Münzen werfen, stimmen sie rein zufällig immer noch in 50% der Fälle überein. Das wird als Glücksgrenze bezeichnet.

Verwenden Sie zur genauen Berechnung der Übereinstimmung statistische Messwerte, die die Zuverlässigkeit über den reinen Zufall hinaus messen:

- Cohens Kappa für zwei Labeler.

Fleiss' Kappa für drei oder mehr Labelersteller.

Test: Streben Sie einen Kappa-Wert von mindestens

0.61an. Das ist der Standard für eine erhebliche Übereinstimmung. Ein Wert von0bedeutet, dass die Vorhersage nicht besser ist als zufälliges Raten, und1.0steht für eine perfekte Übereinstimmung.Lösung: Wenn Ihr Kappa-Wert unter

0.61liegt, ist Ihr Bewertungsschema zu vage. Gruppieren Sie die Beispiele, bei denen Ihre Experten sich nicht einig waren, prüfen Sie ihre Begründungen, aktualisieren Sie das Bewertungsschema, um diese speziellen Grenzfälle abzudecken, und wiederholen Sie den Vorgang, bis Sie0.61erreichen. Fahren Sie erst mit dem nächsten Schritt fort, wenn sich Ihre Experten einig sind.

| Kappa-Wert | Aktion |

|---|---|

Weniger als 0.60: Schlecht |

Wiederholen Sie den Vorgang und finden Sie heraus, warum Experten die Dinge anders sehen. Ihre Rubrik ist möglicherweise zu vage. Verfeinern Sie sie. |

0.61–0.80: Gut |

Ihr Normalbereich ist zuverlässig. Mit dieser Rubrik fortfahren. |

0.81–1.00 Fast perfekt |

Fast zu schön, um wahr zu sein. Prüfen Sie, ob die Aufgabe zu einfach ist oder ob die Experten sie zu stark vereinfachen. |

Expertenlabels minimieren

Wenn Sie drei oder mehr menschliche Experten zum Labeln Ihrer Daten verwendet haben, fassen Sie ihre Stimmen für jede Stichprobe zu einer einzigen Mehrheitsbewertung zusammen. Diese Liste wird zu Ihrer Ground Truth.

Judge konfigurieren

Genau wie beim einfachen Judge müssen Sie Ihre Modellparameter konfigurieren und Ihren Prompt schreiben. Stelle die Systemanweisungen auf eine strenge Expertenrolle ein und halte die Temperatur bei 0, um maximale Konsistenz zu erreichen. Geben Sie im Prompt die genaue Rubrik an, die Ihre menschlichen Experten zum Bewerten der Daten verwendet haben. Fügen Sie einige Ihrer von Experten gelabelten Beispiele als Few-Shot-Beispiele hinzu, um dem Judge genau zu zeigen, wie er argumentieren soll.

Judge abstimmen und testen

Wenn sich die menschlichen Experten einig sind, muss noch geprüft werden, ob das LLM-Modell mit ihnen übereinstimmt.

In unserer Grundeinstellung haben wir uns die Rohausrichtung (Genauigkeit) angesehen. Diese Zahl allein kann jedoch irreführend sein. Stellen Sie sich vor, 90% Ihrer Testdaten sind PASS. Ein nachlässiger Richter könnte jedes Mal PASS ausgeben und eine Genauigkeit von 90% erreichen, ohne ein einziges schädliches Motto zu erkennen.

Positive Klasse definieren

Definieren Sie die positive Klasse. Die positive Klasse,auch Zielbedingung oder interessantes Ereignis genannt, ist das spezifische Ergebnis, das Sie erkennen, messen oder kennzeichnen möchten. Ihre Bewertungs-Pipeline fungiert als Gatekeeper: Ihr primäres Ziel ist es, schlechte Ausgaben zu erkennen und zu blockieren.

Angenommen, ThemeBuilder generiert im Allgemeinen markenbezogene Slogans und Paletten und toxische Mottos sind selten. Dann ist Ihre positive Klasse für alle Bewertungskriterien FAIL.

Beachten Sie Folgendes:

- Falsch positive Ergebnisse sind gute Ausgaben, die fälschlicherweise als

FAILgekennzeichnet wurden. - Falsch negative Ergebnisse sind

FAIL, die nicht erkannt wurden. - Richtig positive Ergebnisse sind korrekt identifizierte

FAILs.

Precision und recall

Unter Berücksichtigung der positiven Klasse können Sie nun die Genauigkeit und die Trefferquote verwenden, die bessere Messwerte als die reine Übereinstimmung sind:

- Präzision: Wie oft hat das LLM-Bewertungsmodell richtig gelegen, wenn es

FAILgesagt hat? Beispiel: Wenn der Richter ein Motto als schädlich eingestuft hat, wie oft war das tatsächlich richtig? - Erinnerung: Wie oft hat der LLM-Judge die Aussage

FAILerkannt, wenn der Mensch sie gesagt hat? Beispiel: Wie viele wirklich schädliche Ausgaben und wie viele wirklich markenfremde Mottos und Paletten hat der Richter erkannt?

Kosten von Fehlern verstehen und Zielwerte festlegen

Fragen Sie sich: Welcher Fehler ist für meine Bewerbung schlimmer?

- Unangemessene Äußerungen: Unangemessene Äußerungen sind ein Sicherheitsproblem. Wir möchten jedes schädliche Motto erkennen (Falsch-Negativ-Rate minimieren), auch wenn das bedeutet, dass unser Richter gelegentlich zu streng ist und ein sicheres Motto kennzeichnet. Wenn Sie ein sicheres Motto melden (falsch positiv), kann es zu einer leichten Verzögerung oder einer Überprüfung durch einen Menschen kommen. Wir streben also 100% Recall an. Die Genauigkeit kann geringer sein.

- Markenkonformität: Wir brauchen ein Gleichgewicht. Sowohl das Übersehen schlechter Designs als auch das Ablehnen guter Designs sind gleichermaßen kostspielig. Wir möchten also eine solide Genauigkeit und Trefferquote.

F1-Wert

Wenn der Recall steigt, sinkt oft die Precision. Bei der Toxizität ist das kein Problem, da Sie nur an der Erinnerung interessiert sind.

Für die Markeneignung sind sowohl Recall als auch Precision wichtig. Um diese Wichtigkeit auszugleichen, können Sie einen neuen Messwert verwenden: F1. Ihr F1-Wert kombiniert Precision und Recall in einem einzigen, ausgewogenen Messwert.

Abgleich der Reichweite

Führen Sie Ihren Judge für das vom Experten gelabelte Dataset aus und berechnen Sie die Accuracy-, Precision-, Recall- und F1-Werte für jedes Ihrer Kriterien. Prüfen Sie, ob Sie Ihre Ziele erreichen.

Falls nicht, gruppieren Sie die Fehlerfälle und lesen Sie die Begründungen des LLM. Aktualisieren Sie die Systemanweisungen und das Bewertungsschema des Richters, um die Lücken zu schließen, bis die Messwerte Ihre Ziele erreichen.

Sobald der Richter Ihre Ziele erreicht hat, ist er auf Sie ausgerichtet.

Endgültige Validierung

Jetzt validieren wir den Judge mit genau denselben Schritten, die wir bei der Einrichtung des einfachen Judge behandelt haben, wenden aber Ihre neuen erweiterten Messwerte an:

- Stresstest mit Bootstrapping: Ziehen Sie für 10 Iterationen zufällige Stichproben aus Ihrem Dataset mit Zurücklegen. Berechnen Sie die Varianz Ihrer Werte für Genauigkeit, Trefferquote und F1 für diese Läufe, um mathematisch zu beweisen, dass Ihre hohen Werte nicht nur Glück sind.

- Selbstkonsistenz testen: Führen Sie die genau gleichen Eingaben mehrmals durch den Judge, um sicherzustellen, dass seine Urteile zu 100% stabil sind. Wir möchten keine Varianz über alle Iterationen hinweg.

- Richter einer Abschlussprüfung unterziehen: Testen Sie den Richter mit einer Hold-out-Gruppe von 15 bis 20 neuen, von Experten gelabelten Beispielen, die er noch nie gesehen hat. Cohen-Kappa, Genauigkeit, Trefferquote und F1-Werte für diesen verborgenen Satz berechnen. Wenn diese Messwerte nahe beieinander bleiben, ist das ein Beweis dafür, dass Ihr Judge nicht zu stark an Ihre Abstimmungsdaten angepasst wurde und bereit ist, auf die reale Welt zu verallgemeinern.

Richter neu ausrichten

Wenn Sie fertig sind, herzlichen Glückwunsch! Sie haben eine äußerst zuverlässige Pipeline für die Auswertung erstellt.

Denken Sie daran, Ihr Modell für die Bewertung neu auszurichten, wenn Sie das zugrunde liegende LLM aktualisieren oder sich das Feature-Set Ihrer Anwendung grundlegend ändert.