Возможно, магия LLM подтолкнет нас к тому, чтобы пропустить этап тестирования, но именно оценки являются ключом к уверенному выпуску продукции на рынок.

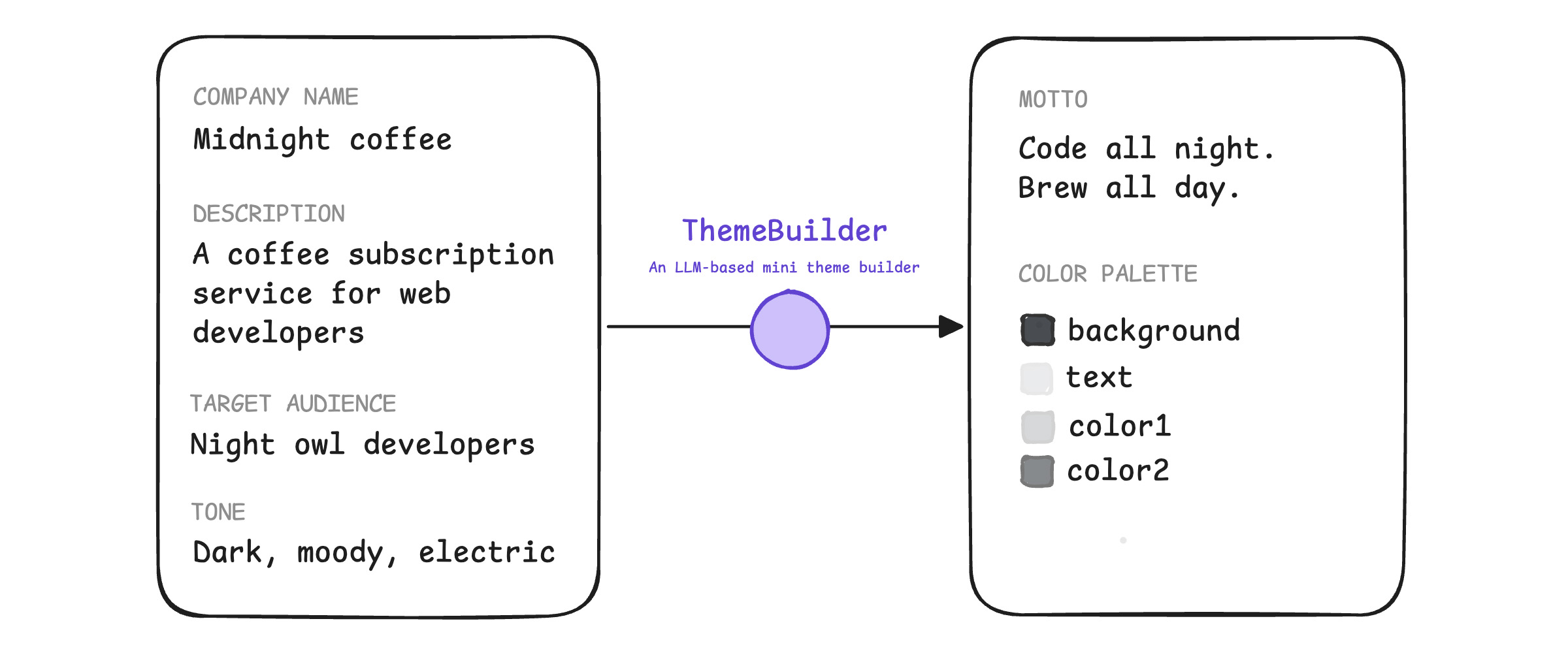

Представьте, что вы разрабатываете прототип веб-конструктора тем оформления. Это интересный инструмент: в веб-приложении пользователь вводит название и описание компании, целевую аудиторию, а также тон и настроение. Фронтенд отправляет эти данные на ваш сервер. Ваш сервер использует большую языковую модель (LLM) для генерации креативного слогана, соответствующего ожидаемому тону и настроению, а также доступной цветовой палитры, соответствующей бренду. Он возвращает эти данные в виде небольшого JSON-объекта.

Назовём это приложение ThemeBuilder.

Вы выбираете базовую программу магистратуры в области права и дорабатываете предложенный проект. Вашему штатному дизайнеру нравятся цветовые палитры, а девизы звучат запоминающеся.

Теперь у вас есть следующие вопросы:

- Готово ли приложение к производству? Вы не знаете, достаточно ли стабильно качество выходных данных вашего приложения. Некоторые внутренние тестировщики сообщают о поврежденных палитрах или не соответствующих бренду слоганах. После исправления одного случая появляются еще две ошибки.

- Могу ли я сменить модель? Возможно, вам стоит обновить LLM до последней версии, чтобы уменьшить задержку, или перейти с управляемого сервиса на модель с самостоятельным размещением, чтобы снизить затраты. Вы не знаете, улучшит или ухудшит это результаты работы вашего приложения, и у вас нет возможности проверить наличие регрессий.

- Безопасно ли отправлять? Кто-то однажды сообщил о выбросе токсичных веществ, но воспроизвести это невозможно. Это случайность или следует заблокировать запуск?

Ваша команда останавливает запуск, потому что качество выходных данных LLM слишком сильно колеблется. Трудно обрести уверенность в выпуске без тестирования.

Почему нужно гадать, а не проверять?

При первом знакомстве с ИИ возникает соблазн взглянуть на несколько результатов, решить, что они выглядят неплохо, и двигаться дальше. Почему же можно полагаться на интуицию, а не на измерения и данные?

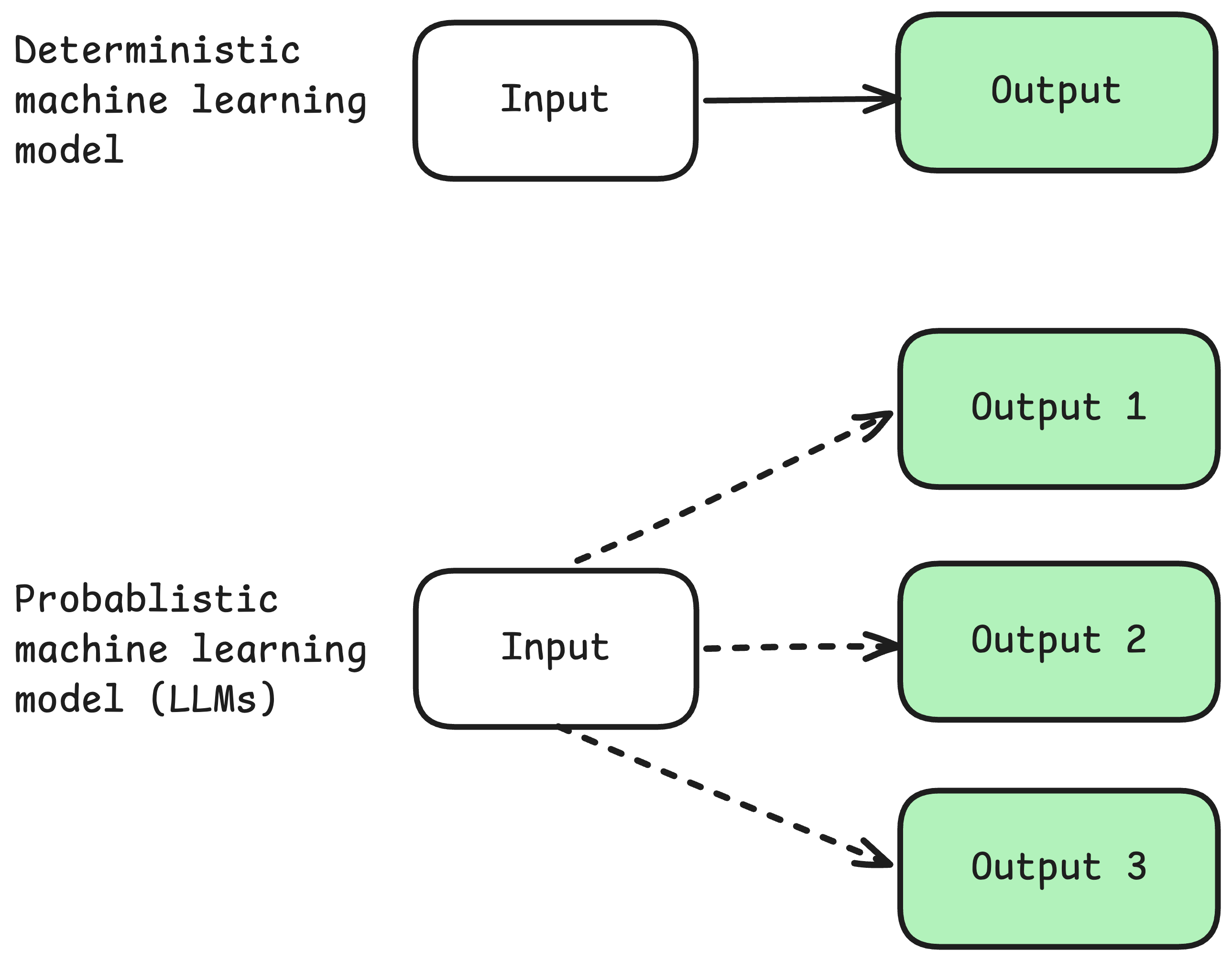

Вероятно, вы делаете это потому, что LLM-ы являются вероятностными, а не детерминированными . Это означает, что даже если вы укажете одно и то же название компании, описание, целевую аудиторию и тон, ThemeBuilder может выдать другой девиз и цветовую палитру.

Не существует единственно правильного ответа на вопрос о том, что можно назвать запоминающимся девизом или соответствующей фирменному стилю цветовой палитрой.

Творческий подход, основанный на программе LLM, — это здорово. Но недетерминизм противоречит идее инженерии. Поэтому можно сделать вывод, что приложения, основанные на программе LLM, вероятно, не поддаются проверке.

Оценки приходят на помощь.

В мире LLM лучшие практики разработки остаются актуальными. Мы можем и должны тестировать наши приложения, созданные на основе LLM. Нам просто нужны другие методы. Эти методы называются оценками , или сокращенно evals. Оценки предполагают новые рабочие процессы, но ваши существующие знания в области тестирования напрямую переносятся на создание качественных оценок.

Оценки — это тесты для ваших функций ИИ. Эти тесты помогают создать важную обратную связь: если вы построите надежный конвейер оценок, ваши функции на основе LLM будут хорошо работать для ваших пользователей. Тогда ваша команда сможет уверенно внедрять эти функции.

Если вы работаете с магистрами права, то освоение методов надежной оценки — одно из лучших применений вашего времени.

Теперь давайте узнаем об оценках!