Keajaiban LLM mungkin membuat kita tergoda untuk melewati pengujian, tetapi evaluasi adalah kunci untuk meluncurkan produk dengan percaya diri.

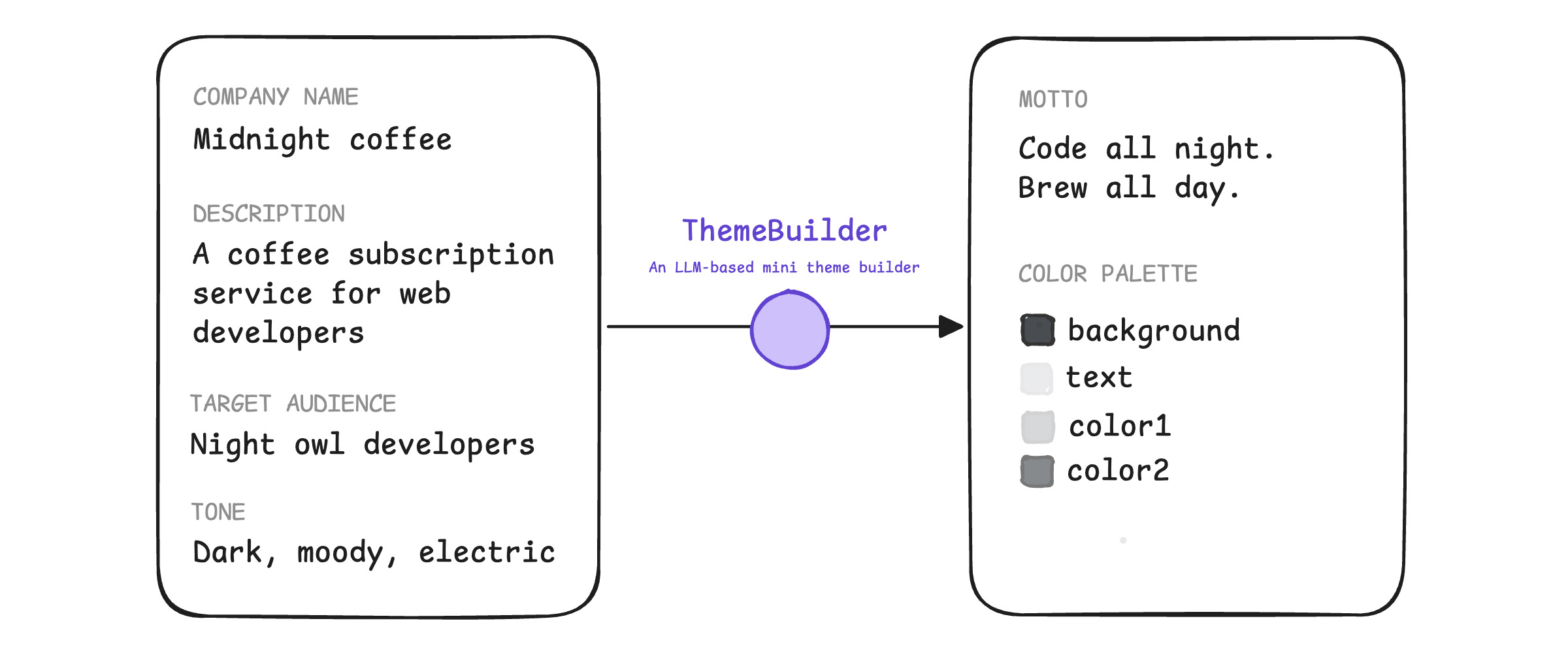

Bayangkan Anda sedang membuat prototipe pembuat tema berbasis web. Alat ini menyenangkan: dalam aplikasi web, pengguna memasukkan nama dan deskripsi perusahaan, target audiens, serta gaya bahasa dan suasana. Frontend mengirimkan ini ke server Anda. Server Anda menggunakan model bahasa besar (LLM) untuk membuat motto kreatif yang sesuai dengan nada dan suasana yang diharapkan, serta palet warna yang mudah diakses dan selaras dengan merek. API ini menampilkan data ini sebagai objek JSON kecil.

Kita akan menyebut aplikasi ini ThemeBuilder.

Anda memilih LLM dasar dan melakukan iterasi pada perintah. Desainer internal Anda menyukai palet warna, dan motto-motto tersebut terdengar menarik.

Sekarang, Anda memiliki pertanyaan berikut:

- Apakah sudah siap untuk produksi? Anda tidak tahu apakah kualitas output aplikasi Anda cukup konsisten. Beberapa penguji internal melaporkan palet yang rusak atau motto yang tidak sesuai merek. Saat Anda memperbaiki satu kasus, dua bug lainnya muncul.

- Dapatkah saya mengubah model? Anda mungkin ingin mengupgrade ke versi terbaru LLM yang sama untuk menghemat latensi, atau beralih dari layanan terkelola ke model yang dihosting sendiri untuk mengurangi biaya. Anda tidak tahu apakah hal itu akan meningkatkan atau memperburuk hasil aplikasi Anda, Anda tidak memiliki cara untuk menguji regresi.

- Apakah aman untuk dikirim? Seseorang pernah melaporkan output berbahaya, tetapi Anda tidak dapat mereproduksinya. Apakah ini kebetulan atau Anda harus memblokir peluncuran?

Tim Anda menghentikan peluncuran karena kualitas output LLM terlalu bervariasi. Sulit untuk membangun keyakinan untuk meluncurkan tanpa pengujian.

Mengapa menebak-nebak, bukan menguji?

Saat pertama kali membangun dengan AI, Anda mungkin tergoda untuk melihat beberapa output, memutuskan bahwa output tersebut terlihat baik, dan melanjutkan. Mengapa Anda mengandalkan intuisi, alih-alih pengukuran dan data?

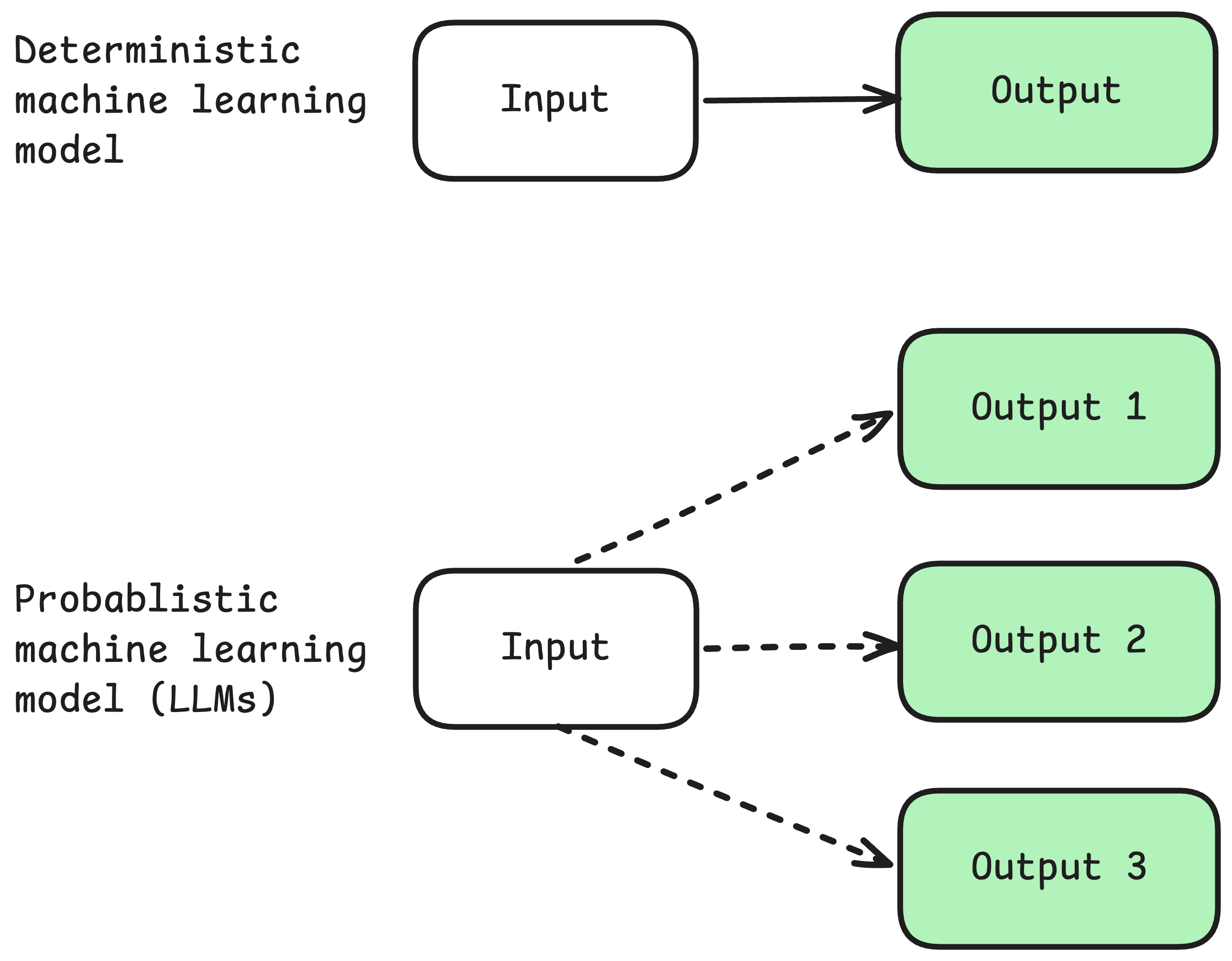

Anda mungkin melakukan hal ini karena LLM bersifat probabilistik, bukan deterministik. Artinya, meskipun Anda memberikan nama perusahaan, deskripsi, audiens, dan gaya bahasa yang sama, ThemeBuilder dapat menghasilkan motto dan palet warna yang berbeda.

Tidak ada satu jawaban yang benar untuk motto yang menarik atau palet warna sesuai merek.

Kreativitas LLM sangat bagus. Namun, non-determinisme terasa bertentangan dengan ide rekayasa. Jadi, Anda mungkin menyimpulkan bahwa aplikasi berbasis LLM mungkin tidak dapat diuji.

Evaluasi hadir untuk membantu

Dalam dunia LLM, praktik terbaik pengembangan tetap berlaku. Kita dapat dan harus menguji aplikasi berbasis LLM. Kita hanya memerlukan teknik yang berbeda. Teknik ini disebut evaluasi, atau singkatnya eval. Evaluasi melibatkan alur kerja baru, tetapi keahlian pengujian Anda yang ada akan langsung diterapkan untuk membuat evaluasi yang efektif.

Evaluasi adalah pengujian untuk fitur AI Anda. Pengujian ini membantu Anda membuat loop masukan utama: jika Anda membuat pipeline evaluasi yang andal, fitur berbasis LLM Anda akan berfungsi dengan baik bagi pengguna Anda. Kemudian, tim Anda dapat mengirimkan fitur dengan percaya diri.

Jika Anda membangun dengan LLM, mempelajari cara menerapkan evaluasi yang andal adalah salah satu penggunaan waktu terbaik Anda.

Sekarang, pelajari evaluasi.