LLM 的神奇功能可能會誘使我們略過測試,但評估是您安心發布的關鍵。

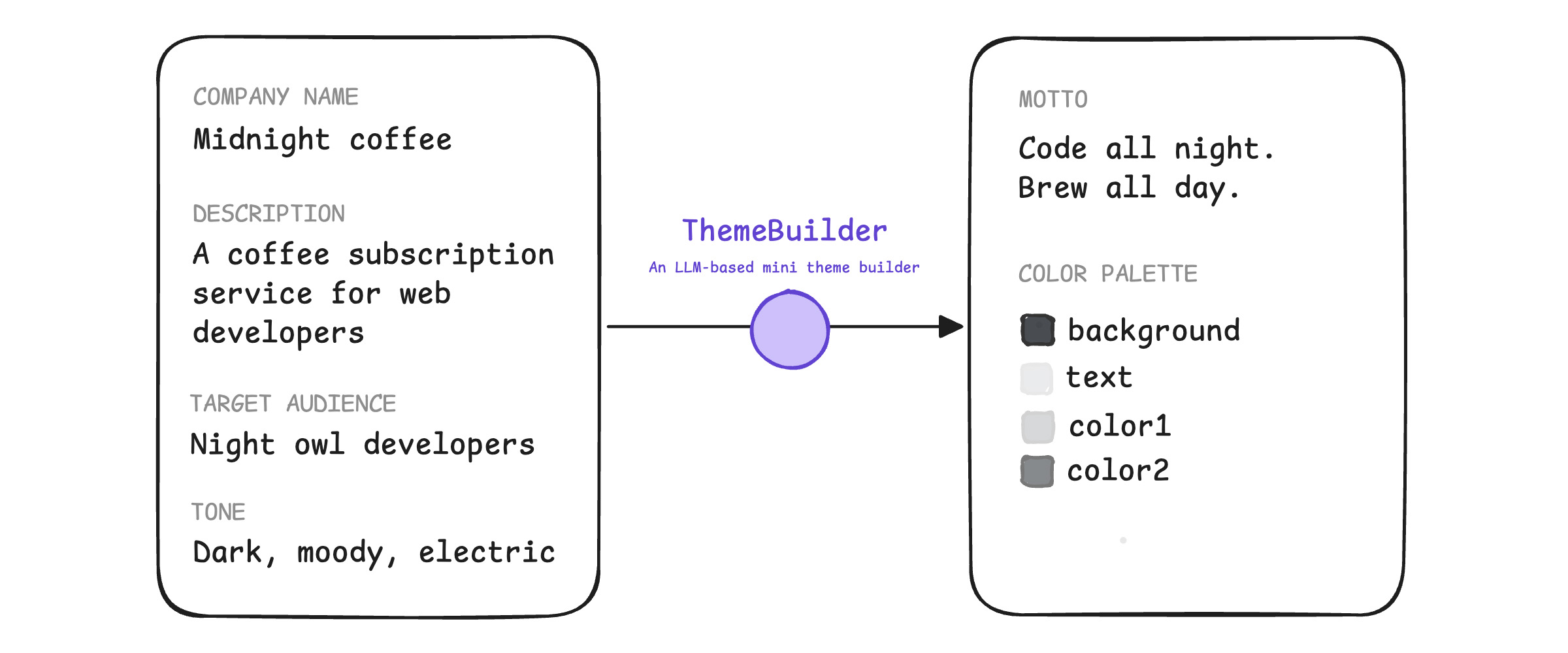

假設您正在製作網頁式主題建構工具的原型。這項工具十分有趣:使用者在網頁應用程式中輸入公司名稱和說明、目標對象,以及語氣和風格,前端會將這項資訊傳送至伺服器。伺服器會使用大型語言模型 (LLM) 生成符合預期語氣和氛圍的創意口號,以及與品牌一致的無障礙調色盤。並以小型 JSON 物件的形式傳回這項資料。

我們將這個應用程式命名為 ThemeBuilder。

您選取基礎 LLM,並反覆調整提示。內部設計師很喜歡這些色調,標語也朗朗上口。

現在,您有以下問題:

- 是否已準備好投入正式環境?您不確定應用程式的輸出品質是否夠穩定。部分內部測試人員回報調色盤損壞或宣傳口號不符合品牌形象。修正一個案例後,又出現兩個錯誤。

- 可以變更模型嗎?您可能想升級至相同 LLM 的最新版本,以節省延遲時間,或是從代管服務改用自行代管模型,以降低成本。您不知道這項變更會改善還是降低應用程式的輸出內容品質,也無法測試迴歸。

- 可以安全運送嗎?有人回報一次有害輸出內容,但您無法重現。這只是僥倖還是應該封鎖發布?

由於 LLM 的輸出內容品質差異過大,團隊決定停止發布。 如果沒有測試,很難有信心發布。

為什麼要測試,而不是猜測?

首次使用 AI 建構內容時,您可能會想查看幾個輸出內容,覺得看起來沒問題就繼續作業。為什麼您可能會依賴直覺,而非測量結果和資料?

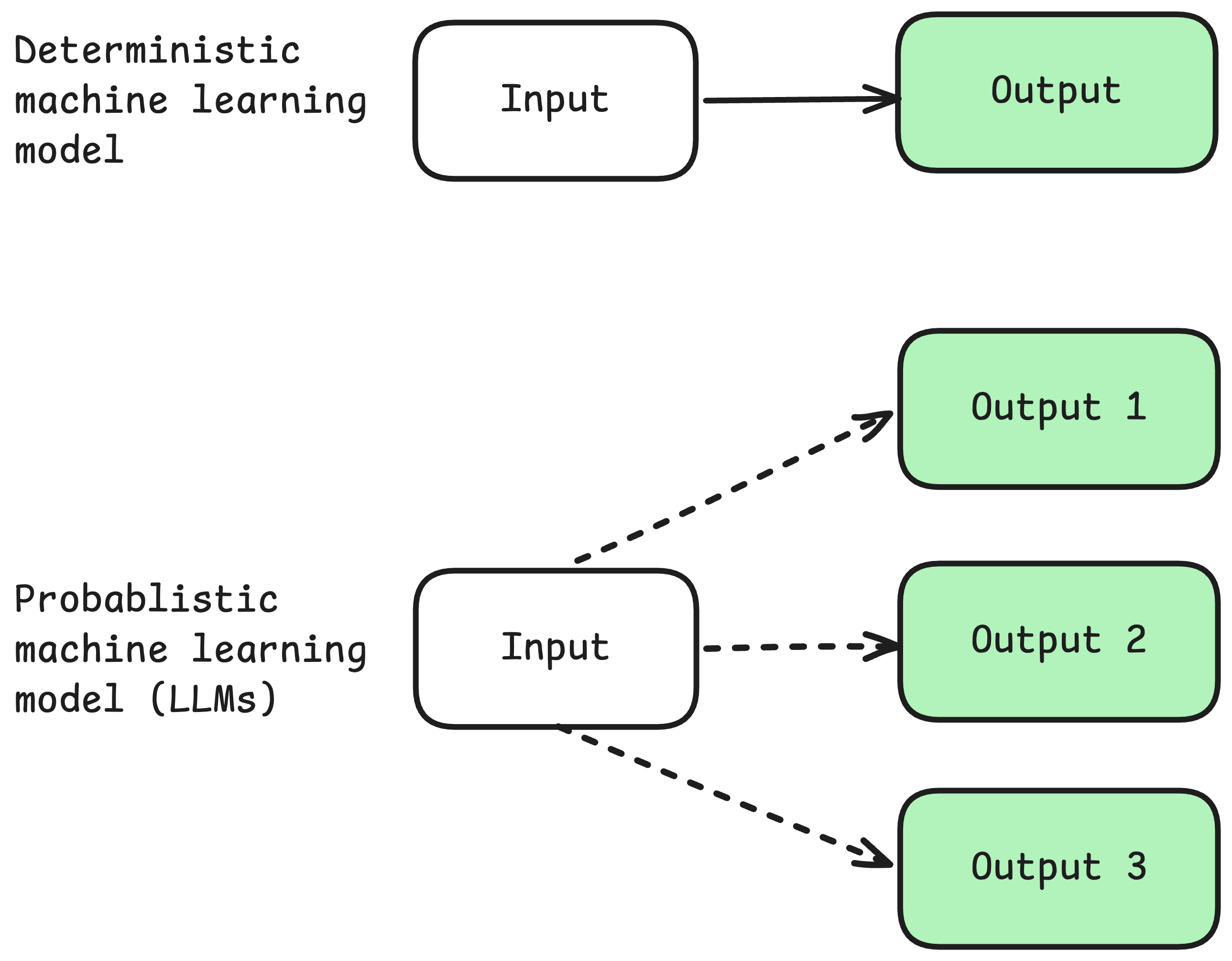

您可能這麼做,是因為大型語言模型是機率性而非確定性模型。也就是說,即使您提供相同的公司名稱、說明、目標對象和語氣,ThemeBuilder 也可能會輸出不同的座右銘和調色盤。

什麼是引人入勝的座右銘或符合品牌形象的色調,並沒有單一正確答案。

LLM 的創意能力很強,但非決定性與工程概念似乎格格不入。因此您可能會認為,以 LLM 為基礎的應用程式可能無法測試。

Evals 到援救

在大型語言模型領域,開發最佳做法依然適用。我們應該測試以 LLM 為基礎的應用程式。我們只需要不同的技巧。 這些技術稱為「評估」,或簡稱「評估」。評估作業會用到新的工作流程,但您現有的測試專業知識可直接用於建構優質的評估作業。

評估是 AI 功能的測試。這些測試有助於建立重要的意見回饋迴路:如果您建構強大的評估管道,以 LLM 為基礎的功能就能為使用者提供優質服務。這樣一來,團隊就能放心發布功能。

如果您使用 LLM 建構應用程式,學習如何實作強大的評估功能,將是您最有效率的投資。

現在來瞭解評估!