ما الذي سيبقى وما الذي سيتغير: ربط معرفتك باختبار الويب بعالم النماذج اللغوية الكبيرة الجديد

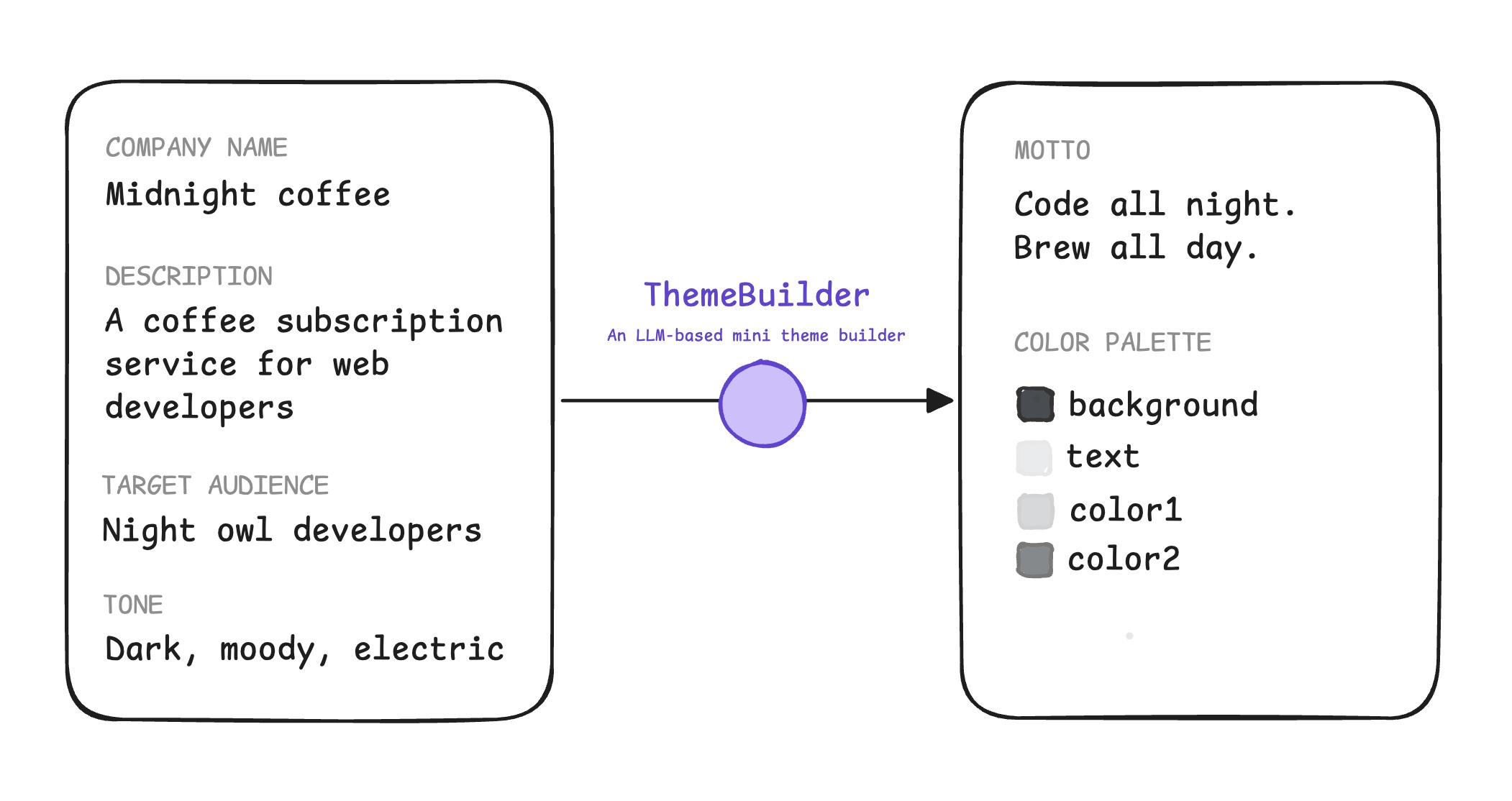

مثال على التطبيق

ThemeBuilder هو التطبيق النموذجي الذي سنستخدمه في هذه السلسلة. يُخرج ThemeBuilder كائن JSON يحتوي على شعار من إنشاء نموذج لغوي كبير ولوحة ألوان.

- يجب أن يتطابق الشعار ولوحة الألوان مع اسم العلامة التجارية والوصف والجمهور والنبرة التي تم إدخالها.

- يجب ألا يكون الشعار مسيئًا ويجب أن يكون قصيرًا (أقل من 6 كلمات).

- يجب أن تكون لوحة الألوان متوافقة مع معايير إمكانية الوصول، كما هو محدّد في إرشادات WCAG الدنيا، مع نسبة تباين 4.5:1.

التقييمات الموضوعية والذاتية

كيف يمكن اختبار أنّ ThemeBuilder يعمل على النحو المطلوب؟

التقييمات المستندة إلى القواعد (يُطلق عليها أحيانًا اسم التقييمات الدقيقة) هي اختبارات موضوعية تتضمّن إجابة ثنائية، أي صحيحة أو غير صحيحة. وهي الأنسب للأسئلة حول تنسيق البيانات أو نسبة التباين أو غير ذلك من الأسئلة التي تتطلّب إجابة محددة. يمكنك تنفيذ هذه الاختبارات باستخدام رمز عادي آلي.

بعض عمليات التحقّق موضوعية، وتتضمّن إجابة ثنائية صحيحة أو غير صحيحة. هذه الأسئلة هي الأنسب للاستفسارات حول تنسيق البيانات أو نسبة التباين أو غيرها من الأسئلة التي تتضمّن إجابة محددة. يمكنك تنفيذ هذه الاختبارات باستخدام رمز عادي آلي. يُطلق على هذه التقييمات اسم التقييمات المستندة إلى القواعد أو التقييمات الدقيقة.

على سبيل المثال:

// Example rule-based eval: data format

function evaluateFormat(appOutput) {

// Check if JSON is valid, colors are hex, no empty strings, motto is 6 words or fewer

// Use deterministic tools like zod for schema validation

return "PASS"; // or "FAIL"

}

تكون عمليات التحقّق الأخرى ذاتية، مثل توافق الشعار ولوحة الألوان مع العلامة التجارية والجمهور. على الرغم من أنّ عملية اكتشاف المحتوى السام هي مهمة تصنيف، إلا أنّها أيضًا عملية ذاتية لأنّها تتضمّن إصدار أحكام.

مع أنّ الاختبارات الذاتية تتضمّن أيضًا التصنيف، يمكن أن يختلف نطاق الإجابات الصحيحة وغير الصحيحة بشكل كبير. على سبيل المثال، تقييم مدى توافق العلامة التجارية والجمهور مع الشعار ولوحة الألوان إنّ عملية اكتشاف المحتوى السام هي عملية ذاتية أيضًا.

مع أنّ تقييم الصفات الذاتية قد يبدو أمرًا لا يمكن أن يفعله سوى خبير بشري، يمكنك أتمتة هذه الاختبارات على نطاق واسع باستخدام تقنية LLM-as-a-judge.

تتسم [نماذج اللغات الكبيرة] بالسرعة وسهولة الاستخدام والتكلفة المنخفضة نسبيًا [...] وقد أصبحت إحدى أكثر الطرق شيوعًا، إن لم تكن الأكثر شيوعًا، لتقييم نماذج الذكاء الاصطناعي في مرحلة الإنتاج.

—مهندسة الذكاء الاصطناعي، تشيب هويين

على سبيل المثال:

// Example LLM-as-a-judge eval for a subjective quality like brand fit

async function evalBrandFit(userInput, appOutput) {

const brandPrompt = `You are an expert brand strategist. Evaluate the

following generated motto for the company whose target audience is

${userInput.audience}, and who describes itself as

${userInput.companyDescription}: ${appOutput.motto}`

// Call the LLM judge

const evalResult = evalWithLLM(brandPrompt);

// Return the consolidated results

return {

mottoBrandFit: evalResult,

};

}

// Helper that communicates with the LLM API

async function evalWithLLM(prompt) {

// ... Call LLM with the prompt ...

// ... Parse the resulting judgement ("PASS" or "FAIL") + rationale

return {

status: "PASS",

rationale: "This motto perfectly captures the brand and tone, because..."

};

}

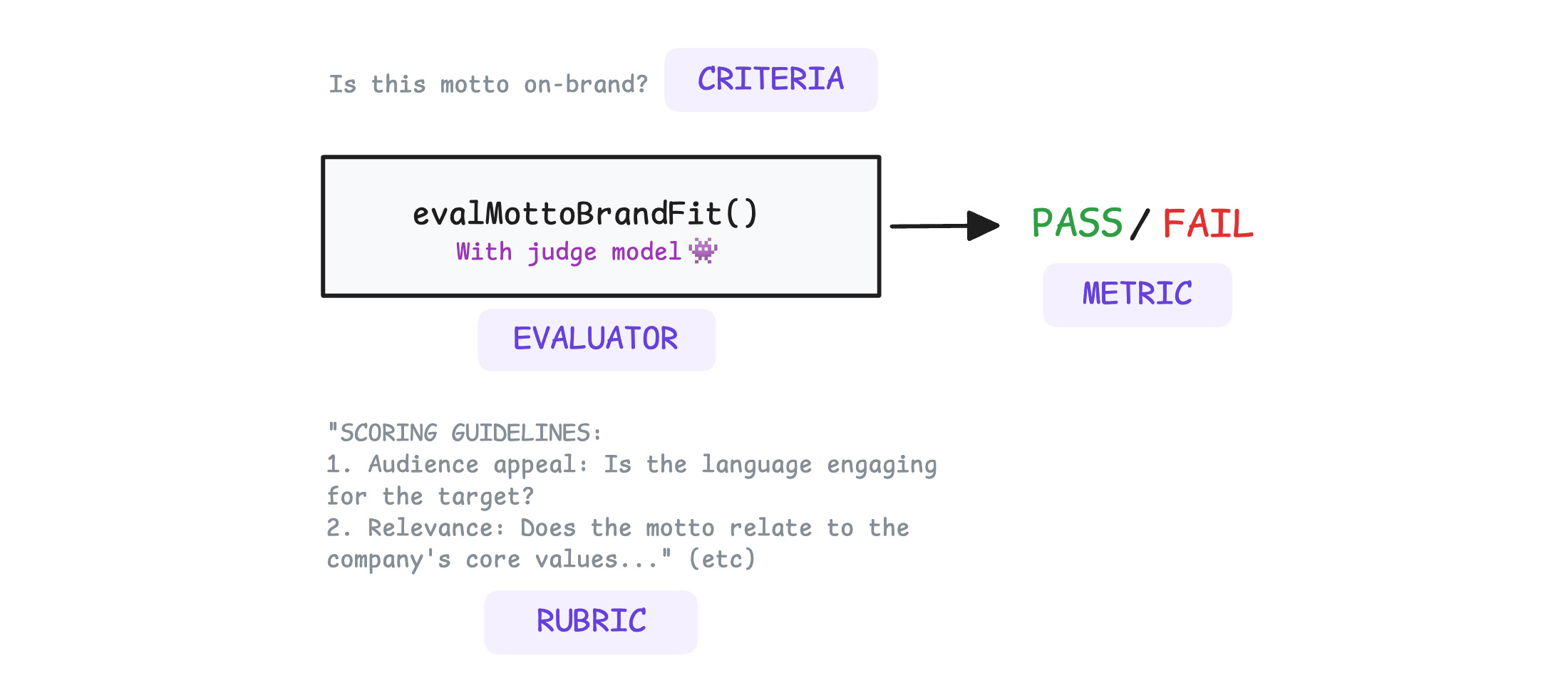

يحاكي النموذج الحكم البشري، لذا تحتاج إلى طريقة لإخبار القاضي بالضبط بما تبحث عنه. يمكنك إجراء ذلك من خلال تقديم نموذج تقييم للقاضي.

قاعدة التقييم هي مجموعة منظَّمة من المعايير أو إرشادات تحديد النتائج التي يستخدمها الحَكم (بشري أو ذكاء اصطناعي) لتقييم مخرجات. ويوفّر إطار عمل متسقًا لتقييم الجوانب الذاتية في كل عملية تقييم.

أنواع أخرى من التقييمات

يمكنك استخدام التقييمات المستندة إلى المراجع أو التقييمات الثنائية.

مستندة إلى المراجع

وتقيس هذه المقاييس التشابه مع الإجابة الصحيحة. استخدِم هذه الأدوات في مهام مثل الترجمة أو الحقائق الفنية التي تتوفّر لها إجابة صحيحة معروفة.

مقارنة ثنائية

قد يمنح القاضي درجة PASS لنسختَين مختلفتَين، حتى لو كانت إحداهما أفضل من الأخرى. تحلّ التقييمات الثنائية هذه المشكلة من خلال تزويد الحكَم بنتيجتَين (أ وب) للطلب نفسه، مع توجيه الحكَم لاختيار النتيجة الأفضل.

على سبيل المثال، لنفترض أنّك بصدد تقييم شعار لمقهى ودود:

Input: "Friendly cafe"

Pointwise evaluation:

Output A: "Come get coffee." // PASS

Output B: "Your morning smile in a cup." // PASS

2 PASS. Unconclusive!

Pairwise evaluation:

Output B wins. It captures the "friendly" tone more effectively than the generic Output A.

استخدِم التقييم الثنائي لاختيار إصدار النموذج الذي ستنشره، أو لمقارنة طلبيْن مختلفَين.

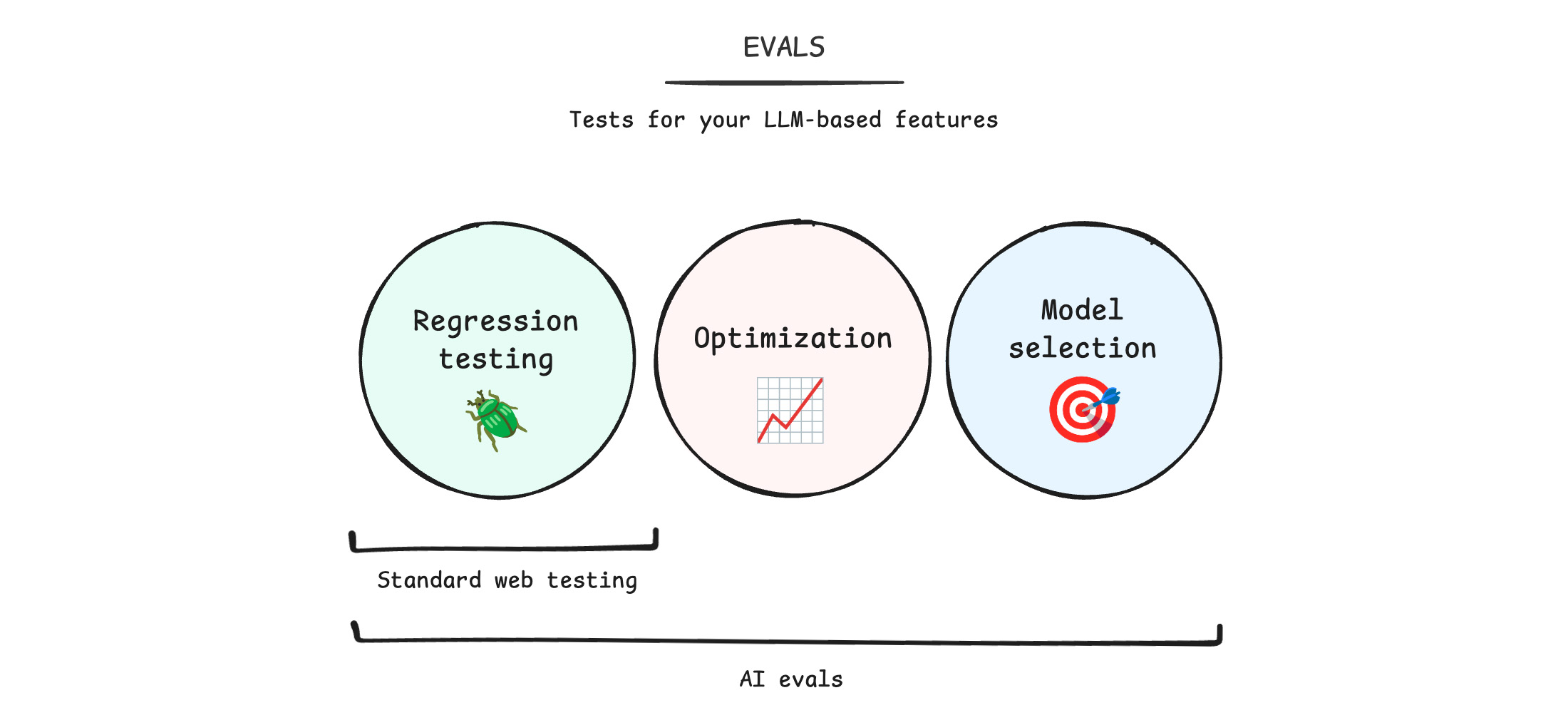

اختبار الويب العادي مقارنةً بتقييمات الذكاء الاصطناعي

نفترض أنّك، كقارئ لهذه الدورة التدريبية، تعرف كيفية اختبار موقع إلكتروني وتطبيق ويب. عند إضافة الذكاء الاصطناعي، عليك تغيير نموذجك الذهني الحالي. يمكنك استخدام التقييم المستند إلى الذكاء الاصطناعي لاتّخاذ الإجراءات التالية:

- إجراء اختبار التراجع: عند تغيير الطلب أو النموذج، هل حدثت مشاكل في التطبيق؟ هل تظهر لك لوحات ألوان غير صالحة أو شعارات مسيئة؟ على عكس تطبيق الويب الذي يمثّل فيه التوقف وظيفة برمجية، أنت هنا تتحقّق مما إذا كانت نتائج النموذج اللغوي الكبير عالية الجودة وآمنة. ويشمل ذلك الذاتية.

- تحسين تطبيقك: هل يتحسّن تطبيقك؟ هل تحسّن المقاييس التي تريدها، مثلاً هل تحصل على المزيد من الشعارات التي تتوافق مع علامتك التجارية بدون زيادة المحتوى المسيء؟

- اختيار النموذج المناسب: هل هناك نموذج أفضل لحالة الاستخدام؟ قبل ظهور الذكاء الاصطناعي، كان عليك اختيار حزمة الويب مرة واحدة. باستخدام الذكاء الاصطناعي، عليك مقارنة أداء النماذج بانتظام وتحديد فرص التبديل إلى نموذج أفضل (وربما أرخص).

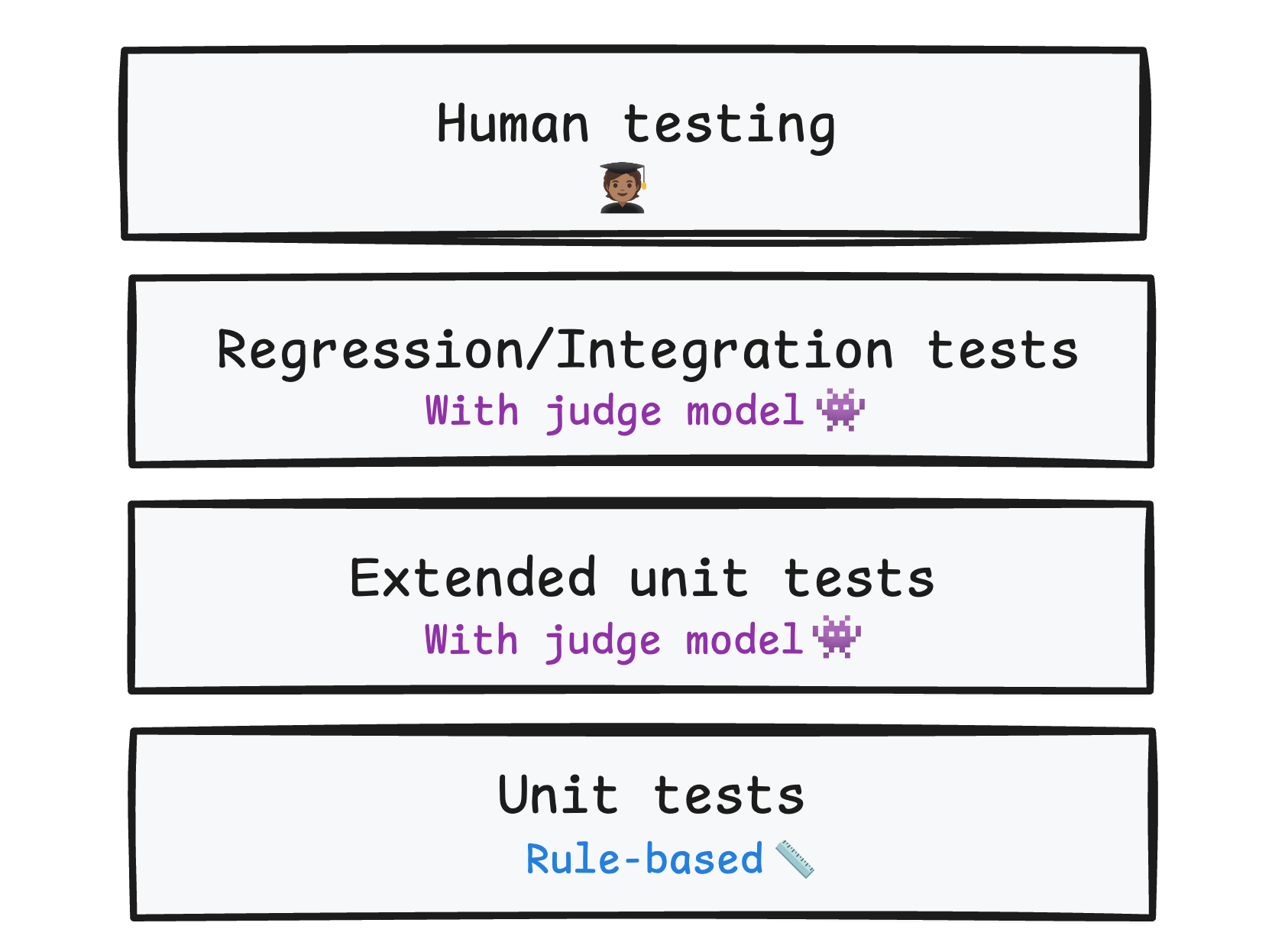

طبقات الاختبارات

يجب أن يتضمّن رمز البرنامج السليم طبقات متعددة من الاختبارات، مثل اختبارات الوحدات واختبارات الانحدار والاختبارات المتكاملة والاختبارات الشاملة. يجب أن تكون التقييمات أيضًا متعددة الطبقات.

- استخدِم عمليات التقييم المستندة إلى القواعد مع عمليات التقييم المستندة إلى نماذج لغوية كبيرة (LLM) كحكم، وذلك لأتمتة الاختبارات بالكامل لتطبيق الذكاء الاصطناعي. بهذه الطريقة، يمكنك رصد المشاكل في عملية التطوير اليومية وفي عملية الدمج المتواصل والتسليم المتواصل (CI/CD)، واختبار ما إذا كانت الإصدارات التجريبية تستوفي معايير الجودة.

- إجراء اختبارات الدمج والتحقّق من عدم حدوث تراجع في الأداء للتأكّد من الجودة على نطاق واسع

- إجراء تقييمات يدوية من قِبل المستخدمين كاختبار قبول

بالإضافة إلى عمليات التقييم هذه التي تجريها في مدّة التصميم، يمكنك رصد عدد الزيارات في مرحلة الإصدار العلني باستخدام عمليات التقييم في وقت التشغيل. يمكن أن تساعدك هذه المقاييس في رصد مشاكل الجودة أو السلامة في البيانات الواردة من العالم الحقيقي.

مواصلة تطوير عمليات التقييم

يجب أن تنمو التقييمات جنبًا إلى جنب مع تطبيقك. مع تحسُّن أداء نماذجك، عليك تعديل عمليات التقييم القديمة.

أضِف بانتظام أمثلة صعبة إلى مجموعات بيانات الاختبار، مثل حالات استخدام جديدة أو إدخالات مفاجئة من المستخدمين تجدها في مرحلة الإنتاج.

ما هي البيانات التي تقيسها التقييمات؟

قبل تصميم عمليات التقييم، عليك فهم كيفية تقييم الناتج. هناك بعض المصطلحات التي عليك معرفتها.

المعايير هي القواعد، أي السمات التي يجب اختبارها. على سبيل المثال، ملاءمة العلامة التجارية، والمحتوى السام، وإمكانية الوصول.

يتم قياس كل معيار تقييم بمقياس. المقياس هو نتيجة واحدة ومحدّدة تقيس مخرجات النموذج مقارنةً بالمعيار. يمكن أن تكون هذه النتيجة ثنائية أو قيمة ضمن نطاق يقيس مدى تطابق الناتج مع توقعات المقيم.

من الممكن قياس المعيار نفسه باستخدام أنواع مختلفة من المقاييس. على سبيل المثال، بالنسبة إلى التوافق مع العلامة التجارية:

- "هل هذا الشعار مناسب للعلامة التجارية؟" المقياس هو

PASSأوFAIL. - "على مقياس من 1 إلى 5، ما مدى توافق الشعار مع العلامة التجارية؟" المقياس هو عدد صحيح بين واحد وخمسة.

المقيّم هو الرمز أو النموذج الذي يسجّل المعيار. يحدّد المقيمون المقاييس.