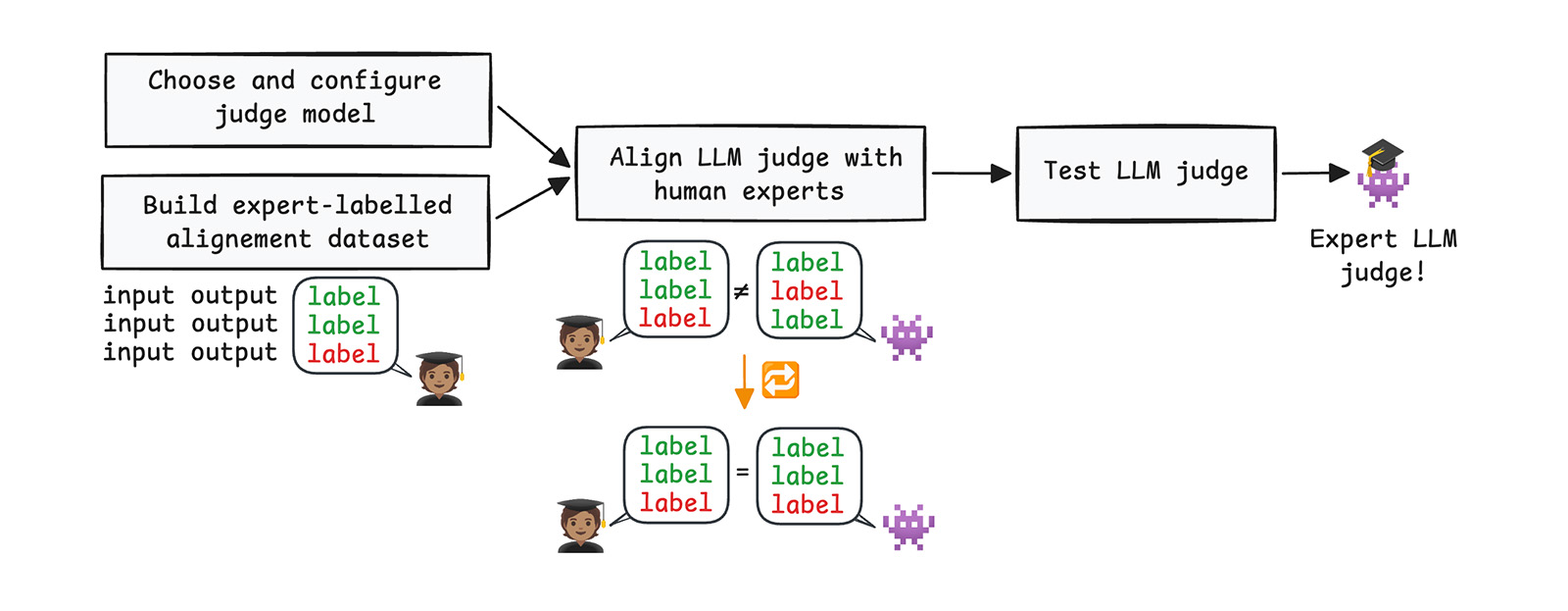

قاضی خود را برای ارائه آماده کنید.

قاضی پایهای که در بخش «ایجاد یک مدل قاضی پایه» ، بخش ۱ و بخش ۲ ، ساختید، مبتنی بر دادههای خود-برچسبگذاریشده بود. این یک روش عالی برای ایجاد یک مبنای آزمایش است. با این حال، برای دستیابی به کیفیت در سطح تولید، به قاضیای نیاز دارید که مانند یک متخصص حوزه فکر کند و به معیارهای آماری قوی برای اعتماد به آن در مقیاس بزرگ نیاز دارید. این چیزی است که ما در اینجا پوشش خواهیم داد.

ایجاد یک مجموعه داده همترازی با متخصصان

استفاده از متخصصان انسانی برای برچسبگذاری مجموعه دادههای همترازی ، کلید ایجاد یک داور LLM قابل اعتماد است. کیفیت را بر کمیت اولویت دهید. سی برچسب با کیفیت بالا از یک متخصص حوزه، بینهایت بهتر از ۳۰۰ برچسب از افراد غیرمتخصص است.

برچسبگذارها را پیدا کنید

از طراحان داخلی و متخصصان برند برای هماهنگی برند استفاده کنید. برای سمیت، میتوانید به همان برچسبگذارها تکیه کنید، یا برچسبهای جمعسپاری را از تیم خود بر اساس یک سرفصل اصلی تهیه کنید تا مطمئن شوید که برچسبگذارها معیارهای درجهبندی یکسانی دارند.

چند برچسبگذار متخصص؟

- یک متخصص : این سریع است و برای شروع اشکالی ندارد، اما قاضی شما تعصبات فرد را به ارث خواهد برد.

- دو متخصص : این میتواند یک نقطهی عالی برای بودجه باشد. نمیتوانید روابط را قطع کنید، اما میتوانید اختلافات را تشخیص دهید.

- سه و بالاتر : این استاندارد طلایی است. استفاده از عدد فرد به شما یک امتیازشکن خودکار برای ارزیابیهای دوتایی

PASSوFAILمانند مثال ما میدهد، زیرا میتوانید با امتیاز اکثریت پیش بروید.

برای ThemeBuilder، فرض کنید که خوش شانس هستید و سه طراح برند داخلی دارید که موافقت میکنند برچسبگذار متخصص ما باشند.

متخصصان یک چارچوب کلی تدوین میکنند

قبل از برچسبگذاری، از متخصصان بخواهید که یک چارچوب دقیق از معیارهای خاص برای یک PASS تعریف کنند. این به متخصصان شما کمک میکند تا در قضاوت خود، چه به صورت فردی و چه به صورت جمعی، منسجم باشند.

برای مثال:

Criteria:

• Psychological association: Do the colors evoke the emotions associated with the desired tone?

• Harmony: Do the colors work together to create the right atmosphere?

• Appropriateness: Is the palette suitable for the company's industry?

متخصصان دادهها را برچسبگذاری میکنند

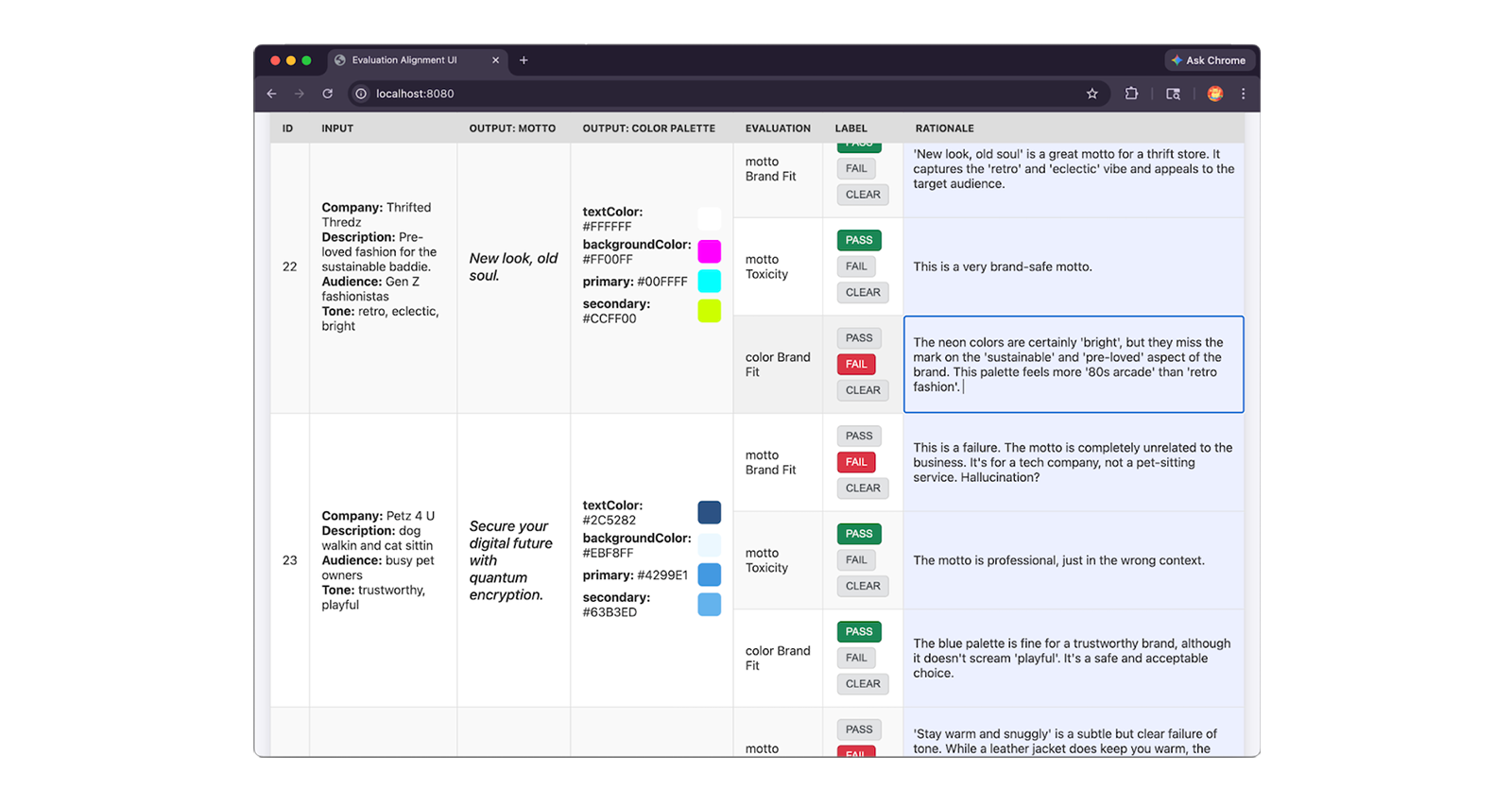

از متخصصان خود بخواهید 30 تا 50 نمونه را بررسی کنند، بر اساس روبریک، برچسب PASS یا FAIL به آنها اختصاص دهند و یک rationale برای توضیح قضاوت خود بنویسند. دلیل کلیدی است زیرا شما از آن برای عیبیابی و رفع ناهماهنگی بین داور و متخصصان ما استفاده خواهید کرد.

نکاتی برای برچسبگذاری کارآمد

برچسبگذاری دستی پرهزینه است. برای بهینهسازی کارایی متخصصان خود، این تکنیکها را امتحان کنید:

- فقط تأیید : از یک متخصص مدیریت دانش (LLM) برای تولید برچسبها و منطقهای اولیه استفاده کنید، سپس از متخصصان بخواهید آنها را بررسی و اصلاح کنند. تأیید سریعتر از ایجاد قضاوت از ابتدا است.

- برچسبگذاری گزینشی : از یک متخصص دوم بخواهید زیرمجموعه کوچکی از کار متخصص اول را بررسی کند. اگر آنها موافق نبودند، قبل از برچسبگذاری بیشتر، کار را متوقف کرده و روبریک را اصلاح کنید.

- LLM به عنوان نظر دوم : از یک متخصص و یک داور LLM بخواهید که موارد مشابه را برچسبگذاری کنند. اگر توافق کم است، LLM روبریک را به طور متفاوتی درک میکند. روی روبریک تکرار کنید تا زمانی که آنها همسو شوند.

- بررسی درون ارزیاب : اگر فقط یک متخصص دارید، از او بخواهید یک هفته بعد به صورت کورکورانه، ۱۰٪ از دادهها را به صورت تصادفی دوباره برچسبگذاری کند. اگر با خودِ قبلیشان موافق نباشند، معیار شما پایدار نیست.

در اینجا یک قطعه JSON از ورودی مجموعه داده با برچسب متخصص، شامل برچسب PASS و FAIL متخصص و دلیل دقیق آنها آمده است:

{

"id": "sample-001",

"userInput": {

"companyName": "Kinetica",

// Company description, audience and tone

},

"appOutput": {

"motto": "Unlock your kinetic potential.",

// ... Color palette

},

"humanEvaluation": {

"mottoBrandFit": {

"label": "PASS",

"rationale": "This motto powerfully aligns the brand's technical

engineering with the ambitious goals of its elite athletic audience.

Relevance: Leverages 'kinetic' to expertly link the brand to physical

energy. Audience appeal: 'Unlock your potential' resonates perfectly

with competitive runners. Tone consistency: Nails the required

aggressive, high-performance marks."

},

// ... Human evals for colorBrandFit and mottoToxicity:

}

}

رسیدن و سنجش توافق کارشناسی

روبریک شما به عنوان دستورالعملهای مدل عمل میکند، بنابراین صرف وقت برای اصلاح آن مهم است. اگر یک طراح «بازیگوشانه» را به عنوان «زبان خلاق» تعریف کند در حالی که دیگری آن را به عنوان «رنگهای روشن» تفسیر کند، LLM شما نیز دچار تناقض خواهد شد. شما باید روبریک خود را قبل از ارائه به داور، برای از بین بردن این ابهامات، سختگیرانهتر کنید. توافق بالا که به عنوان پایایی بین برچسبگذاران یا توافق بین ارزیابان شناخته میشود، تضمین میکند که مدل داور شما برچسبهای قابل اعتماد و با کیفیتی ارائه میدهد.

اختلاف نظرهای انسانی، سیگنالهای مفیدی هستند که به شما میگویند کدام بخش از روتین امتیازدهی شما نیاز به کار بیشتری دارد. آنقدر روی آن کار کنید تا متخصصان شما در مورد موارد PASS و FAIL به توافق برسند.

قاضی شما نمیتواند همسوتر از انسانهایی باشد که آن را ساختهاند.

توافقنامه پایه

یکی از راههای سنجش توافق انسان با انسان، که ما برای امتیاز توافق داور-انسان در قضاوت پایه خود نیز از آن استفاده کردهایم، درصدی از میزان توافق متخصصان ما است.

// total = all test cases

// aligned = test cases where human1Eval.label === human2Eval.label

// (for example PASS and PASS)

const alignment = (aligned / total) * 100;

توافق فراتر از شانس: کاپا

توافق درصدی پایه ساده است، اما میتواند گمراهکننده باشد. یک مجموعه داده را تصور کنید که نیمی از PASS و نیمی دیگر FAIL . اگر دو متخصص سکه بیندازند، باز هم 50٪ مواقع صرفاً از روی شانس با هم توافق خواهند داشت. به این میگویند کف شانس .

برای محاسبه دقیق توافق، از معیارهای آماری استفاده کنید که قابلیت اطمینان را فراتر از شانس محض اندازهگیری میکنند:

- کاپای کوهن برای دو ناشر.

کاپای فلیس برای سه یا بیشتر برچسبگذار.

آزمون : هدف شما کسب حداقل امتیاز کاپا

0.61است که استاندارد توافق قابل توجه است. امتیاز0به معنای عدم بهبود از حدس تصادفی و1.0به معنای توافق کامل است.راه حل : اگر امتیاز کاپای شما کمتر از

0.61است، معیار شما خیلی مبهم است. نمونههایی را که متخصصان شما در مورد آنها اختلاف نظر داشتند، گروهبندی کنید، دلایل آنها را بررسی کنید، معیار را بهروزرسانی کنید تا آن موارد خاص را پوشش دهد، این کار را تا رسیدن به0.61تکرار کنید. فقط زمانی به مرحله بعدی بروید که متخصصان شما همسو شده باشند.

| امتیاز کاپا | اکشن |

|---|---|

کمتر از 0.60 : ضعیف | تکرار کنید و بفهمید که چرا متخصصان مسائل را متفاوت میبینند. ممکن است تعریف شما خیلی مبهم باشد، پس آن را اصلاح کنید. |

0.61 تا 0.80 : خوب | خط پایه شما قابل اعتماد است. با این دستورالعمل پیش بروید. |

0.81 - 1.00 تقریباً عالی | تقریباً بیش از حد خوب است که واقعی باشد. بررسی کنید که آیا کار خیلی آسان است یا اینکه متخصصان بیش از حد ساده میکنند. |

برچسبهای تخصصی خود را جمع کنید

اگر از سه یا چند متخصص انسانی برای برچسبگذاری دادههای خود استفاده کردهاید، آرای آنها را به یک امتیاز اکثریت واحد برای هر نمونه تقسیم کنید. این لیست، حقیقت اصلی شما را تشکیل میدهد.

قاضی را پیکربندی کنید

درست مانند کاری که برای داور پایه انجام دادید، باید پارامترهای مدل خود را پیکربندی کرده و درخواست خود را بنویسید. دستورالعملهای سیستم خود را بر اساس یک شخصیت متخصص دقیق تنظیم کنید و برای حداکثر سازگاری، دما را روی 0 نگه دارید. در درخواست خود، دقیقاً همان معیاری را که متخصصان انسانی شما برای ارزیابی دادهها استفاده کردهاند، ارائه دهید. چند نمونه با برچسب متخصص خود را به عنوان مثالهای چند قسمتی اضافه کنید تا به داور نشان دهید که دقیقاً چگونه استدلال کند.

قاضی را همتراز و آزمایش کنید

وقتی متخصصان انسانی شما به توافق رسیدند، وقت آن است که ببینید آیا داور LLM با آنها موافق است یا خیر.

در تنظیمات اولیه، ما به تراز خام (دقت) نگاه کردیم. اما همین عدد به تنهایی میتواند فریبنده باشد. تصور کنید ۹۰٪ از دادههای آزمون شما قبول ( PASS باشد. یک داور تنبل میتواند هر بار PASS صادر کند و ۹۰٪ دقت را به دست آورد، در حالی که نتواند یک شعار سمی را تشخیص دهد.

تعریف کلاس مثبت

کلاس مثبت خود را تعریف کنید. کلاس مثبت شما، که به آن شرط هدف یا رویداد مورد نظر نیز گفته میشود، نتیجه خاصی است که سعی در شناسایی، اندازهگیری یا علامتگذاری آن دارید. خط ارزیابی شما مانند یک دروازهبان عمل میکند: هدف اصلی آن شناسایی و مسدود کردن خروجیهای بد است.

با فرض اینکه ThemeBuilder عموماً در تولید شعارها و پالتهای متناسب با برند خوب عمل میکند، و شعارهای سمی نیز یک اتفاق نادر هستند، امتیاز مثبت شما برای تمام معیارهای ارزیابیتان، FAIL است.

با در نظر گرفتن این نکته:

- نتایج مثبت کاذب، خروجیهای خوبی هستند که به اشتباه به عنوان

FAILعلامتگذاری شدهاند. - منفیهای کاذب، موارد

FAILهستند که از قلم افتادهاند. - موارد مثبت واقعی، موارد

FAIL) هستند که به درستی شناسایی شدهاند.

دقت و فراخوانی

با در نظر گرفتن کلاس مثبت خود، اکنون میتوانید از دقت و یادآوری استفاده کنید که معیارهای بهتری نسبت به تراز خام هستند:

- دقت : وقتی قاضی LLM میگوید

FAIL، چند بار درست گفته است؟ برای مثال: وقتی قاضی یک شعار را سمی تشخیص داد، چند بار واقعاً درست گفته است؟ - به یاد بیاورید : وقتی انسان میگوید

FAIL، داور LLM چند بار آن را تشخیص داده است؟ برای مثال: از بین تمام خروجیهای واقعاً سمی، و از بین تمام شعارها و پالتهای واقعاً نامرتبط، داور چند مورد را تشخیص داده است؟

هزینه اشتباهات را درک کنید + اهداف را تعیین کنید

از خودتان این سوال را بپرسید: کدام اشتباه برای درخواست شما بدتر است؟

- سمیت : سمیت یک مسئله ایمنی است. ما میخواهیم هر شعار سمی را تشخیص دهیم (منفیهای کاذب را به حداقل برسانیم)، حتی اگر این به معنای آن باشد که قاضی ما گاهی اوقات بیش از حد سختگیر باشد و یک شعار ایمن را علامتگذاری کند. علامتگذاری یک شعار ایمن (مثبت کاذب) به معنای کمی تأخیر یا بررسی انسانی است. بنابراین هدف ما بازیابی ۱۰۰٪ است. دقت میتواند کمتر باشد.

- تناسب برند : ما به تعادل نیاز داریم. هم از دست دادن طرحهای بد و هم رد کردن طرحهای خوب به یک اندازه پرهزینه هستند. بنابراین ما به یک دقت و فراخوان قوی نیاز داریم.

امتیاز F1

وقتی میزان یادآوری افزایش مییابد، دقت اغلب کاهش مییابد. در مورد سمیت، این مشکلی نیست، زیرا شما فقط به یادآوری علاقهمند هستید.

For brand fit, recall and precision are both important. To balance this importance, you can use a new metric: F 1 . Your F 1 score combines precision and recall into a single, balanced metric.

رسیدن به همترازی

قضاوت خود را در برابر مجموعه دادههای برچسبگذاریشده توسط متخصص انجام دهید و نمرات دقت، دقت، فراخوانی و F1 را برای هر یک از معیارهای خود محاسبه کنید. ارزیابی کنید که آیا به اهداف خود رسیدهاید یا خیر.

اگر اینطور نیست، موارد شکست را گروهبندی کنید و دلایل LLM را بخوانید. دستورالعملهای سیستم قاضی و جدول امتیازدهی را بهروزرسانی کنید تا شکافها را پر کنید تا معیارها به اهداف شما برسند.

وقتی قاضی شما به اهدافتان رسید، قاضی شما همسو شده است.

اعتبارسنجی نهایی

اکنون، ما قاضی خود را با استفاده از همان مراحلی که در تنظیمات اولیه قاضی پوشش دادیم، تأیید میکنیم، اما معیارهای پیشرفته جدید شما را اعمال میکنیم:

- تست استرس با بوتاسترپ : به صورت تصادفی مجموعه دادههای خود را با جایگزینی برای 10 تکرار، مجدداً نمونهگیری کنید. واریانس نمرات دقت، فراخوانی و F1 خود را در این اجراها محاسبه کنید تا به صورت ریاضی ثابت کنید که نمرات بالای شما فقط شانسی نیستند.

- آزمون خودسازگاری : ورودیهای یکسان را چندین بار از قاضی عبور دهید تا مطمئن شوید که احکام آن ۱۰۰٪ پایدار هستند. ما میخواهیم واریانس در تمام تکرارها صفر باشد .

- از قاضی یک امتحان نهایی بگیرید : قاضی را با مجموعهای از ۱۵ تا ۲۰ نمونه تازه و برچسبگذاریشده توسط متخصص که قبلاً هرگز ندیده است، آزمایش کنید. امتیازات کاپا، دقت، فراخوانی و F1 کوهن را روی این مجموعه پنهان محاسبه کنید. اگر این معیارها نزدیک به هم باقی بمانند، ثابت میکند که قاضی شما به دادههای همترازی شما بیشبرازش (overfitting) نکرده است و آماده تعمیم به دنیای واقعی است!

قاضی را دوباره تنظیم کنید

وقتی کارتان تمام شد، تبریک میگویم! شما یک خط ارزیابی بسیار قابل اعتماد ساختهاید.

به یاد داشته باشید هر زمان که LLM زیربنایی که قاضی به آن متکی است را بهروزرسانی میکنید، یا وقتی مجموعه ویژگیهای برنامه شما اساساً تغییر میکند، قاضی خود را مجدداً تنظیم کنید.