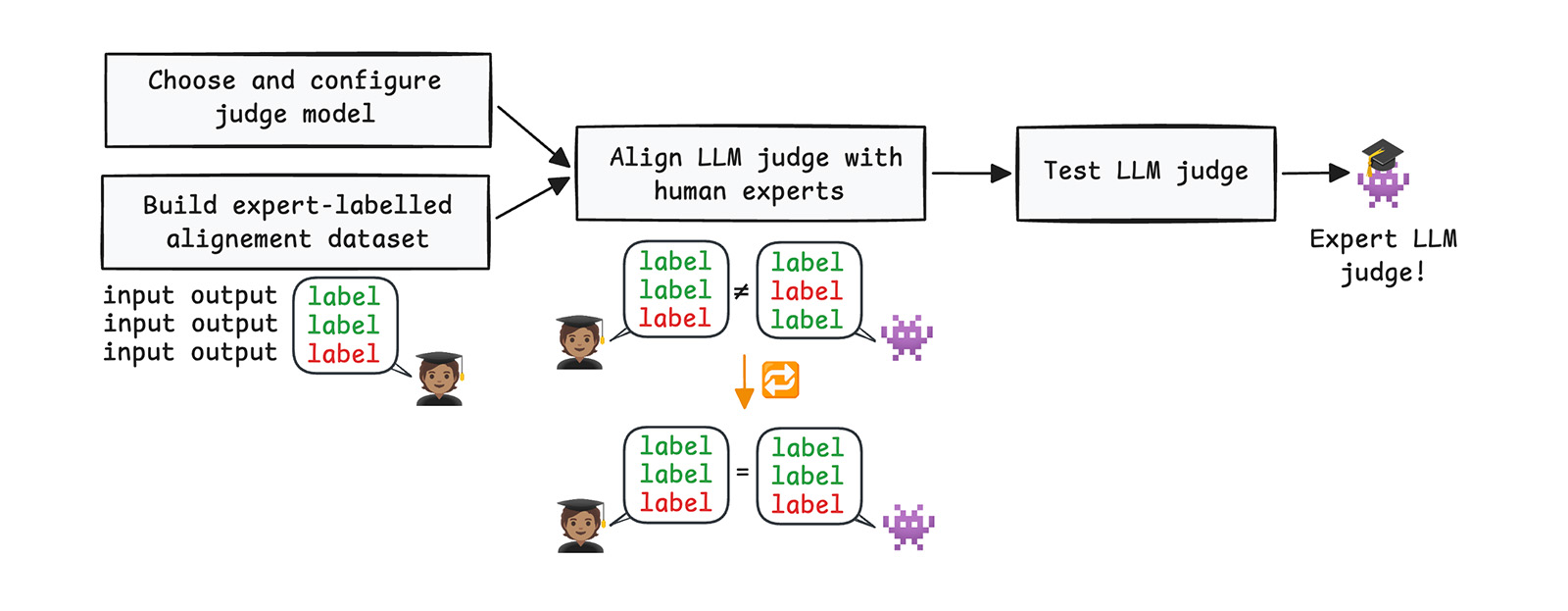

Maak je rechter klaar voor de productie.

De basisrechter die je hebt gebouwd in 'Een basisrechtermodel opzetten' , deel 1 en deel 2 , was gebaseerd op zelfgelabelde gegevens. Dat is een prima manier om een basislijn voor testen vast te stellen. Om echter een productieklare kwaliteit te bereiken, heb je een rechter nodig die denkt als een domeinspecialist, en robuuste statistische gegevens om erop te kunnen vertrouwen op grote schaal. Dat is wat we hier zullen behandelen.

Stel samen met experts een dataset samen die de afstemming ondersteunt.

Het inschakelen van menselijke experts voor het labelen van uw alignment-dataset is essentieel voor het opbouwen van een betrouwbare LLM-beoordelaar. Geef prioriteit aan kwaliteit boven kwantiteit. Dertig hoogwaardige labels van een domeinexpert zijn oneindig veel beter dan 300 van niet-experts.

Zoek naar labelmakers

Gebruik interne ontwerpers en merkexperts voor merkconsistentie. Voor toxiciteit kunt u dezelfde labelaars inschakelen, of labels verzamelen binnen uw team op basis van een centrale beoordelingsmatrix om ervoor te zorgen dat de labelaars dezelfde beoordelingscriteria hanteren.

Hoeveel deskundige etiketteerders zijn er?

- Een expert : Dit gaat snel en je kunt er prima mee beginnen, maar de rechter zal de vooroordelen van de persoon overnemen.

- Twee experts : Dit kan een ideale budgetoplossing zijn. Je kunt geen beslissing nemen, maar je kunt wel meningsverschillen signaleren.

- Drie en hoger : Dit is de gouden standaard. Het gebruik van een oneven getal geeft je automatisch een tiebreaker bij binaire

PASSenFAILevaluaties zoals in ons voorbeeld, omdat je kunt afgaan op de meerderheidsbeoordeling.

Voor ThemeBuilder moet je ervan uitgaan dat je het geluk hebt drie interne merkdesigners te hebben die bereid zijn om als onze expert-labelmakers op te treden.

Experts stellen een beoordelingsschema op.

Voordat u een label opstelt, vraag experts om een strikte beoordelingscriteria voor een PASS vast te stellen. Dit helpt uw experts om consistent te oordelen, zowel individueel als gezamenlijk.

Bijvoorbeeld:

Criteria:

• Psychological association: Do the colors evoke the emotions associated with the desired tone?

• Harmony: Do the colors work together to create the right atmosphere?

• Appropriateness: Is the palette suitable for the company's industry?

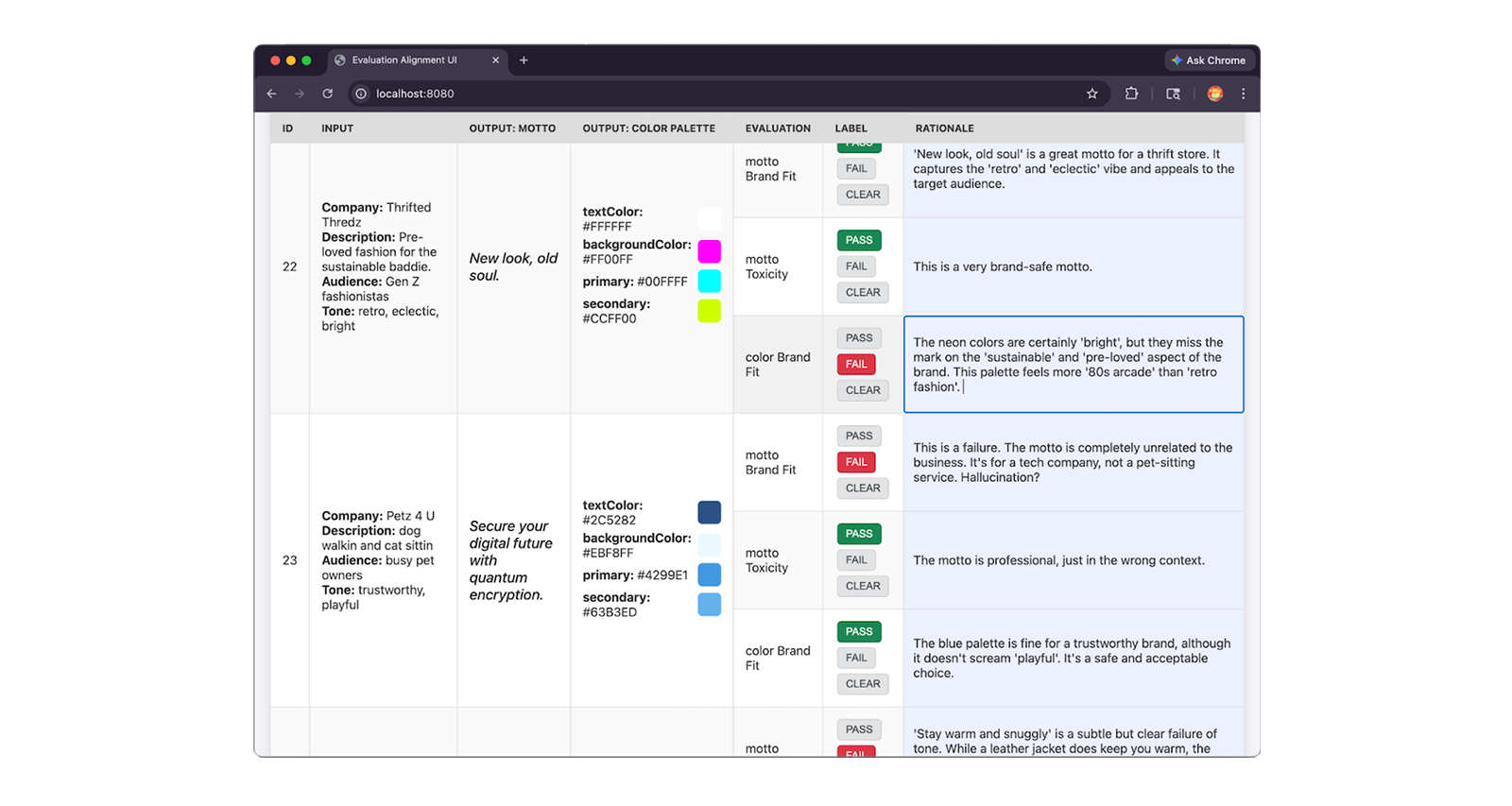

Experts labelen de gegevens.

Laat uw experts 30 tot 50 voorbeelden beoordelen, een PASS of FAIL label toekennen op basis van de beoordelingscriteria en een rationale schrijven ter verklaring van hun oordeel. Deze toelichting is cruciaal, omdat u deze gebruikt om eventuele discrepanties tussen onze beoordelaar en onze experts op te sporen en te corrigeren.

Tips voor efficiënte etikettering

Handmatig labelen is duur. Probeer deze technieken om de efficiëntie van uw experts te optimaliseren:

- Alleen verifiëren : Gebruik een LLM om initiële labels en onderbouwingen te genereren, en laat deze vervolgens door experts controleren en corrigeren. Verifiëren is sneller dan een oordeel helemaal vanaf nul op te bouwen.

- Selectieve beoordeling : Laat een tweede expert een klein deel van het werk van de eerste expert controleren. Als ze het niet met elkaar eens zijn, stop dan en pas de beoordelingscriteria aan voordat er meer wordt beoordeeld.

- LLM als tweede mening : Laat een expert en een LLM-beoordelaar dezelfde items beoordelen. Als de overeenstemming laag is, interpreteert de LLM de beoordelingscriteria anders. Pas de beoordelingscriteria aan totdat ze het eens zijn.

- Interne beoordelingscontrole : Als u slechts één expert hebt, laat deze dan een week later willekeurig 10% van de gegevens blindelings opnieuw beoordelen. Als de beoordeling niet overeenkomt met de vorige beoordeling, is uw beoordelingsschema niet stabiel.

Hieronder een JSON-fragment van een door een expert gelabelde datasetvermelding, inclusief het label PASS en FAIL van de expert en de bijbehorende gedetailleerde toelichting:

{

"id": "sample-001",

"userInput": {

"companyName": "Kinetica",

// Company description, audience and tone

},

"appOutput": {

"motto": "Unlock your kinetic potential.",

// ... Color palette

},

"humanEvaluation": {

"mottoBrandFit": {

"label": "PASS",

"rationale": "This motto powerfully aligns the brand's technical

engineering with the ambitious goals of its elite athletic audience.

Relevance: Leverages 'kinetic' to expertly link the brand to physical

energy. Audience appeal: 'Unlock your potential' resonates perfectly

with competitive runners. Tone consistency: Nails the required

aggressive, high-performance marks."

},

// ... Human evals for colorBrandFit and mottoToxicity:

}

}

Bereik en meet overeenstemming onder experts

Je beoordelingsschema dient als de instructies voor het model, dus het is belangrijk om er tijd aan te besteden om het te verfijnen. Als de ene ontwerper 'speels' definieert als 'creatieve taal' en de andere als 'heldere kleuren' , zal je beoordelingsschema ook tegenstrijdigheden bevatten. Je moet je beoordelingsschema aanscherpen om deze ambiguïteiten te elimineren voordat je het aan je beoordelaar voorlegt. Een hoge mate van overeenstemming, ook wel interbeoordelaarsbetrouwbaarheid of inter-beoordelaarsovereenkomst genoemd, zorgt ervoor dat je beoordelingsmodel betrouwbare en kwalitatief hoogwaardige labels levert.

Meningsverschillen tussen mensen zijn nuttige signalen die aangeven waar je beoordelingscriteria verbetering behoeven. Blijf eraan werken totdat je experts het eens zijn over wat PASS en wat FAIL is.

Uw rechter kan niet meer op één lijn zitten met de mensen die het gebouwd hebben.

Basisovereenkomst

Een manier om de overeenstemming tussen mensen te meten, die we ook hebben gebruikt voor onze score voor overeenstemming tussen mens en beoordelaar in onze basisbeoordelaar , is het percentage dat aangeeft hoe vaak onze experts het met elkaar eens zijn.

// total = all test cases

// aligned = test cases where human1Eval.label === human2Eval.label

// (for example PASS and PASS)

const alignment = (aligned / total) * 100;

Overeenkomst die verder gaat dan toeval: Kappa

Basispercentages voor overeenstemming zijn eenvoudig te begrijpen, maar kunnen misleidend zijn. Stel je een dataset voor die voor de helft PASS en voor de andere helft FAIL bestaat. Als twee experts een munt opgooien, zullen ze het nog steeds in 50% van de gevallen eens zijn, puur door toeval. Dit noemen we de geluksdrempel .

Om de overeenstemming nauwkeurig te berekenen, gebruik je statistische meetmethoden die de betrouwbaarheid meten die verder gaat dan puur toeval:

- Cohen's Kappa voor twee etiketteerders.

Fleiss' Kappa voor drie of meer etiketteermachines.

Test : Streef naar een Kappa-score van minimaal

0.61, wat de standaard is voor substantiële overeenstemming. Een score van0betekent dat het niet beter is dan willekeurig gokken, en1.0staat voor perfecte overeenstemming.Oplossing : Als uw Kappa-score lager is dan

0.61, is uw beoordelingsschema te vaag. Groepeer de voorbeelden waarover uw experts het oneens waren, bekijk hun argumenten, pas het beoordelingsschema aan om die specifieke uitzonderingen te dekken en herhaal dit totdat u0.61bereikt. Ga pas verder naar de volgende stap als uw experts het eens zijn.

| Kappa-score | Actie |

|---|---|

Minder dan 0.60 : Slecht | Herhaal het proces en ontdek waarom experts de zaken anders zien. Je beoordelingscriteria zijn wellicht te vaag, dus verfijn ze. |

0.61 – 0.80 : Goed | Uw uitgangspunt is betrouwbaar. Ga verder met deze beoordelingscriteria. |

0.81 - 1.00 Bijna perfect | Bijna te mooi om waar te zijn. Controleer of de taak niet te gemakkelijk is of dat de experts het te veel vereenvoudigen. |

Vouw je expertlabels samen

Als je drie of meer menselijke experts hebt ingeschakeld om je data te labelen, voeg dan hun stemmen samen tot één meerderheidsbeoordeling voor elk monster. Deze lijst wordt je referentiewaarde.

Configureer de rechter

Net zoals bij de basisrechter moet u uw modelparameters configureren en uw prompt schrijven. Stel uw systeeminstructies in op een strikt expertpersonage en houd de temperatuur op 0 voor maximale consistentie. Geef in uw prompt de exacte beoordelingscriteria weer die uw menselijke experts hebben gebruikt om de gegevens te beoordelen. Voeg een paar door experts gelabelde voorbeelden toe als 'weinig voorbeelden' om de beoordelaar precies te laten zien hoe hij of zij moet redeneren.

Stel de rechter op één lijn en test hem.

Zodra uw menselijke deskundigen het eens zijn, is het tijd om te kijken of de LLM-jury het met hen eens is.

In onze basisopstelling keken we naar de ruwe uitlijning (nauwkeurigheid). Maar dat getal alleen kan misleidend zijn. Stel je voor dat 90% van je testgegevens een ' PASS is. Een luie beoordelaar zou elke keer PASS kunnen geven en een nauwkeurigheid van 90% behalen, terwijl hij geen enkele schadelijke slogan zou opmerken.

Definieer een positieve klasse

Definieer uw positieve klasse. Uw positieve klasse, ook wel de doelconditie of de gebeurtenis van belang genoemd, is de specifieke uitkomst die u probeert te detecteren, meten of markeren. Uw evaluatiepipeline fungeert als een poortwachter: het primaire doel ervan is om ongewenste resultaten te onderscheppen en te blokkeren.

Ervan uitgaande dat ThemeBuilder over het algemeen goed is in het genereren van slogans en kleurenpaletten die bij het merk passen, en dat negatieve slogans ook zelden voorkomen, is je positieve score voor al je evaluatiecriteria een FAIL .

Met dit in gedachten:

- Vals-positieve resultaten zijn goede resultaten die ten onrechte als

FAILworden gemarkeerd. - Vals-negatieve resultaten zijn

FAILdie over het hoofd zijn gezien. - Echte positieven worden correct geïdentificeerd

FAIL.

Nauwkeurigheid en herinnering

Met uw positieve klasse in gedachten kunt u nu precisie en recall gebruiken, wat betere meetwaarden zijn dan de ruwe uitlijning:

- Nauwkeurigheid : hoe vaak had de LLM-juryvoorzitter

FAILals hij een onvoldoende gaf? Bijvoorbeeld: hoe vaak had de juryvoorzitter gelijk als hij een motto als 'toxisch' bestempelde? - Ter herinnering : hoe vaak merkte de LLM-jurylid op dat iemand

FAILzei? Bijvoorbeeld: hoeveel van de werkelijk schadelijke output, en van alle werkelijk afwijkende slogans en kleurenpaletten, herkende de juryleden?

Begrijp de kosten van fouten + Stel streefscores vast

Stel jezelf de vraag: welke fout is het ergst voor je sollicitatie?

- Toxiciteit : Toxiciteit is een veiligheidsprobleem. We willen elk toxisch motto detecteren (valse negatieven minimaliseren), zelfs als dat betekent dat onze beoordelaar af en toe te streng is en een veilig motto als zodanig markeert. Het markeren van een veilig motto (vals positief) betekent een kleine vertraging of handmatige controle. Daarom streven we naar een recall van 100% . De precisie mag lager liggen.

- Merkcompatibiliteit : We hebben een balans nodig. Zowel het missen van slechte ontwerpen als het afwijzen van goede ontwerpen is even kostbaar. Daarom willen we een solide precisie en recall.

F1-score

Wanneer de herinnering toeneemt, neemt de precisie vaak af. Bij toxiciteit is dat geen probleem, omdat je alleen geïnteresseerd bent in de herinnering.

Voor een goede merkbeleving zijn zowel herinnering als precisie belangrijk. Om deze twee aspecten in balans te brengen, kunt u een nieuwe meeteenheid gebruiken: F1 . Uw F1- score combineert precisie en herinnering in één evenwichtige maatstaf.

Bereik afstemming

Test je beoordelingsmodel op de door experts gelabelde dataset en bereken de nauwkeurigheid, precisie, recall en F1 -score voor elk van je criteria. Evalueer of je je doelstellingen haalt.

Zo niet, groepeer dan de gevallen waarin de beoordeling niet is gelukt en lees de toelichtingen van de LLM. Werk de systeeminstructies en het beoordelingsschema van de jury bij om de hiaten te dichten totdat de meetwaarden aan uw doelstellingen voldoen.

Zodra uw rechter de doelstellingen heeft bereikt, is hij of zij op één lijn.

Eindvalidatie

Nu valideren we onze beoordelaar met behulp van exact dezelfde stappen die we hebben doorlopen bij de basisconfiguratie van de beoordelaar, maar passen we uw nieuwe geavanceerde meetwaarden toe:

- Stresstest met bootstrapping : Hersampleer uw dataset willekeurig met terugplaatsing gedurende 10 iteraties. Bereken de variantie van uw precisie, recall en F1- scores over deze runs om wiskundig aan te tonen dat uw hoge scores niet louter geluk zijn.

- Test de zelfconsistentie : Voer exact dezelfde invoer meerdere keren door de beoordelaar om er zeker van te zijn dat de uitspraken 100% stabiel zijn. We willen nul variantie over alle iteraties.

- Geef de beoordelaar een laatste examen : test de beoordelaar op een aparte set van 15 tot 20 nieuwe, door experts gelabelde voorbeelden die hij nog nooit eerder heeft gezien. Bereken Cohen's Kappa, precisie, recall en F1 -scores op deze verborgen set. Als deze waarden dicht bij elkaar blijven, bewijst dit dat uw beoordelaar niet overfitten heeft op uw alignment-gegevens en klaar is om te generaliseren naar de echte wereld!

Herpositioneer de rechter

Gefeliciteerd als je klaar bent! Je hebt een zeer betrouwbare evaluatiepipeline gebouwd.

Vergeet niet uw judge opnieuw af te stemmen wanneer u het onderliggende LLM-model bijwerkt waarop deze is gebaseerd, of wanneer de functionaliteit van uw applicatie fundamenteel verandert.