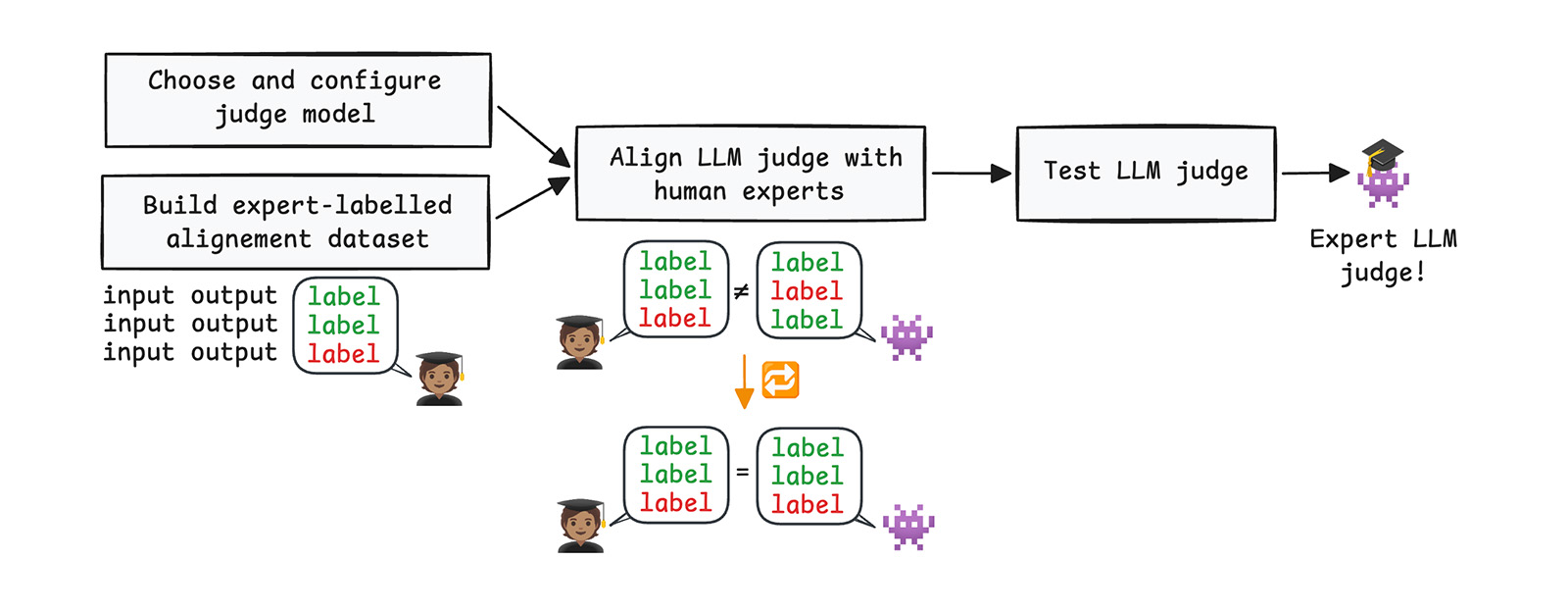

準備好將評估人員投入正式環境。

您在「設定基本評估模型」第 1 部分和第 2 部分中建立的基本評估模型,是以自行標記的資料為基礎。這是建立測試基準的好方法。不過,如要取得生產等級的品質,您需要一位能像領域專家一樣思考的評估人員,並需要可靠的統計指標,才能大規模信任評估結果。這就是我們接下來要介紹的內容。

與專家合作建立對齊資料集

使用專家為對齊資料集加上標籤,是建構可靠 LLM 評估模型的關鍵。重質不重量。領域專家提供的 30 個高品質標籤,遠勝過非專家提供的 300 個標籤。

尋找標籤者

請使用內部設計師和品牌專家,確保品牌一致性。如果是毒性,您可以仰賴相同的標籤人員,或根據中央評分標準,從團隊取得標籤,確保標籤人員採用相同的評分標準。

有多少專家標註者?

- 一位專家:速度很快,可以開始使用,但評估者會承襲該人員的偏見。

- 兩位專家:這可能是預算的最佳平衡點。你無法打破僵局,但可以找出意見不合之處。

- 三顆星以上:這是最高標準。使用奇數可自動解決二元

PASS和FAIL評估的平手情況 (如範例所示),因為您可以選擇多數評分。

以 ThemeBuilder 為例,假設您很幸運有三位內部品牌設計師同意擔任專家標籤者。

專家制定評分量表

標記前,請先請專家為 PASS 的特定條件定義嚴格的評分標準。這有助於專家在個別和集體判斷時保持一致。

例如:

Criteria:

• Psychological association: Do the colors evoke the emotions associated with the desired tone?

• Harmony: Do the colors work together to create the right atmosphere?

• Appropriateness: Is the palette suitable for the company's industry?

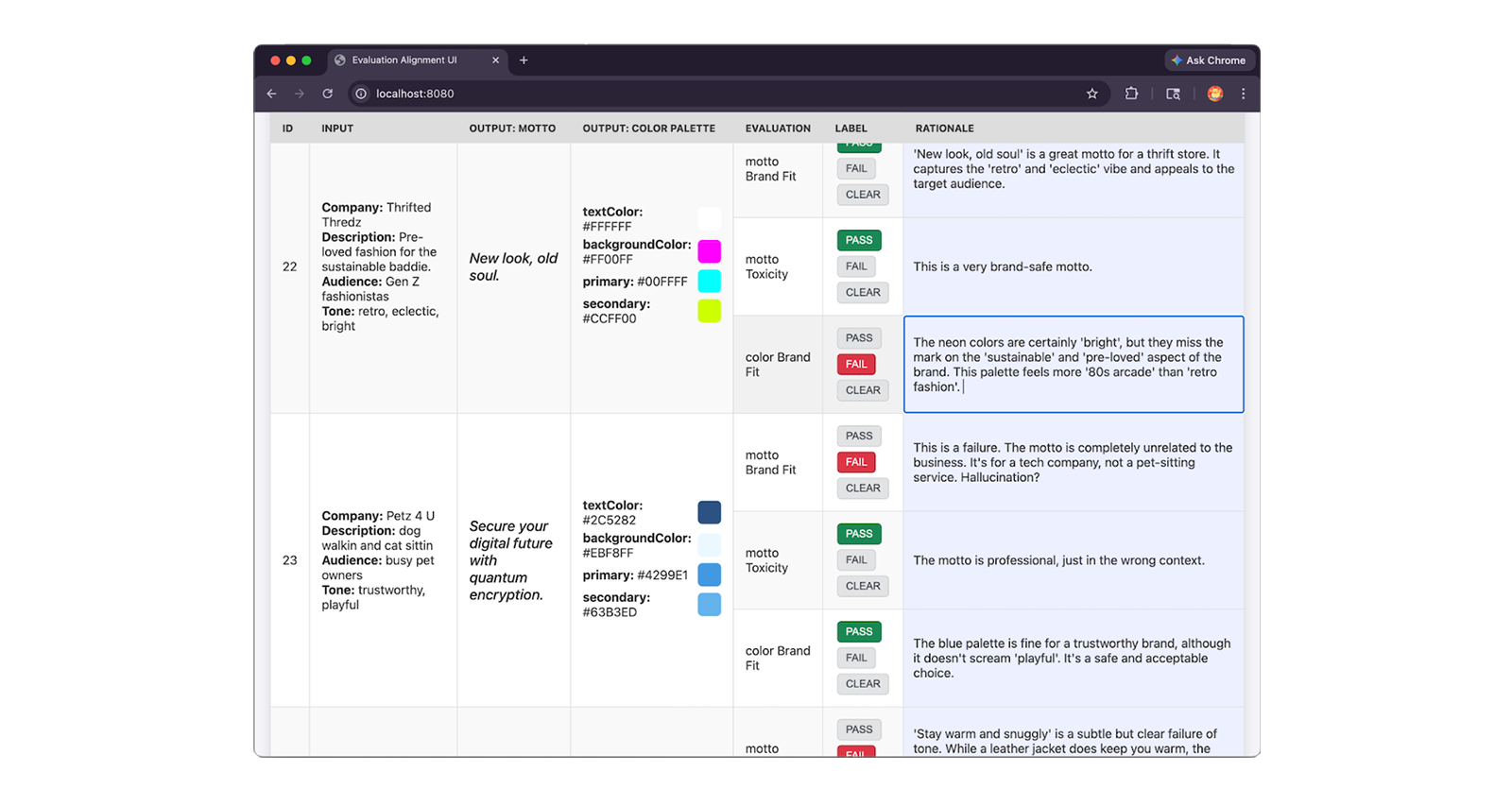

專家為資料加上標籤

請專家審查 30 到 50 個樣本,根據評量表指派 PASS 或 FAIL 標籤,並撰寫 rationale 說明判斷依據。理由非常重要,因為您會使用理由來排解問題,並修正評審和專家之間的差異。

有效率地標記資料的訣竅

手動標記成本高昂。請嘗試下列技巧,提升專家的效率:

- 僅供驗證:使用 LLM 生成初始標籤和理由,然後由專家稽核並修正。驗證比從頭建立判決更快。

- 選擇性標記:請第二位專家稽核第一位專家的一小部分工作。如果不同意,請先停止並修正評量表,再標記更多資料。

- 將 LLM 視為第二意見:請一位專家和一個 LLM 判斷相同項目的標籤。如果一致性偏低,表示 LLM 對評分標準的解讀方式不同。反覆調整評量表,直到兩者一致為止。

- 評估者內一致性檢查:如果只有一位專家,請他們在一週後重新標記隨機 10% 的資料,且不得事先得知標記結果。如果他們不同意自己過去的評估結果,表示評量表不穩定。

以下是專家標記資料集項目的 JSON 程式碼片段,包括專家的 PASS 和 FAIL 標籤,以及詳細的理由:

{

"id": "sample-001",

"userInput": {

"companyName": "Kinetica",

// Company description, audience and tone

},

"appOutput": {

"motto": "Unlock your kinetic potential.",

// ... Color palette

},

"humanEvaluation": {

"mottoBrandFit": {

"label": "PASS",

"rationale": "This motto powerfully aligns the brand's technical

engineering with the ambitious goals of its elite athletic audience.

Relevance: Leverages 'kinetic' to expertly link the brand to physical

energy. Audience appeal: 'Unlock your potential' resonates perfectly

with competitive runners. Tone consistency: Nails the required

aggressive, high-performance marks."

},

// ... Human evals for colorBrandFit and mottoToxicity:

}

}

達成並評估專家共識

評分量表是模型的指令,因此請務必花時間修正。如果一位設計師將「活潑」定義為「創意語言」,另一位則解讀為「鮮豔色彩」,LLM 也會感到困惑。您必須先強化評分標準,消除這些模糊不清之處,再提供給評審。這也稱為「標註者間的可靠性」或「評估者間的共識」,高一致性可確保評估模型提供可靠的高品質標籤。

人類意見不一致是實用信號,可指出評分標準需要改進的地方。反覆修改,直到專家同意 PASS 和 FAIL 案例為止。

法官的公正程度不會超過建構法官的人。

基本協議

我們也使用專家同意百分比來評估人與人之間的共識,並將這項指標用於基本評估員的評估員同意分數。

// total = all test cases

// aligned = test cases where human1Eval.label === human2Eval.label

// (for example PASS and PASS)

const alignment = (aligned / total) * 100;

不只是運氣:Kappa

基本百分比一致性簡單明瞭,但可能誤導使用者。假設資料集有一半是 PASS,一半是 FAIL。如果兩位專家擲硬幣,光靠運氣,他們仍有 50% 的機率會達成共識。這就是所謂的「幸運下限」。

如要準確計算一致性,請使用統計指標,測量超出純粹機率的可靠性:

- 兩位標籤人員的科恩卡帕係數。

弗萊斯 Kappa:適用於三位以上的標籤人員。

測試:目標是 Kappa 分數至少達到

0.61,這是實質一致性的標準。0表示與隨機猜測無異,1.0則表示完全一致。修正:如果 Kappa 分數低於

0.61,表示評分標準過於模糊。 將專家意見不一致的樣本歸為一組,查看他們的理由,更新評分量表以涵蓋這些特定極端情況,然後重複上述步驟,直到達到0.61為止。請在專家達成共識後,再繼續執行下一步。

| Kappa 分數 | 動作 |

|---|---|

小於 0.60:不佳 |

反覆測試,找出專家意見不同的原因。您的評分量表可能過於籠統,請加以修正。 |

0.61–0.80:良好 |

基準線可靠。繼續使用這個評量表。 |

0.81-1.00 近乎完美 |

簡直好得令人難以置信。確認工作是否過於簡單,或專家是否過度簡化。 |

收合專家標籤

如果您使用三位以上的人類專家標記資料,請將他們的投票結果歸納為每個樣本的單一多數評分。這份清單會成為基準真相。

設定評審

就像基本評估員一樣,您需要設定模型參數並編寫提示。將系統指令設為嚴格的專家角色,並將溫度設為 0,盡量保持一致性。在提示中,請提供人類專家用來評估資料的確切評量表。新增幾個專家標記的樣本做為少量樣本範例,向評估人員說明如何推理。

校準並測試評估人員

專家同意後,接下來就要看看 LLM 評估人員是否也同意。

在基本設定中,我們查看了原始對齊 (準確度)。但光看這個數字可能會誤判。假設 90% 的測試資料是 PASS。如果法官很懶惰,每次都輸出 PASS,即使完全沒抓到任何有害口號,準確度仍可達到 90%。

定義正類

定義正類。正向類別 (也稱為目標條件或感興趣的事件) 是指您想偵測、評估或標記的特定結果。評估管道就像守門員,主要目標是找出並封鎖不良輸出內容。

假設 ThemeBuilder 一般來說很擅長生成符合品牌形象的口號和調色盤,而且產生有害標語的機率也很低,那麼所有評估條件的正面類別都是 FAIL。

請注意以下事項:

- 偽陽性是指系統錯誤地將良好輸出內容標示為

FAIL。 - 偽陰性是指系統錯過的

FAIL。 - 真陽性是正確識別的

FAIL。

精確度和喚回度

現在您可以根據正類使用精確度和召回率,這兩個指標比原始對齊程度更適合:

- 精確度:當大型語言模型評估人員說

FAIL時,有多常是正確的? 舉例來說,如果法官將座右銘標示為有害,實際正確的機率有多高? - 回想:當人類說出

FAIL時,LLM 評估員判斷是否正確的頻率為何?舉例來說,在所有真正有害的輸出內容,以及所有真正不符合品牌風格的口號和調色盤中,評估人員發現了多少個?

瞭解錯誤成本 + 設定目標分數

請自問:哪種錯誤對申請的影響較大?

- 毒性:毒性屬於安全問題。我們希望找出所有有害的口號 (盡量減少誤判),即使這表示審查員有時會過於嚴格,將安全的口號標示為有害。如果系統將安全標語誤判為不安全,可能會稍微延遲或交由專人審查。因此,我們的目標是100% 召回。精確度可能較低。

- 品牌合適度:我們需要取得平衡。錯過不良設計和拒絕良好設計的代價相同。因此我們希望精確度和召回率都能達到一定水準。

F1 分數

喚回度提高時,精確度通常會下降。如果是毒性,這就不是問題,因為您只對召回感興趣。

就品牌合適度而言,喚回率和精確度都很重要。如要平衡這項重要性,可以使用新指標:F1。F1 分數會將精確度和召回率合併為單一平衡指標。

觸及率一致性

針對專家標記的資料集執行評估,並計算每個條件的準確度、精確度、召回率和 F1 分數。 評估是否達成目標。

如果不是,請將失敗案例分組,並閱讀 LLM 的基本原理。更新評審的系統指示和評分量表,縮小差距,直到指標達到目標為止。

只要法官達到目標,即為已完成校準。

最終驗證

現在,我們使用與基本評估員設定中完全相同的步驟驗證評估員,但套用新的進階指標:

- 使用自助法進行壓力測試:隨機重新取樣資料集 (含替換),並重複 10 次。計算這些執行作業的準確率、精確度和 F1 分數變異數,以數學方式證明高分並非只是運氣。

- 測試自我一致性:多次透過評估模型執行完全相同的輸入內容,確保其判斷結果 100% 穩定。我們希望所有疊代作業的差異為零。

- 對評估人員進行最終測驗:使用 15 到 20 個全新的專家標記樣本,對評估人員進行測試,這些樣本從未出現過。計算這個隱藏資料集的 Cohen's Kappa、精確度、召回率和 F1 分數。如果這些指標仍相近,表示評估人員並未過度調整對齊資料,且已準備好將資料套用至現實世界!

重新調整法官位置

完成後,恭喜!您已建構高度可靠的評估管道。

請注意,更新基礎 LLM 或應用程式的功能集發生重大變化時,請務必重新調整評估人員。